(十)一元线性回归

基本术语

回归这一术语最早来源于生物遗传学,由高尔顿(Francis Galton)引入。

回归的解释:回归分析是研究某一变量(因变量)与另一个或多个变量(解释变量、自变量)之间的依存关系,用解释变量的已知值或固定值来估计或预测因变量的总体平均值。

因变量:

自变量: 或

,

,

,……等等。

数值型自变量和数值型因变量之间关系的分析方法,就是相关与回归分析。

相关与回归是处理变量之间关系的一种统计方法。如果研究的是两个变量之间的关系,则称为简单相关与简单回归分析;如果研究的是两个以上变量之间的关系,则称为多元相关与多元回归分析。

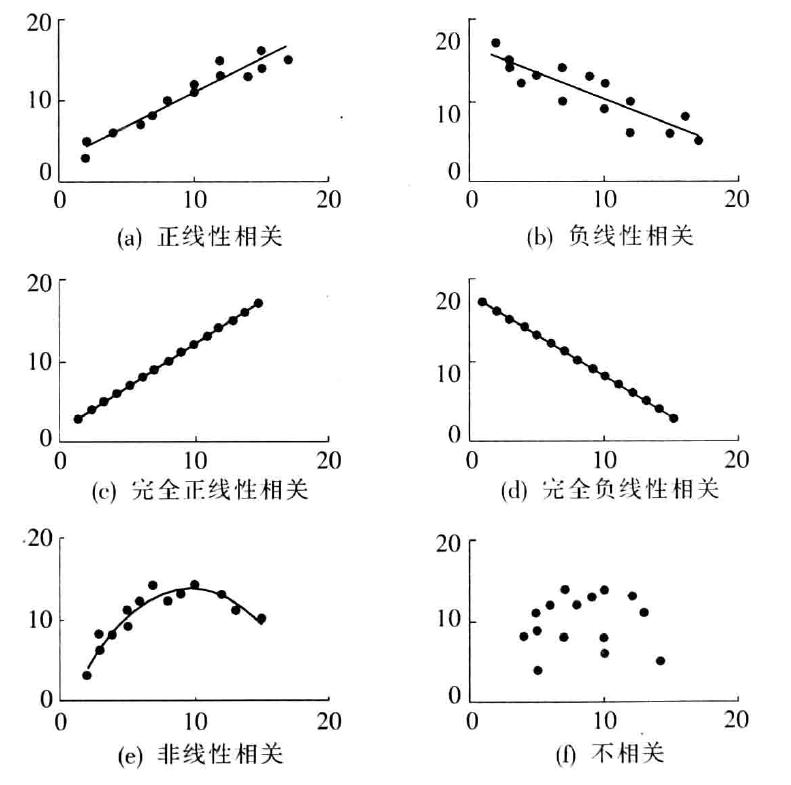

从变量之间的关系形态来看,有线性相关与线性回归分析及非线性相关与非线性回归分析。

变量之间的关系

变量之间的关系可以划分为:函数关系和相关关系。

函数关系是一一对应的关系。

变量之间存在的不确定的数量关系称为相关关系。

例子:

相关关系的描述与测度

相关分析就是对两个变量之间线性关系的描述与度量,它要解决的问题包括:

- 变量之间是否存在关系?

- 如果存在关系,他们之间是什么样的关系?

- 变量之间的关系强度如何?

- 样本所反映的变量之间的关系能否代表总体变量之间的关系?

为了解决这些问题,在进行相关分析时,对总体主要有两个假定:

第一:两个变量是线性相关的;

第二:两个变量都是随机变量;

确定相关关系的存在,相关关系呈现的形态和方向,相关关系的密切程度。其主要方法是绘制相关图表和计算相关系数。

1)相关表

编制相关表前首先要通过实际调查取得一系列成对的标志值资料作为相关分析的原始数据。

相关表的分类:简单相关表和分组相关表。单变量分组相关表:自变量分组并计算次数,而对应的因变量不分组,只计算其平均值;该表特点:使冗长的资料简化,能够更清晰地反映出两变量之间相关关系。双变量分组相关表:自变量和因变量都进行分组而制成的相关表,这种表形似棋盘,故又称棋盘式相关表。

2)相关图

利用直角坐标系第一象限,把自变量置于横轴上,因变量置于纵轴上,而将两变量相对应的变量值用坐标点形式描绘出来,用以表明相关点分布状况的图形。相关图被形象地称为相关散点图。因素标志分了组,结果标志表现为组平均数,所绘制的相关图就是一条折线,这种折线又叫相关曲线。

3)相关系数

1、相关系数是按积差方法计算,同样以两变量与各自平均值的离差为基础,通过两个离差相乘来反映两变量之间相关程度;着重研究线性的单相关系数。

2、确定相关关系的数学表达式。

3、确定因变量估计值误差的程度。

在进行相关分析时,首先需要绘制散点图来判断变量之间的关系形态,如果是线性关系,则可以利用相关系数来测度两个变量之间的关系强度,然后对相关系数进行显著性检验,以判断样本所反映的关系是否代表两个变量总体上的关系。

根据散点图,当自变量取某一值时,因变量对应为一概率分布,如果对于所有的自变量取值的概率分布都相同,则说明因变量和自变量是没有相关关系的。反之,如果,自变量的取值不同,因变量的分布也不同,则说明两者是存在相关关系的。

两个变量之间的相关程度通过相关系数

来表示。相关系数

的值在-1和1之间,但可以是此范围内的任何值。

正相关时,

值在0和1之间,散点图是斜向上的,这时一个变量增加,另一个变量也增加;

负相关时,

值在-1和0之间,散点图是斜向下的,此时一个变量增加,另一个变量将减少。

的绝对值越接近1,两变量的关联程度越强,

的绝对值越接近0,两变量的关联程度越弱。

不同形态的散点图:

相关分析

相关分析就是对总体中确实具有联系的标志进行分析,其主体是对总体中具有因果关系标志的分析。

它是描述客观事物相互间关系的密切程度并用适当的统计指标表示出来的过程。在一段时期内出生率随经济水平上升而上升,这说明两指标间是正相关关系;而在另一时期,随着经济水平进一步发展,出现出生率下降的现象,两指标间就是负相关关系。

通过散点图可以判断两个变量之间有无相关关系,并对变量之间的关系形态作出大致的描述,但散点图不能准确反映变量之间的关系强度。因此,为准确度量两个变量之间的关系强度,需要计算相关系数。

相关系数(correlation coefficient)是根据样本数据计算的度量两个变量之间线性关系强度的统计量。

若相关系数是根据总体全部数据计算的,称为总体相关系数,记为:

若是根据样本数据计算的,则称为样本相关系数,记为:

样本相关系数的计算公式为:

按上述公式计算的相关系数也称为线性相关系数(Linear Correlation Coefficient),或称为 Pearson 相关系数(Pearson's Correlation Coefficient)

一般情况下,总体相关系数 是未知的,通常将样本相关系数

作为

的近似估计值。

但是由于 是根据样本数据计算出来的,因此会受到抽样波动的影响。由于抽取的样本不同,

的取值也就不同,因此

是一个随机变量。能够根据样本相关系数说明总体的相关程度呢?这就需要考虑样本相关系数的可靠性,也就是进行显著性检验。

相关分析的目的:测度变量之间的关系强度。

使用的工具:相关系数

回归分析要解决的问题

- 从一组样本数据出发,确定变量之间的数学关系式;

- 对这些关系式的可信程度进行各种统计检验,并从影响某一特定变量的诸多变量中找出哪些变量的影响是显著的,哪些是不显著的;

- 利用所求的关系式,根据一个或几个变量的取值来估计或预测另一个特定变量的取值,并给出这种估计或预测的可靠程度。

一元线性回归

回归模型的表示:

其中: 是误差项的随机变量。

回归模型:

一元线性回归方程的图示是一条直线,因此也称为直线回归方程。

例题讲解

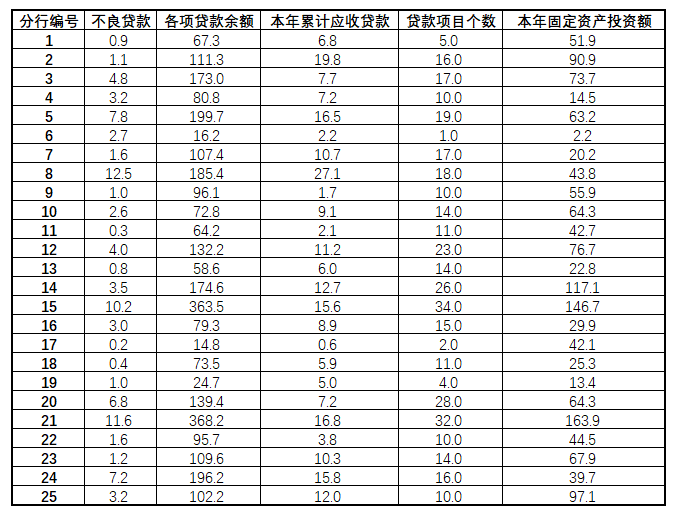

一家大型商业银行在多个地区设有分行,其业务主要是进行基础设施建设、国家重点项目建设、固定资产投资等项目的贷款。为弄清楚不良贷款形成的原因,管理者希望利用银行业务的有关数据做些定量分析,以便找到控制不良贷款的办法。

下表就是该银行所属的25家分行的有关业务数据:

管理者想知道,不良贷款是否与贷款余额、累计应收贷款、贷款项目的多少、固定资产投资额等因素有关?

如果有关系,他们之间是一种什么样的关系?关系强度如何?试绘制散点图,并分析不良贷款与贷款余额、累计应收贷款、贷款项目个数、固定资产投资额之间的关系。

绘制的散点图

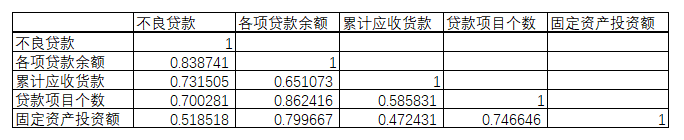

用Excel【数据分析】中的【相关系数】工具计算的相关矩阵如下:

从相关矩阵可以看出,不良贷款与其它几个变量的关系中,与贷款余额的相关系数最大,而与固定资产投资额的相关系数最小。

常见问题

1、 解释相关关系的含义,并说明相关关系的特点。

含义:变量之间存在的不确定的数量关系为相关关系。

特点:一个变量的取值不能由另一个变量唯一确定,当变量取某个值时,变量

的取值可能有几个;变量之间的相关关系不能用函数关系进行描述,但也不是无任何规律可循。通常对大量数据的观察与研究,可以发现变量之间存在一定的客观规律。

2、 相关分析主要解决哪些问题?

变量间是否存在关系;如果存在,是什么样的关系;变量之间的关系强度如何;样本所反映的变量之间的关系能否代表总体变量之间的关系。

3. 相关分析中有哪些基本假定?

两个变量之间是线性关系;两个变量都是随机变量。

4、 简述相关系数的性质

公式:

性质:;对称性

的大小与

和

的原点及尺度无关; ???? 仅仅是

与

之间线性关系的一个度量,不能用于描述非线性关系;

虽然是两个变量之间线性关系的一个度量,不意味着

和

一定有因果关系。

5. 为什么要对相关系数进行显著性检验?

在对实际现象进行分析时,往往是利用样本数据计算相关系数作为总体相关系数的估计值,但由于样本相关系数具有一定的随机性,它能否说明总体的相关程度往往同样本容量有一定关系。因此需要对相关系数进行显著性检验,若在统计上是显著的,说明它可以作为总体相关程度的代表值 ,否则不能作为总体相关程度的代表值 。

6. 简述相关系数显著性检验的步骤。

提出假设::

:

计算检验的统计量: ~

进行决策:确定显著性水平,若,拒绝原假设。

7. 解释回归模型、回归方程、估计的回归方程的含义

回归模型:描述因变量 ???? 如何依赖自变量 ????和误差项 ???? 的方程称为回归模型

表示为:

回归方程:描述因变量如何依赖自变量 ????的方程称为回归方程,表示为:

估计的回归方程:根据样本数据求出的回归方程,表示为:

8. 一元线性回归模型中有哪些基本假定?

因变量与自变量

具有线性关系;在重复抽样中,自变量

的取值是固定的,即假设

是非随机的;误差项

是一个期望值为 0 的随机变量;对于所有的

值,

的

都相同;误差项

是一个服从正态分布的随机变量 ,且独立,即

~

。

9. 简述参数最小二乘估计的基本原理

对于和

的

对观测值,用距离各观测点最近的一条直线来代表

和

之间的关系与实际数据的误差比其他任何直线都小。即使因变量的观测值与估计值之间的离差平方和达到最小来估计

和

。

10. 解释总平方和、回归平方和、残差平方和的含义,并说明他们之间的关系。解释总平方和、回归平方和、残差平方和的含义,并说明他们之间的关系

总平方和:对一个具体的观测值来说,变差的大小可以用实际观测值与其均值

之差

来表示,而

次观测值的总变差可由这些离差的平方和来表示,称为总平方和(SST)。

回归平方和:由于自变量的变化引起的

的变化,而其平方和反映了

的总变差中由于

与

之间的线性关系引起的

的变化部分,它是可以由回归直线来解释的变差部分,称为回归平方和(SSR)。

残差平方和:除了对

的线性影响之外的其他因素对

变差的作用,是不能由回归直线来解释的变差部分,称为残差平方和( SSE)。

关系:SST=SSR+SSE

11. 简述判定系数的含义和作用

含义:判定系数是对估计的回归方程拟合优度的度量。

作用:判定系数 测度了回归直线对观测数据的拟合优度,取值范围

;

越接近 ,表明回归平方和占总平方和的比例越大,拟合优度越好;

反之,越接近于 ,回归直线的拟合程度就越差。

12. 在回归分析中, 检验和

检验各有什么作用

检验:线性关系检验。

检验:回归系数检验。

13. 简要说明残差分析在回归分析中的作用

判断对误差项 的假定是否成立。

最后

以上就是潇洒小鸭子最近收集整理的关于[统计学笔记] (十)一元线性回归的全部内容,更多相关[统计学笔记]内容请搜索靠谱客的其他文章。

![[离散时间信号处理学习笔记] 12. 连续时间信号的离散时间处理以及离散时间信号的连续时间处理...连续时间信号与离散时间信号之间的关系连续时间信号的离散时间处理离散时间信号的连续时间处理](https://www.shuijiaxian.com/files_image/reation/bcimg20.png)

![[统计学笔记] (十)一元线性回归](https://www.shuijiaxian.com/files_image/reation/bcimg22.png)

发表评论 取消回复