谷歌现象级产品NotebookLM,被两个本科生自学3个月复刻了!

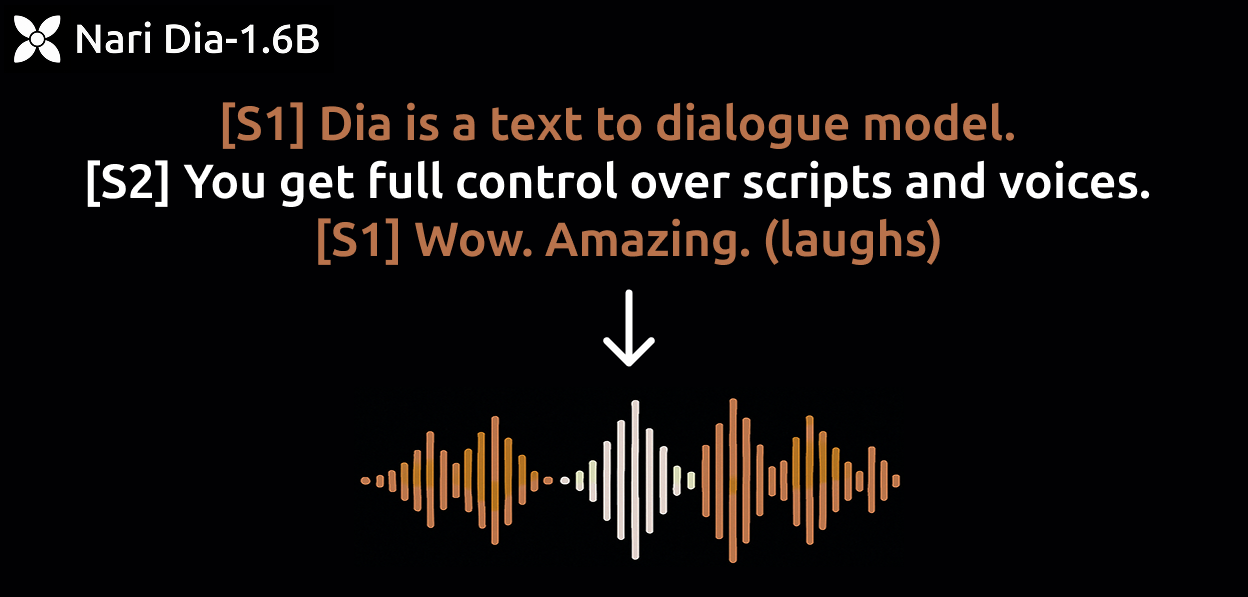

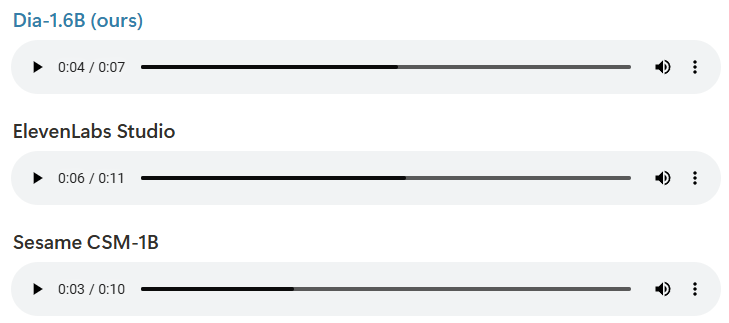

Nari Labs最新开源了一个超写实对话级文本转语音模型:Dia!

参数量为 16 亿,能够“一步生成”极为逼真的多角色对话语音。

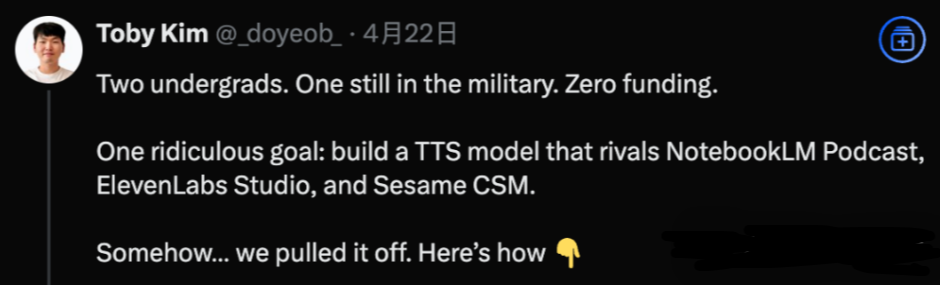

Nari Lab创始成员Toby Kim与Jaeyong Sung,来自韩国首尔大学和韩国科学技术院(KAIST),其中还有一人在服兵役兼职工作,整个项目0融资启动,自学3个月完成。

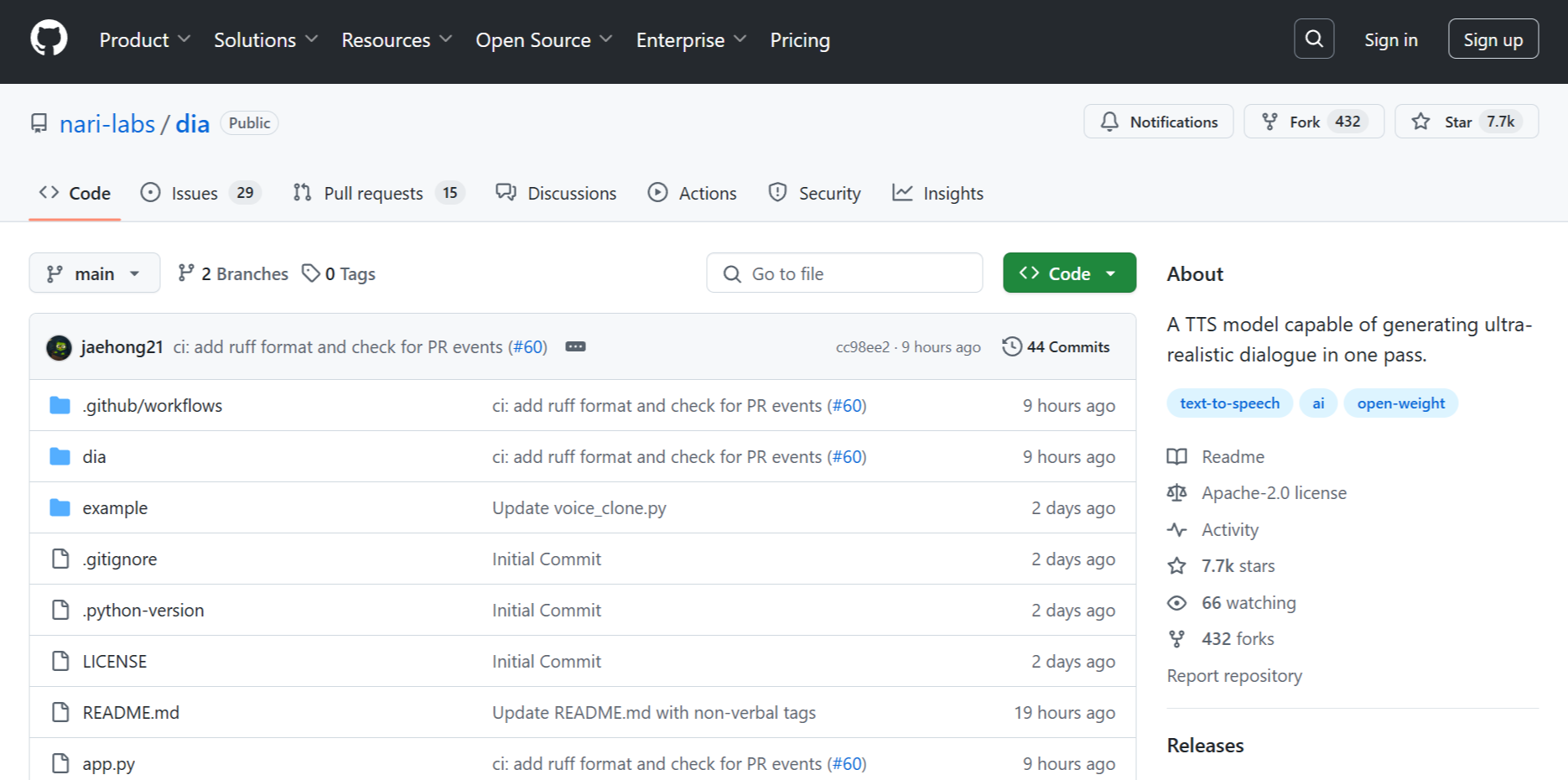

项目完全开源,采用 Apache 2.0 协议,权重和推理代码公开,在GitHub上已经获得7.7Kstar!

核心功能

高保真文本转对话语音:能直接根据对话文本生成自然、有情感的多说话人语音。

情感与语调可控:可用音频条件(prompt)进行控制,实现情感、语调的定制。

非语言动作生成:支持如(笑声)、(咳嗽)、(叹气)等非言语声音的合成。

语音克隆:可通过音频prompt实现声音克隆(voice cloning)。

一键推理体验:支持 Gradio UI、本地命令行、Python API 直接调用。

架构设计与技术亮点

单步对话生成:一次性生成完整对话(支持多说话人,如[S1]、[S2]标签)。

非语言标签支持:支持丰富的非语言动作标签,增强真实感。

硬件支持与推理效率:

推荐在 GPU 上运行,支持 Pytorch 2.0+,CUDA 12.6。

在企业级 GPU(如A4000)可实现近实时语音生成。

后续会支持 CPU、模型量化、Docker 等。

数据与工程实践:借鉴 SoundStorm、Parakeet、Descript Audio Codec 等前沿技术。

可扩展性:未来计划优化推理速度、降低显存占用、支持更广泛硬件。

GitHub:https://github.com/nari-labs/dia/

Hugging Face:https://huggingface.co/nari-labs/Dia-1.6B

更多演示:https://yummy-fir-7a4.notion.site/dia

应用场景

AI 对话助手、语音机器人

数字人、虚拟主播

影视动画配音、多角色游戏语音

内容创作与 remix

语音交互体验、辅助沟通等

发表评论取消回复