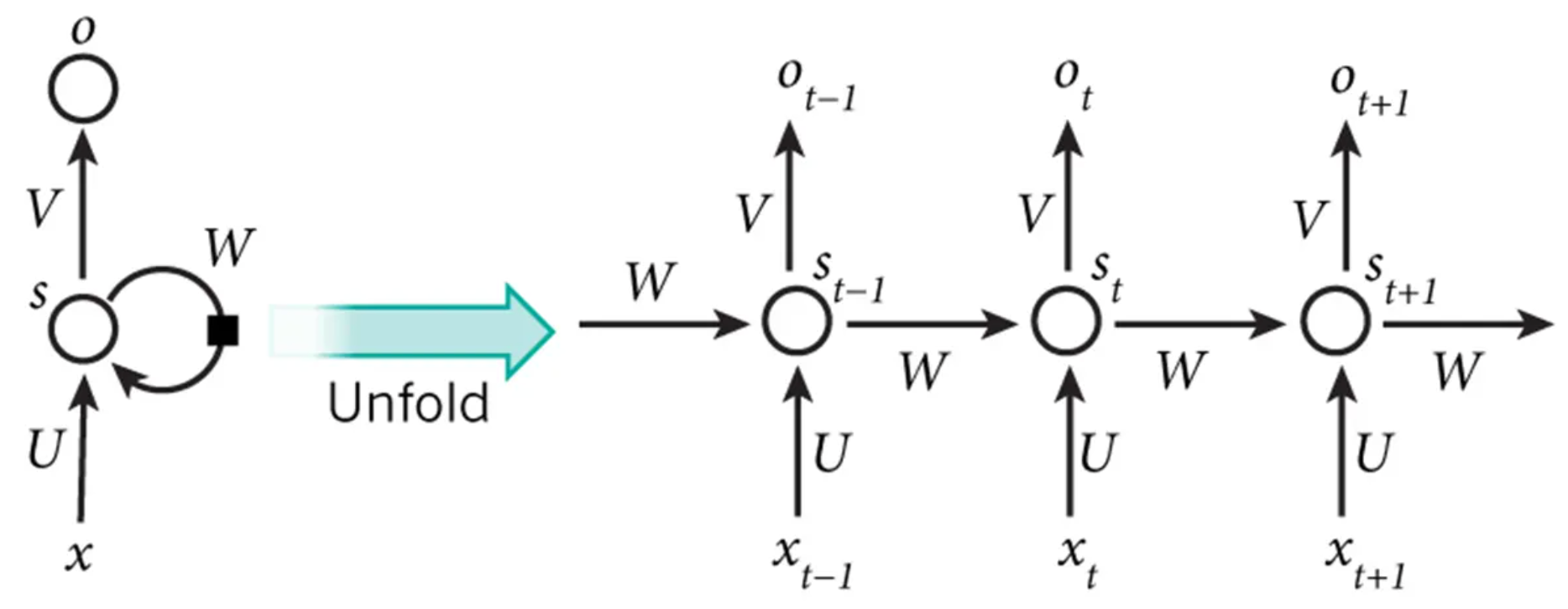

1、循环神经网络详解(RNN)

公式:

o

(

t

)

=

s

o

f

t

m

a

x

(

h

t

⋅

w

h

y

+

b

y

)

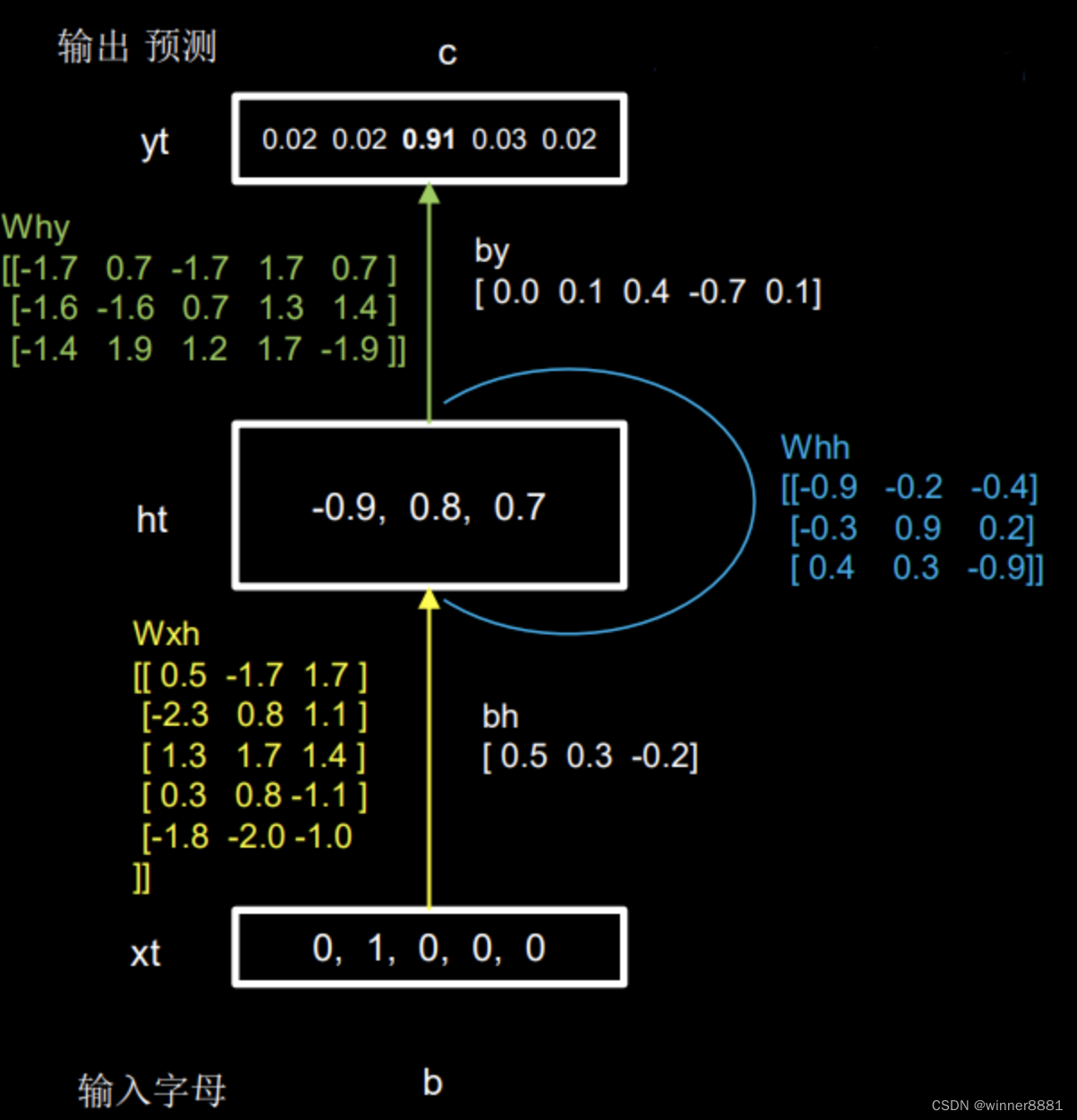

o(t)=softmax(h_t cdot w_{hy}+b_y)

o(t)=softmax(ht⋅why+by)

h

t

=

t

a

n

h

(

h

t

−

1

⋅

w

h

h

+

x

t

⋅

w

x

h

+

b

h

)

h_t=tanh(h_{t-1} cdot w_{hh} + x_t cdot w_{xh} + b_h)

ht=tanh(ht−1⋅whh+xt⋅wxh+bh)

参数默认:

W :

w

h

h

w_{hh}

whh,h表征中间隐层记忆体维度

U :

w

x

h

w_{xh}

wxh,x为输入层embedding维度(文本->分词->词典化->填充->embedding table lookup)

V :

w

h

y

w_{hy}

why,连接隐层到输出层,比如手写数字识别,则有y=10(10分类任务)

参数量:

h

∗

h

h*h

h∗h (W :

w

h

h

w_{hh}

whh) +

x

∗

h

(

x*h (

x∗h(U :

w

x

h

w_{xh}

wxh) +

h

∗

1

h*1

h∗1(

b

h

b_h

bh) +

h

∗

y

h*y

h∗y(V :

w

h

y

w_{hy}

why) =

h

∗

(

h

+

x

+

1

+

y

)

h*(h+x+1+y)

h∗(h+x+1+y)

注意事项(容易误解的地方)

1、tanh不改变参数维度

2、softmax输出维度是y,y维度取决于实际任务

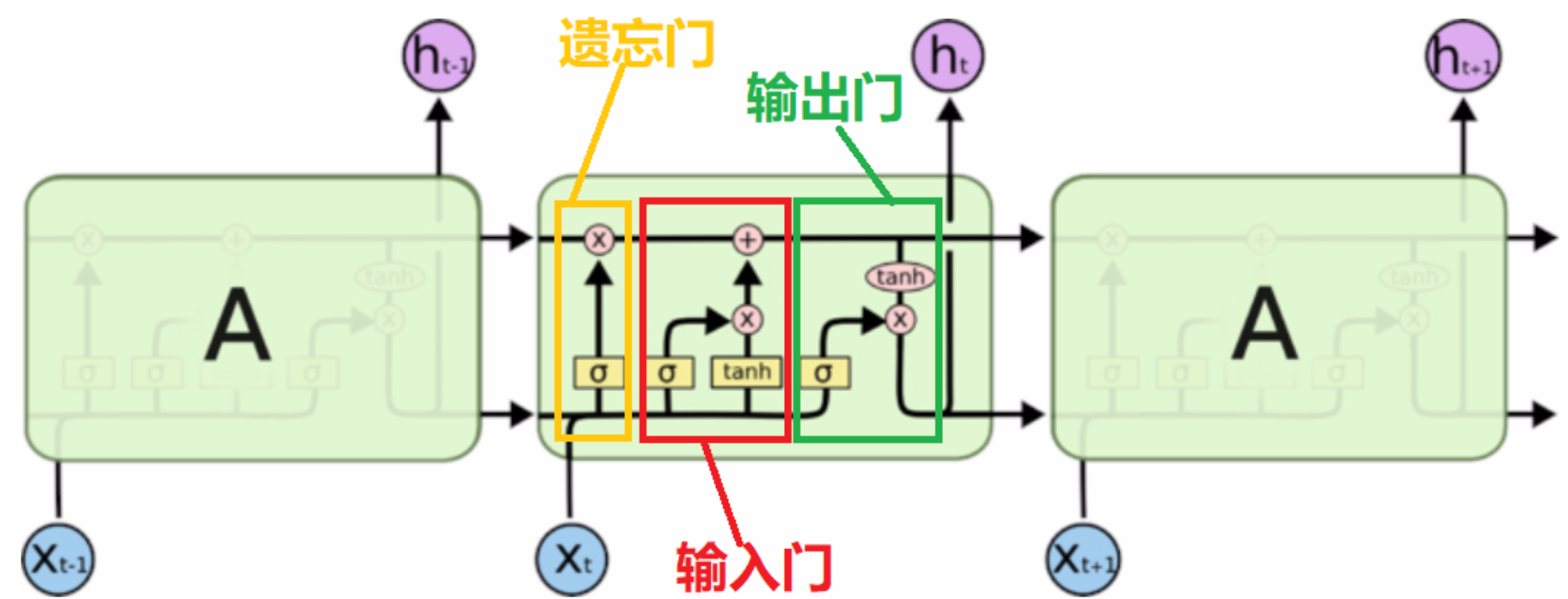

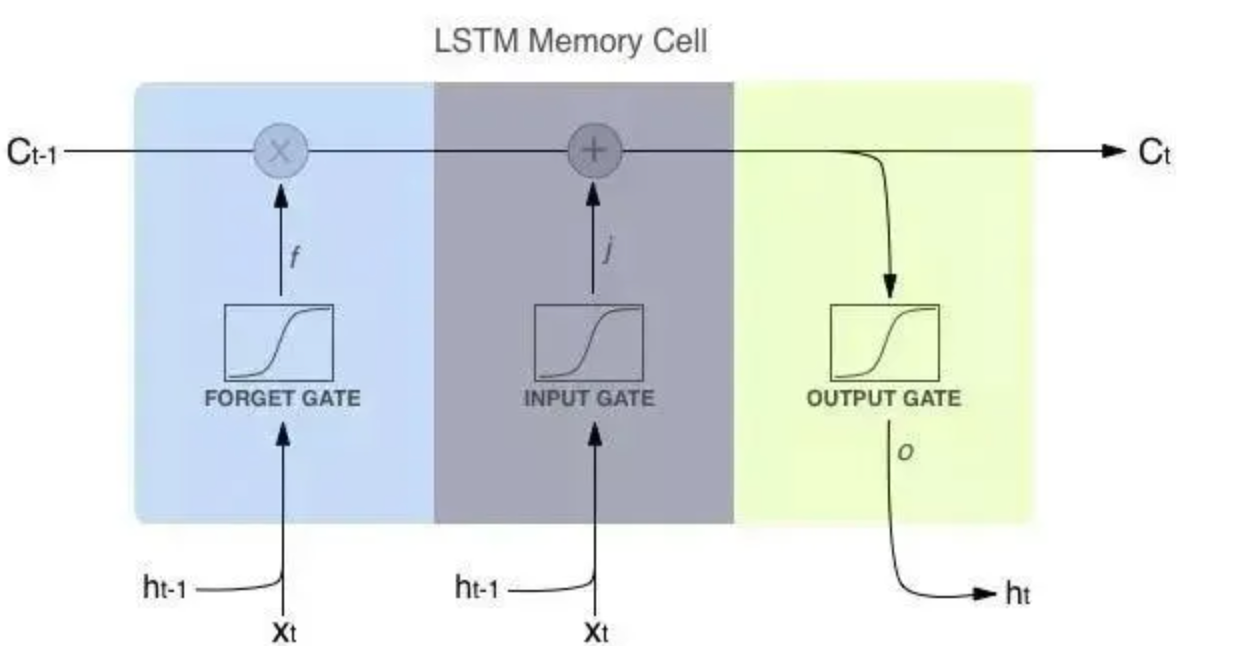

2、LSTM

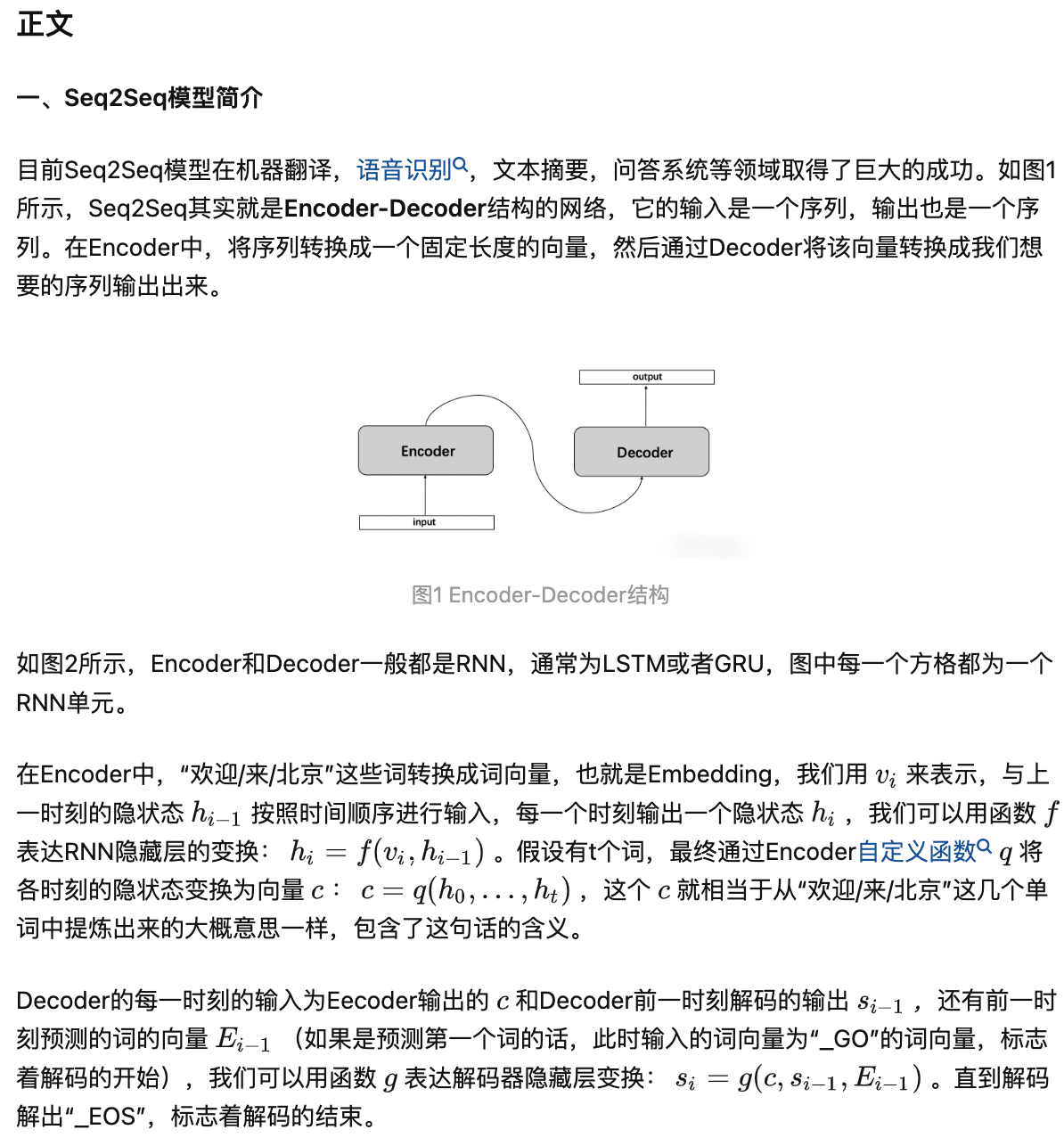

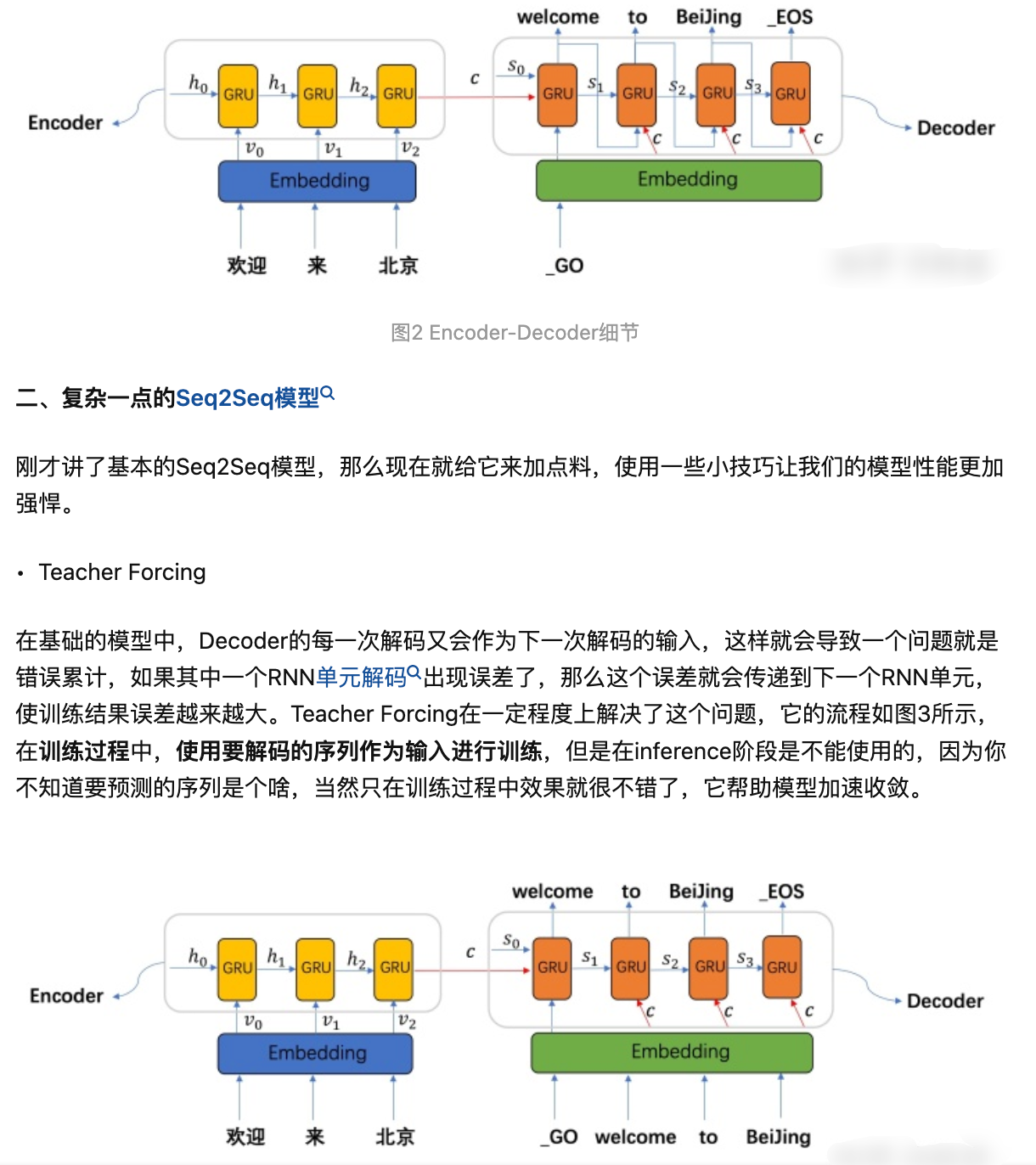

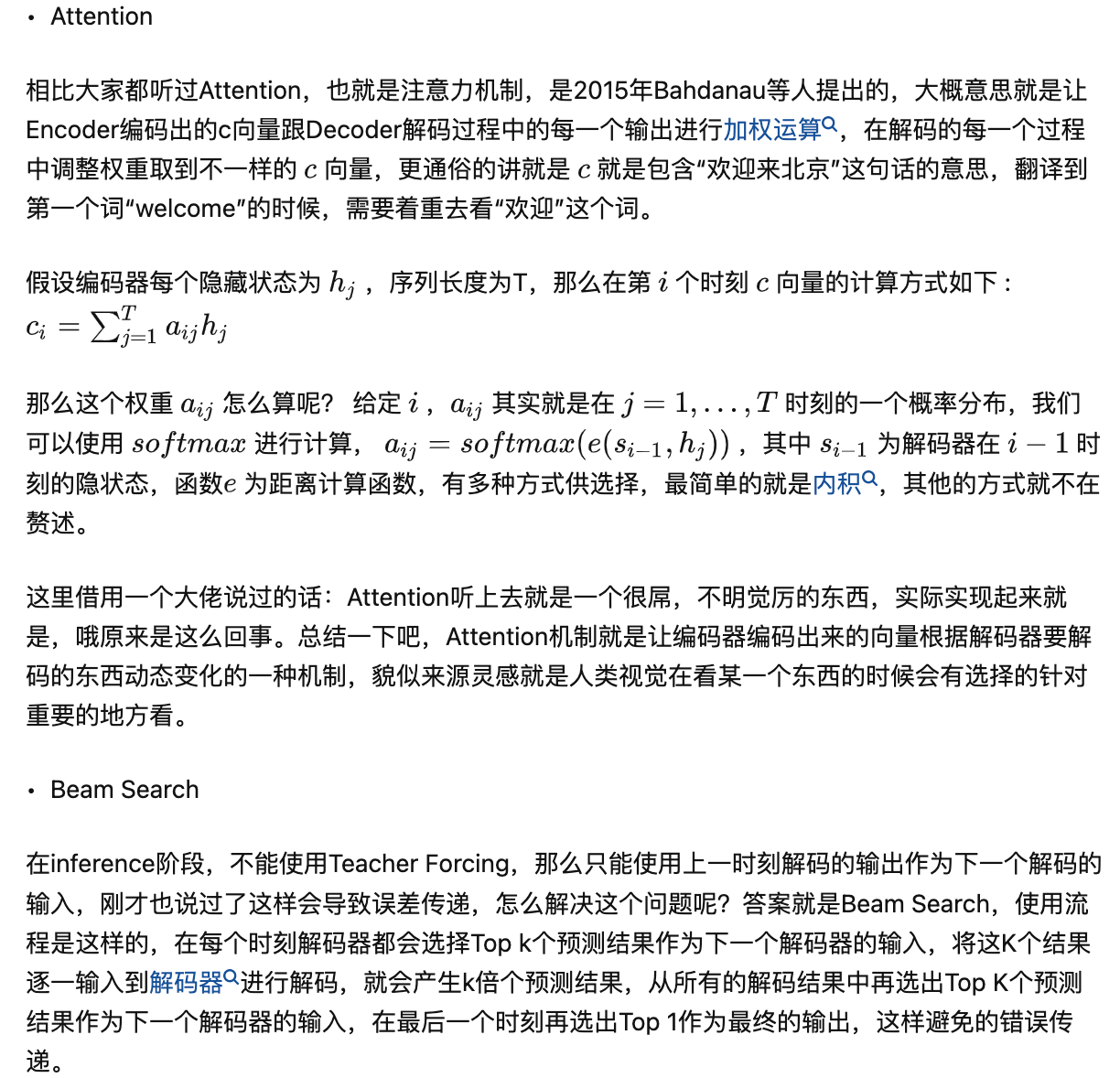

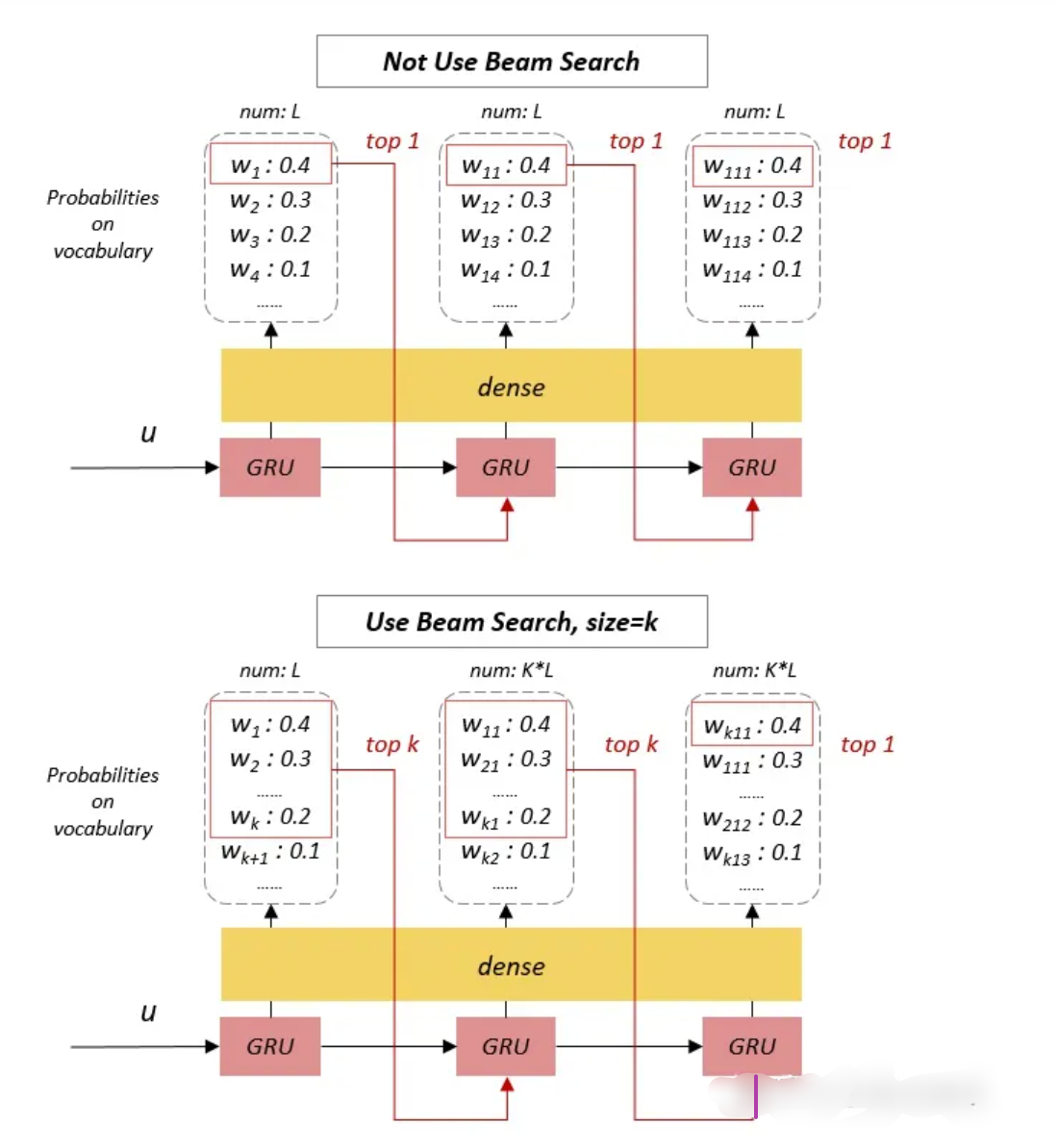

3、seq2seq

Ref:

[1].LSTM理解

[2].LSTM拆分图

[3].简说Seq2Seq原理及实现

[4].Tensorflow中的Seq2Seq全家桶

最后

以上就是畅快柜子最近收集整理的关于序列网络详解的全部内容,更多相关序列网络详解内容请搜索靠谱客的其他文章。

发表评论 取消回复