关于batch normalization

Batch normalization 是由Sergey Ioffe在这篇文章中介绍的。它的作用是减少internal covariance shift,这样的话是网络中的每一层的学习相互独立。这样网络的收敛速度会更快,因此初始化的参数会学习结果的影响更小。

在什么地方使用batch Normalization似乎是有争议的。我成功在卷积之后,激活层之前添加,也成功在激活层之后添加。

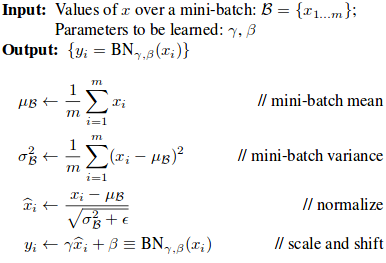

关于batch normalization的计算

根据下面的图片显示,BN层将会学习两个参数gamma 和beta,最后的输出与X_hat和gamma,beta相关。在计算X_hat时候,需要用到两个参数,average和variance(记住这两个参数,后面在分析TensorFlow的实现时候要用到)

TensorFlow实现

在TensorFlow中对于BN层有两种不同的实现方式。分别为training mode和inference mode。

Training Mode

在该模式下,上面提到的average和variance通过计算一个batch中的average和variance来得到。成为batch average和batch variance。

Inference Mode

在inference 模式下,因为如果batch size是1的话,BN将起不到作用,因此在inference 模式中,average 和 variance由之前在训练时候得到的average和variance来替代,称为population average和population variance。因为训练过程要有好多的batch,所以population average和population variance应该作为参数被更新(但这两个参数不在后向反馈网络中,因此需要手动的添加到学习的dependency中去)

根据上面的介绍,在部署拥有BN层的模型时,在freeze model 前,要需要注意将模型的模式变为inference mode,否则可能会对结果有影响。

PS

可以通过浏览TensorFlow的源码来理解BN层的工作方式,或者请确保BN层中的每个参数都得到了正确的设置。

其他问题

- BN层的beta参数不参与学习?

最后

以上就是热情帅哥最近收集整理的关于TensorFlow中Batch Normalization的坑的全部内容,更多相关TensorFlow中Batch内容请搜索靠谱客的其他文章。

![[Python人工智能] 三十六.基于Transformer的商品评论情感分析 (2)keras构建多头自注意力(Transformer)模型](https://www.shuijiaxian.com/files_image/reation/bcimg16.png)

发表评论 取消回复