大语言模型(LLM)的推理性能瓶颈正在被新技术打破。近日,Moonshot AI(月之暗面)与清华大学研究团队联合提出了一种名为**预填充即服务(PrfaaS)**的新型架构。该研究旨在通过优化算力资源分配,解决大模型服务在数据中心部署时面临的硬件限制,显著提升了推理效率。

技术突破:预填充与解码的“手术刀式”分离

目前,大语言模型的推理过程主要分为两个差异化的阶段:

预填充阶段(Prefill): 属于计算密集型,负责处理输入并生成键值缓存(KVCache)。

解码阶段(Decode): 属于内存带宽密集型,负责逐字生成输出。

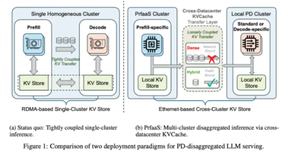

在传统的服务架构中,这两个阶段通常被挤在同一个数据中心甚至同一台服务器内处理。由于两者对硬件资源的需求截然不同,这种“强行捆绑”往往导致计算资源与带宽之间的分配失衡,进而引发服务拥堵。

核心创新:跨地域的高效协同

此次Moonshot AI与清华大学的合作,不仅为大规模AI推演提供了新的工程思路,也为未来跨地域算力网络的构建奠定了技术基础。这种“预填充即服务”的模式,或许将成为大模型迈向工业化应用的重要分水岭。

发表评论取消回复