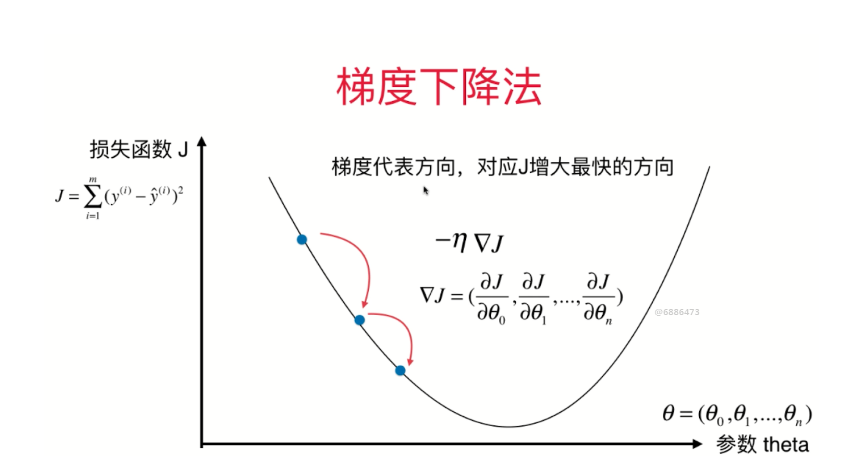

梯度下降法

梯度下降法的基本思想可以类比为一个下山的过程。假设这样一个场景:一个人被困在山上,需要从山上下来(i.e. 找到山的最低点,也就是山谷)。但此时山上的浓雾很大,导致可视度很低。因此,下山的路径就无法确定,他必须利用自己周围的信息去找到下山的路径。这个时候,他就可以利用梯度下降算法来帮助自己下山。具体来说就是,以他当前的所处的位置为基准,寻找这个位置最陡峭的地方,然后朝着山的高度下降的地方走,同理,如果我们的目标是上山,也就是爬到山顶,那么此时应该是朝着最陡峭的方向往上走。然后每走一段距离,都反复采用同一个方法,最后就能成功的抵达山谷。

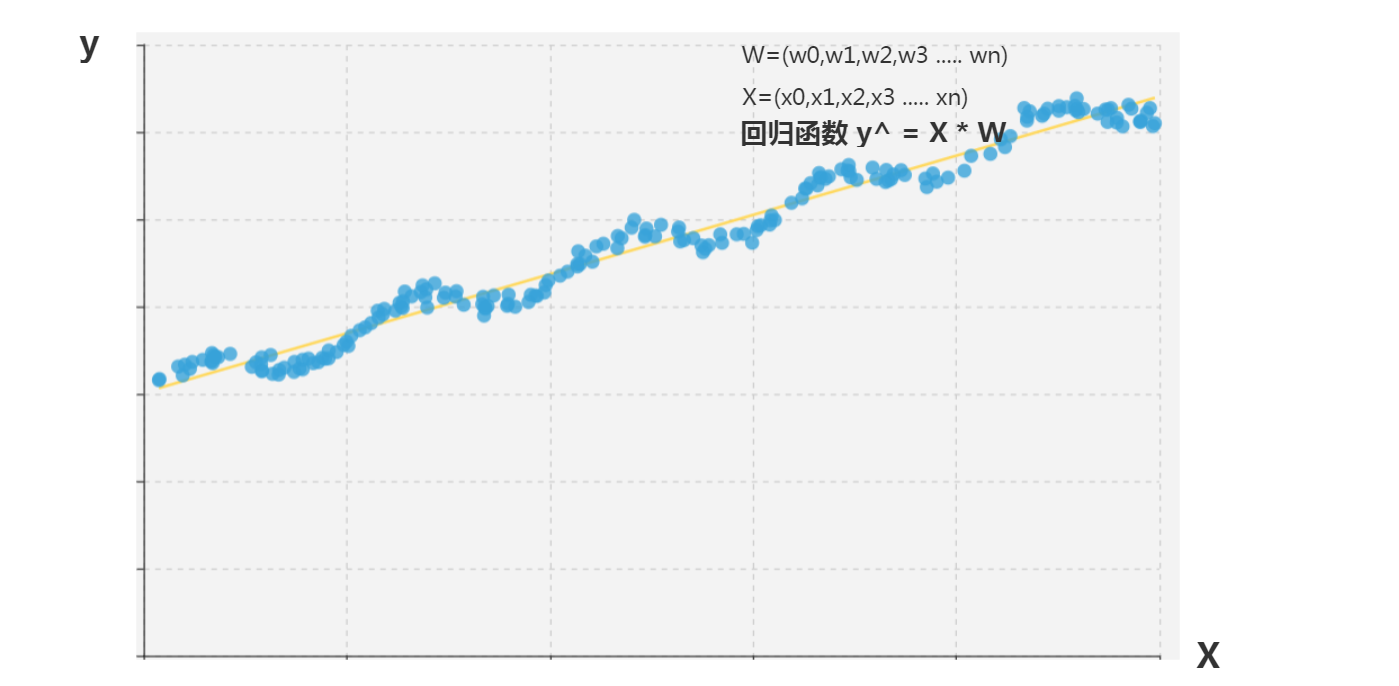

多元线性回归模型

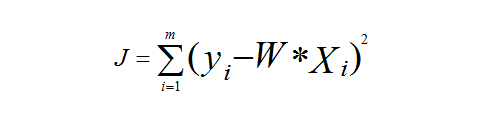

损失函数

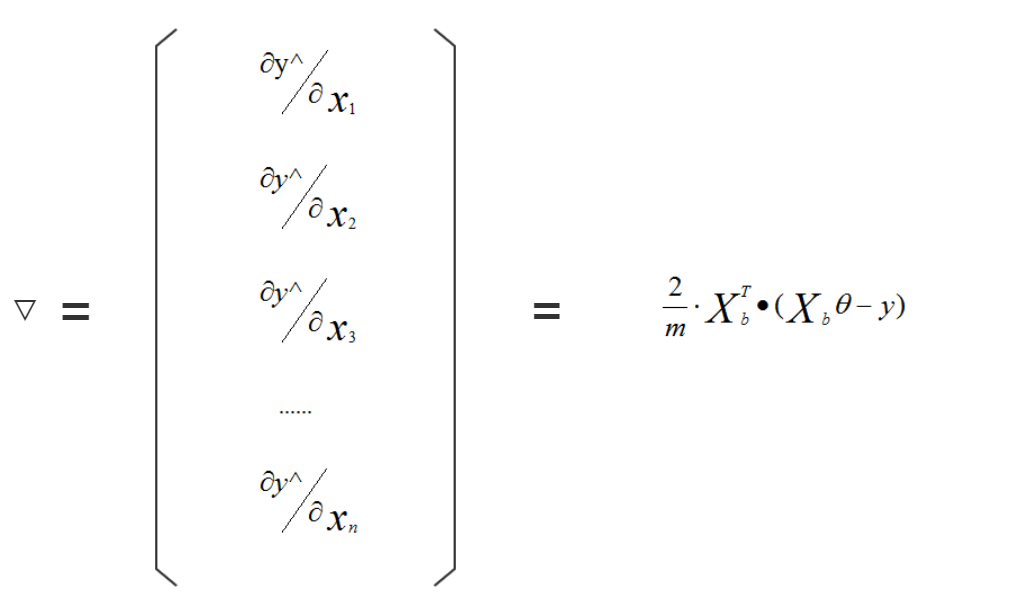

批量梯度下降法

在将训练数据集代入损失函数f 中,得到 参数变量 W 和 损失函数f的函数关系,在迭代过程中 使用 f在 W处的梯度 和W = W - ▽ · ε 公式,不断减小损失函数,直至找到最小的损失函数所对应的参数 W。

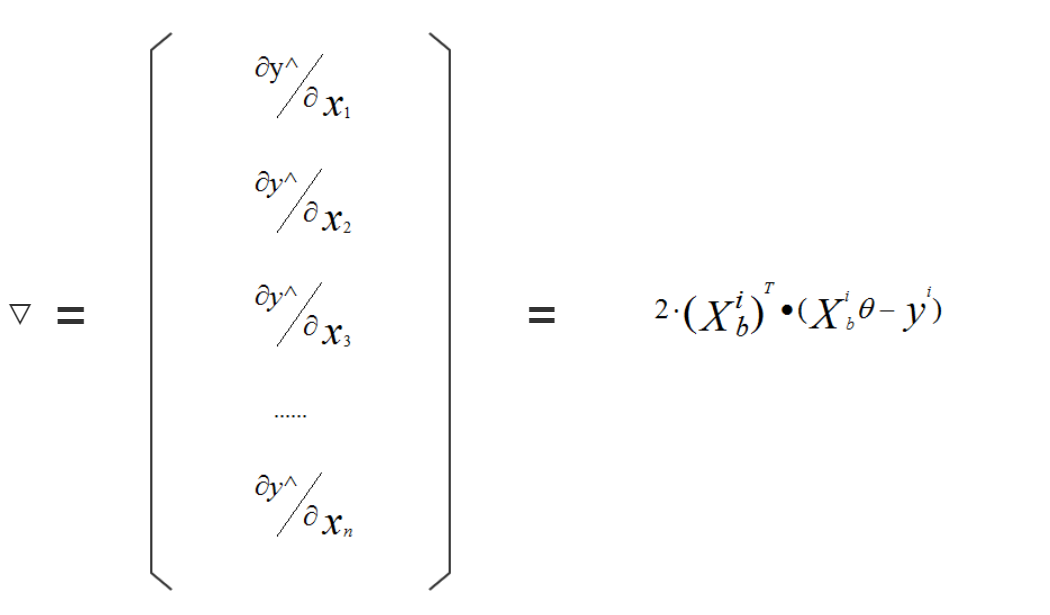

批量梯度下降法梯度

随机梯度下降法

将训练数据集中随机一条数据代入损失函数f 中,得到 参数变量 W 和 损失函数f的函数关系,在迭代过程中 使用 f在 W处的梯度 和W = W - ▽ · ε 公式,不断减小损失函数,直至找到最小的损失函数所对应的参数 W。

随机梯度

随机批量梯度下降法

为了进一步提升收敛速度。每次从数据集中随机选取一批数据训练模型,克服随机梯度下降法中模型对异常数据过度敏感。

python 代码

from sklearn.linear_model import SGDRegressor

from sklearn.preprocessing import StandardScaler

standardScaler = StandardScaler()

X_train_sta = standardScaler.transform(X_train)

X_test_sta = standardScaler.transform(X_test)

sgd_reg = SGDRegressor(n_iter=100000)

sgd_reg.fit(X_train_sta,y_train)

sgd_reg.score(X_test_sta,y_test)

#0.7102320877365798

最后

以上就是愤怒可乐最近收集整理的关于sklearn -- 梯度下降法梯度下降法的全部内容,更多相关sklearn内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复