爬虫框架

*爬虫框架是实现爬虫功能的一个软件结构和功能组件集合

*爬虫框架是一个半成品,能够帮助用户实现专业网络爬虫

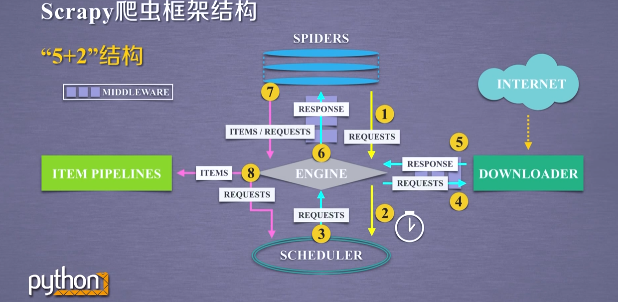

Scrapy爬虫框架结构

"5+2"结构

Spiders(用户提供Url、以及解析内容)、Item pipelines(对提取的信息进行处理)模块需要用户编写(配置)

其他模块:Engine、Scheduler、Downloader模块已有实现,不需要用户进行修改

Engine:控制所有模块之间的数据流、根据条件触发事件,不需要用户修改

Downloader:根据请求下载网页,不需要用户修改

Scheduler:对所有爬取请求进行调度管理、不需要用户进行修改

Downloader Middleware(中间件)

目的:实施Engine、Scheduler和Downloader之间进行用户可配置的控制

功能:修改、丢弃、新增请求或响应

用户可以编写配置代码

Spider:解析Downloader返回的响应(Response)、产生爬取项(scraped item)、产生额外的爬取请求(Request)

Item pipelines:以流水线方式处理Spider产生的爬取项、由一组操作顺序组成,类似流水线,每个操作是一个Item Pipeline类型。

可能的操作包括:清理、检验和查重爬取项中的HTML数据、将数据存储到数据库。

Spider Middleware(中间件)

目的:对请求和爬取项的再处理

功能:修改、丢弃、新增请求或爬取项

用户可以编写配置代码

requests vs.Scrapy

| requests | Scrapy |

| 页面级爬虫 | 网站级爬虫 |

| 功能库 | 框架 |

| 并发性考虑不足,性能较差 | 并发性好,性能较高 |

| 重点在于页面下载 | 重点在于爬虫结构 |

| 定制灵活 | 一般定制灵活,深度定制困难 |

| 上手十分简单 | 入门稍难 |

两个方法看情况用

非常小的需求,用requests库

不太小的需求,Scrapy框架(持续周期性不间断爬取)

定制程度很高的需求(不考虑规模),自搭框架,requests>Scrapy

相同点

*两者都可以进行页面请求和爬取,python爬虫的两个重要技术路线。

*两者可用性都好,文档丰富,入门简单。

*两者都没有处理js、提交表单、应对验证码等功能(可扩展)。

最后

以上就是务实夏天最近收集整理的关于Scrapy爬虫框架结构以及和Requests库的比较的全部内容,更多相关Scrapy爬虫框架结构以及和Requests库内容请搜索靠谱客的其他文章。

发表评论 取消回复