Word2vec+LSTM

参考

X. Dong, S. Chowdhury, U. Victor, X. Li and L. Qian, “Semi-supervised Deep Learning for Cell Type Identification from Single-Cell Transcriptomic Data,” in IEEE/ACM Transactions on Computational Biology and Bioinformatics, doi: 10.1109/TCBB.2022.3173587.

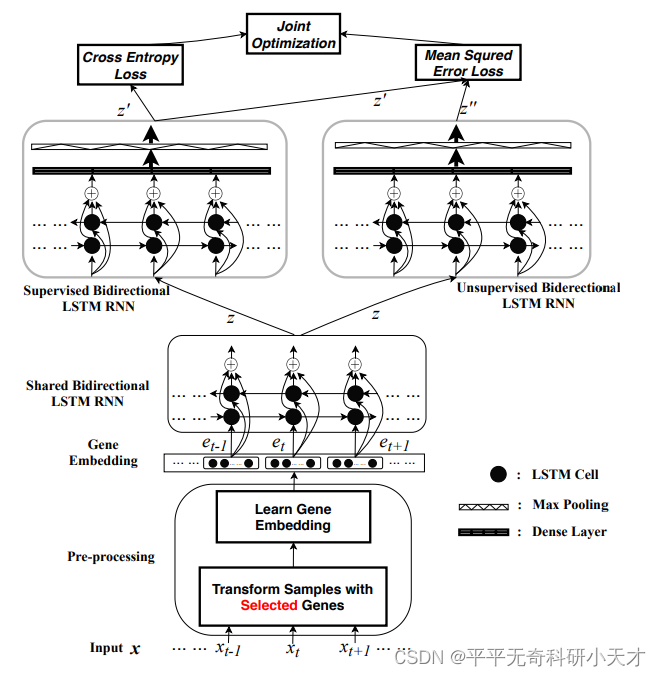

模型架构

输入x为细胞,只有部分细胞有类型注释。

- 与Word2vec类似,Gene2vec利用与一个基因共表达的其他基因定义该基因,这能够以更有效的方式捕捉基因相关性。本文选取表达值最高的topk基因,S(g)=<g1,g2,g3,…,gt,…,gk>;每个基因用Gene2vec生成的embedding表示,<g1,g2,g3,…,gt,…,gk>=<e1,e2,e3,…,et,…,ek>,et为gt的embedding。

- 将基因embedding输入BiLSTM,每个节点的输出(z)是将正向LSTM向量,输入,反向LSTM向量拼接得到的。

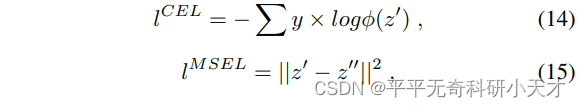

- 将z输入有监督BiLSTM,学习有标签样本的深度特征(z’),计算输出与标签的交叉熵损失函数(CEL);将z输入无监督BiLSTM学习无标签样本的重构特征(z’‘),计算z’'与z’的均方误差(MSEL)。最终损失函数是这两项误差值和。

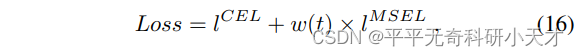

实验结果

- 对比算法

(1)Word-level CNN (Word CNN)

Y. Kim, “Convolutional neural networks for sentence classification,” arXiv preprint arXiv:1408.5882, 2014.

(2)Attention-Based Bidirectional RNN (Att RNN)

P. Zhou, W. Shi, J. Tian, Z. Qi, B. Li, H. Hao, and B. Xu, “Attention based bidirectional long short-term memory networks for relation classification,” in Proceedings of the 54th Annual Meeting of the Association for Computational Linguistics (Volume 2: Short Papers), 2016, pp. 207–212.

(3)Recurrent CNN (RCNN)

S. Lai, L. Xu, K. Liu, and J. Zhao, “Recurrent convolutional neural networks for text classification,” in Twenty-ninth AAAI conference on artificial intelligence, 2015.

(4)word-level bidirectional RNN (Word RNN) - 实验结果分析

(1)在机器学习算法中决策树和SVM准确率最高

(2)通过Gene2vec得到的embedding比原始基因表达数据能够提高预测准确率。

GNN+BOF

参考

Li, Junyi,Jiang, Wei,Han, Henry,Liu, Jing,Liu, Bo,Wang, Yadong.ScGSLC: An unsupervised graph similarity learning framework for single-cell RNA-seq data clustering[J]Computational biology and chemistry.2021.90

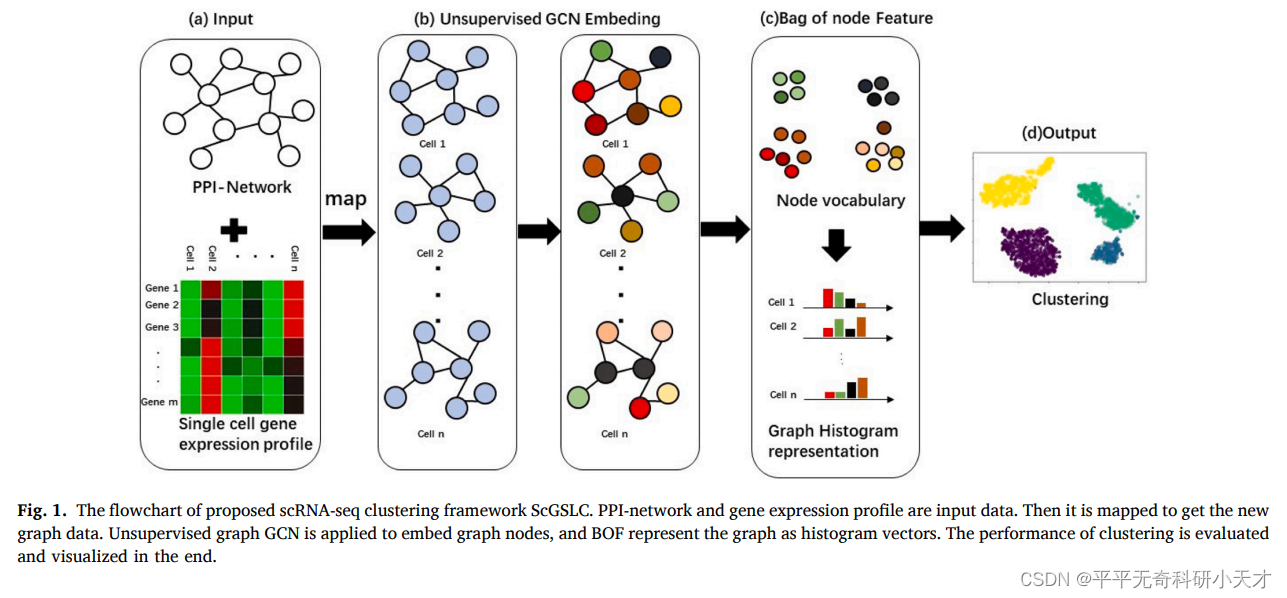

模型架构

数据预处理

- 输入数据包括基因表达谱和蛋白-蛋白互作网络(PPI)。对基因表达谱,行为基因,列为细胞,挑选方差最大的top5k的基因。

- 根据PPI将基因映射到网络结构中,但由于有的基因无法在PPI中找到对应ID,因此利用KNN算法(K=2)构建基因共表达网络,将基因共表达网络和PPI融合作为最终网络结构,以保证每个基因均可在网络中找到对应节点。

- 如果一个细胞中某基因的表达水平在低于设置的基因表达阈值,则移除该细胞中该基因对应的节点和相关的边。至此,每个细胞可以表示为一个图,细胞相关性可以用图相似性表示。

无监督图模型

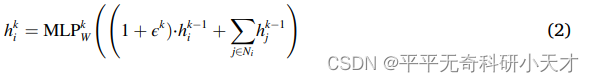

- 节点特征更新:对于每个细胞的图,采用GCN结合节点本身和其邻居节点的信息。具体方式采用2018年提出的图同构网络(GIN),传播方式如下:

MLP为多层感知机, ϵ为可训练的参数或超参数,Ni为基因i的邻居节点集合。 - Bag of features (BOF) 算法

常用的将图结构转回特征向量的方法包括kernel,graph2vec等,但他们均基于图的子结构,并未考虑边或节点的额外信息。因此本文采用BOF算法将每个图转化为特征向量。BOF算法中,所有图得到的节点特征{v0,v1,…,vm}为输入,根据节点向量进行聚类构建特征字典,将每个图表示为直方图向量。

BOF算法具体步骤:

输入:一系列特征向量,例如图中的节点特征,边特征,图像中的像素特征等。

(1)对所有特征向量聚类,例如k-means等,k根据应用场景指定参数。

(2)聚类后得到k个聚类中心,即k个特征向量。

(3)对于每个特征,寻找离他最近的聚类中心。遍历所有特征向量,计算每个特征中心出现的频率,得到特征中心的直方图向量,即长度为k的特征向量。

输出:长度为k的特征向量。

更多BOF原理相关解释参考该链接。

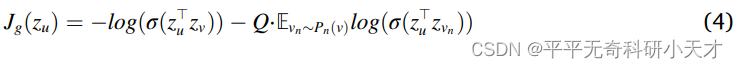

至此,每个细胞可表示为一个特征向量,可根据向量进行细胞聚类,识别细胞类型。 - 损失函数

图中节点u的损失函数如下所示,v为u进行随机游走得到的邻居节点。

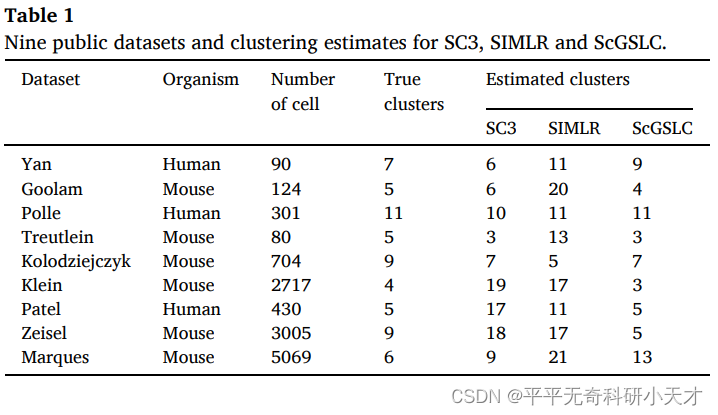

数据集

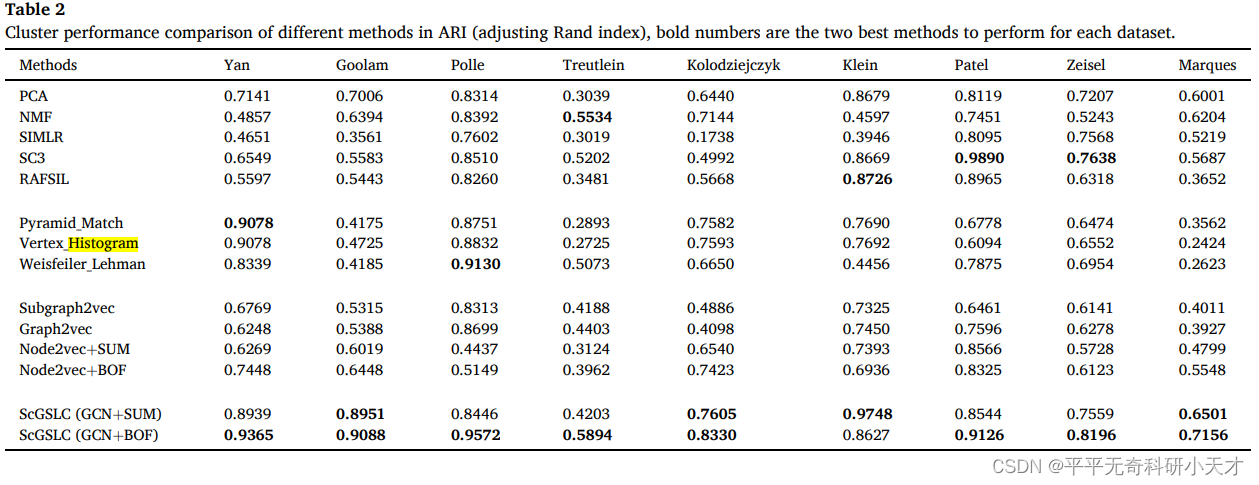

实验结果(ARI)

最后

以上就是秀丽溪流最近收集整理的关于文献调研-利用深度学习模型基于scRNA-seq数据识别细胞亚型Word2vec+LSTMGNN+BOF的全部内容,更多相关文献调研-利用深度学习模型基于scRNA-seq数据识别细胞亚型Word2vec+LSTMGNN+BOF内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复