当深入了解LSTM之后,就会面临以下两个问题:

- RNN中的梯度消失是如何产生的?

- LSTM又是如何解决梯度消失的?

本文就这两个问题展开了细节描述,各位同学看到这里的时候,请拿起手边的纸和笔,因为接下来会有大量的公式需要进行演算,只有自己一步一步推到才能够明白其中的数学原理,我也会尽量做到每个变量都说明清楚,每个推导都尽量做到细致。如有不当之处敬请指正,谢谢!

公式比较多,请大家耐心看下去~~~

一、RNN中的梯度消失是如何产生的?

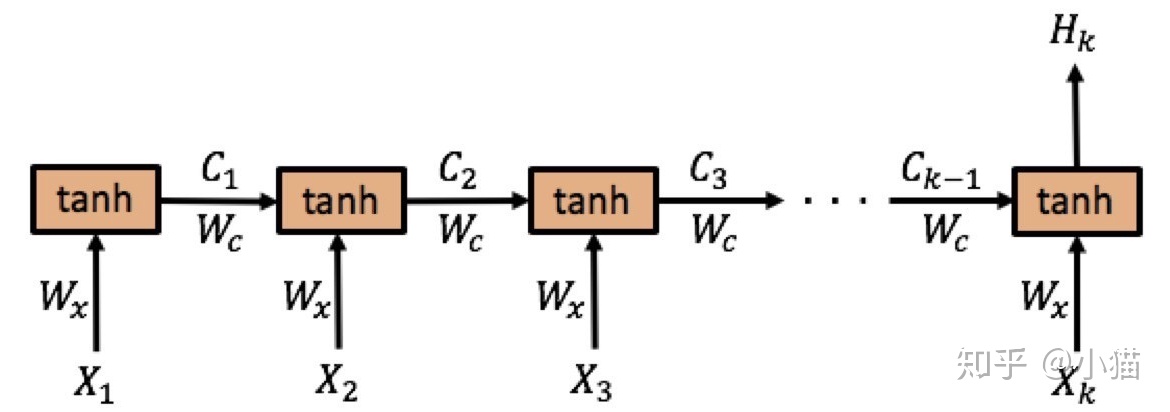

虽然RNN能够处理序列数据,并取得一定的效果,可是其也面临一个很大的问题,一旦序列数据很长,RNN网络将很难train的动,其中一个重要的原因就是在Backpropagation的时候,出现了梯度消失的问题,导致权重无法得到有效的更新,呈现出无法得到更新的现象。

在此,我先假设大家已经了解使用梯度下降的方法来做BackPropagation,也掌握RNN的原理。接下来我们来仔细看看其架构。

当我们需要更新

最后

以上就是明亮水壶最近收集整理的关于lstm 损失降不下去_RNN&LSTM中的梯度消失问题的全部内容,更多相关lstm内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复