分 类 回 归 树 与 随 机 森 林 分类回归树与随机森林 分类回归树与随机森林

机器学习:sklearn实现决策树和随机森林

Mushroom_CART

一 分类回归树

-

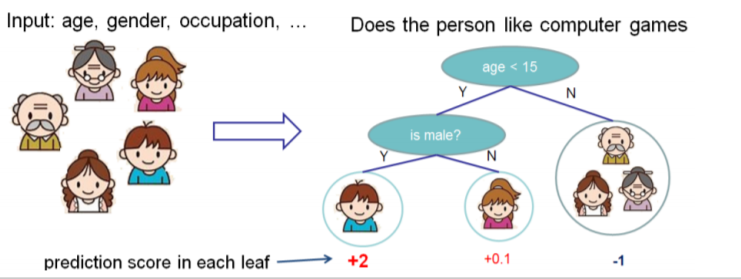

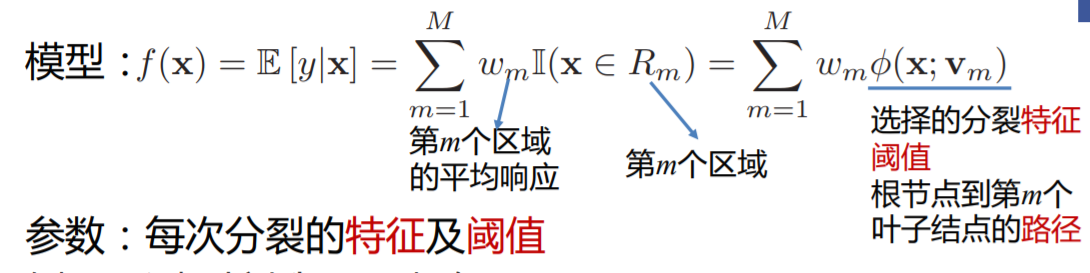

模型:树(非参数模型)

-

参数:分裂的特征及阈值

-

目标函数

– 损失函数:L2损失/GINI指数

– 正则项:树的节点数目(L0)、叶子结点分数平方和(L2) -

优化

– 建树

– 剪枝

- Classification And Regression Tree (CART): 机器学习十大算法之一,是一个用于监督学习的非参数模型

二分递归分割:将当前样本集合划分为两个子样本集合,使得生成的每个非叶子结点都有两个分支–>生成的树是二叉树

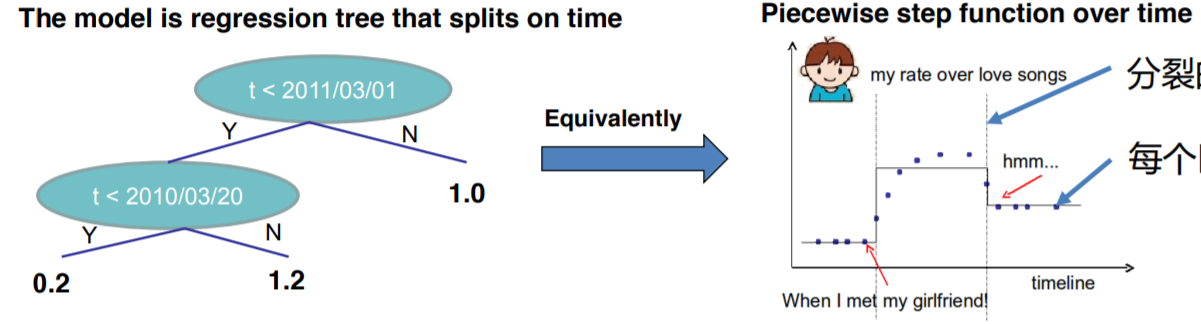

回归树

例:预测t时刻我是否喜欢Romantic Music

树模型的优点

- 容易解释

- 不要求对特征做预处理

– 能处理离散值和连续值混合的输入

– 对特征的单调变换不敏感 (只与数据的排序有关)

– 能自动进行特征选择

– 可处理缺失数据 - 可扩展到大数据规模

树模型的缺点

- 正确率不高:建树过程过于贪心

– 可作为Boosting的弱学习器(深度不太深)

- 模型不稳定(方差大):输入数据小的变化会带来树结构的变化

– Bagging:随机森林

- 当特征数目相对样本数目太多时,容易过拟合

二 随机森林

最后

以上就是失眠机器猫最近收集整理的关于分类回归树与随机森林的全部内容,更多相关分类回归树与随机森林内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

![决策表(决策树)[软件工程]](https://www.shuijiaxian.com/files_image/reation/bcimg14.png)

发表评论 取消回复