摘要

近年来,随着机器学习的流行,从数据中学习物品的相似性(或表示)已经成为ItenCF的一个重要部分。现有的itemcf的研究方法仅仅考虑了物品间的线性和浅层的关系,不能有效建模用户复杂的决策过程。文章提出了一种更具表现力的itemcf模型,考虑了物品间的非线性和高阶关系。模型通过非线性神经网络考虑所有交互物品对之间的交互作用。这样做的一个好处是模型可以区分用户交互过的所有物品中哪些物品对用户还未发生行为的一个物品的决策更加重要。文章还说通过融合更细粒度的注意力网络,模型的性能会进一步提高。

介绍

Cf分为UserCf和ItemCF两种方法,其中MF是经典的usercf方法。ItemCF通过用户交互过得所有物品表达用户的兴趣信息,利用目标物品和用户交互过得物品之间的相似性来估计目标物品和用户的相关性。

Itemcf的优势:

Itemcf在很多方面要优于usercf。首先,itemcf通过很多交互过得物品信息来建模用户的兴趣,相比于MF只是通过一个用户ID建模用户的兴趣信息,itemcf建模的输入信号要更广泛,来源更多。这很有可能导致itemcf比usercf在建模用户的兴趣信息上更准确和更具有可解释性。其次,ICF在用户兴趣建模中的可组合性使得在线个性化更容易实现,意思就是实时性更好,不需要一直更新模型的参数。早期的itemcf使用统计指标比如说皮尔逊系数或者余弦相似性来计算两个物品之间的相关性。这样做得手动调整参数不方便,泛化性很差。近几年来,以数据驱动的策略被用来学习物品之间的相关性,代表性方法有稀疏线性方法(SLIM)与分解物品相似模型(FISM),其中SLIM在稀疏性和非负性约束下直接学习物品相似性矩阵,在FISM中,两个物品间的相似性被建模为两个物品潜在向量的内积,其中的相似性矩阵可以被看做是低秩的。该部分后面提到的方法是对上述两种方法的改进,就不细说。

高阶物品关系的好处:

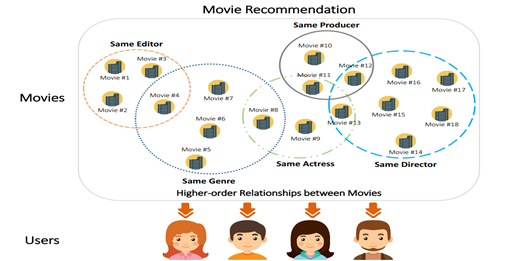

上述的方法只建模了一对物品的二阶关系。如果两个物品共享一些属性那么他们可以被一块消费,但是只考虑二阶关系的话就建模不了这个信息。文章的二阶关系指的是直接通过内积得到的关系。比如说MF,这就是二阶关系。其实常规的itemcf他就能考虑高阶关系,但是之前训练出来出来的物品相似度矩阵它仅仅考虑的二阶关系。高阶关系指的是比如说两个电影都是同一个导演或者同一个演员或者两个都是。也比如说两个物品有功能互补的属性,这些都是高阶关系。本文能够自动的将高阶物品关系的影响编码到用户兴趣建模中。

本文的提案和贡献

本文利用神经网络方法实现建模物品之间的高阶关系,文章将物品高阶关系的学习集成到捕获二阶物品关系的预测模型中,但使用不同的神经网络组件来捕获这两种物品关系。在神经网络的底层,通过将一对物品的embedding做内积来建模这对物品的二阶关系。然后再堆叠几层神经网络以非线性的方式建模物品间的非线性关系。

准备工作

Itemcf的通用框架

文章在这部分又强调了下itemcf相对于usercf在可解释性,性能,易于线上服务的优势。

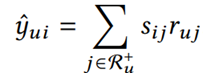

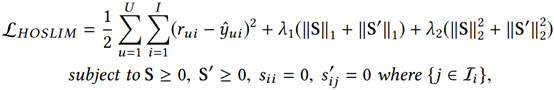

SLIM 和 Higher-Order SLIM(HOSLIM)

其中,λ1是L1正则化的参数,这个参数用来强化相似性矩阵的稀疏性,λ2是L2正则化的参数,用来控制模型过拟合。S是物品间的相似度矩阵,是需要学习的模型参数。但是LSIM没有考虑物品间的高阶关系。(一些物品共现,或者有相 同的属性)。

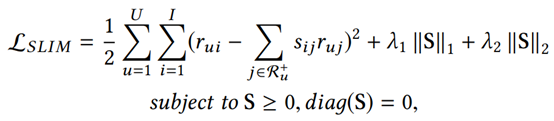

因此,HOSLIM方法在SLIM方法的基础上提出了改进,融入了物品间的高阶关系,既考虑了物品-物品的二阶关系,也考虑了物品-特定物品集合间的高阶关系。

ru是在二阶物品关系空间用户u对交互物品的交互特征,si是物品i在二阶物品关系空间中的相似性。后面那一项是物品高阶关系空间中的用户对每一类物品集合的交互特征,和目标物品对每类物品集合的相似性。

这个S 和S^'分别代表物品-物品相似性矩阵和物品-物品集合的相似性矩阵。上面的模型存在几个问题。(1)得手动调整找到各类物品集合的阈值。(2)线性和静态的方式捕捉物品间的高阶关系。

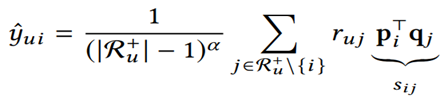

FISM 和 NAIS Methods

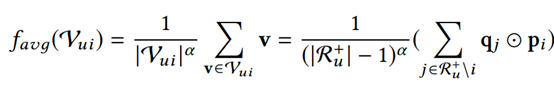

这是FISM的模型表达式,其中p_i和q_i表示目标物品i和历史交互过的物品j的潜在特征表示,物品i和物品j的相似性可以理解为p_i和q_i的内积,α控制着标准化程度,取值为0到1.模型的一个缺点是对于模型预测任务,所有的物品对对于目标物品用了相同的权重。

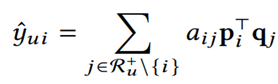

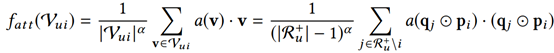

这是NAIS的模型表达式,NAIS在FISM的基础上做出了改进,融入了权重矩阵

参数矩阵a,用来建模预测任务中用户已经交互过的所有物品对目标物品的用户决策重要性。

方法

Model

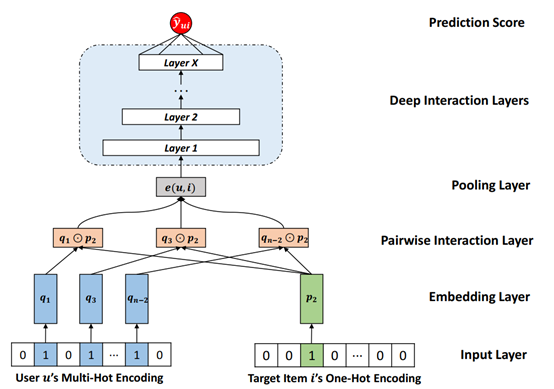

Input and Embedding Layer:

对用户进行Multi-Hot编码,对物品进行one-hot编码,其实也就是对每个物品都进行embedding层的映射,然后用用户交互过的物品的embeddings来表示用户信息。

Pairwise Interaction Layer:

看图就能明白,就是对embeddi层的输出的用户表示特征分别与目标物品的特征做两两内积,做二阶关系建模。

Pooling Layer:

不同的用户,Pairwise Interaction 层输出的特征数量很有可能不同。池化层的作用就是为了生成固定尺寸的向量,以便后续处理。通过权重平均池化和权重注意力网络的设计,模型进一步分为DeepICF和 DeepICF+a这两个模型。

这是DeepICF模型的池化层。

这是DeepICF+a模型的池化层,可以看出,这是DeepICF模型的改进,融入了几层MLP层做的Attention。

Deep Interaction Layers:

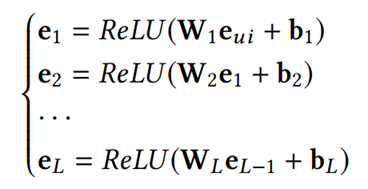

这个没啥可说的,就是通过几层MLP做的交互,学习高阶的物品之间的关系。

Prediction Layer :

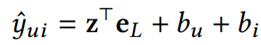

深度交互层输出的是一个融合了物品高阶信息的用户决策特征,在预测模块,模型通过一个剪刀的线性回归模型来做预测评分,Z是回归模型的权重矩阵,后面这两项是用户和物品偏差。

最后

以上就是幸福导师最近收集整理的关于Deep Item-based Collaborative Filtering for Top-N Recommendation 阅读心得摘要介绍准备工作方法的全部内容,更多相关Deep内容请搜索靠谱客的其他文章。

发表评论 取消回复