一、维数灾难(Curse of dimensionality)

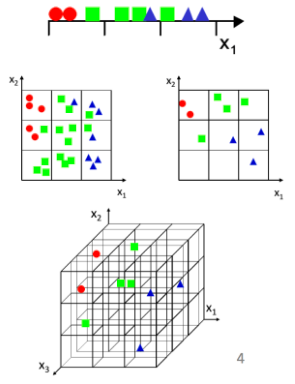

维数灾难就是说当样本的维数增加时,若要保持与低维情形下相同的样本密度,所需要的样本数指数型增长。从下面的图可以直观体会一下。当维度很大样本数量少时,无法通过它们学习到有价值的知识;所以需要降维,一方面在损失的信息量可以接受的情况下获得数据的低维表示,增加样本的密度;另一方面也可以达到去噪的目的。

有两种办法试图克服这个问题:首先是特征提取(Feature extraction),通过组合现有特征来达到降维的目的;然后是特征选择,从现有的特征里选择较小的一些来达到降维的目的。下面开始介绍特征提取。

二、特征选择

三大类方法

根据特征选择的形式,可分为三大类:

- Filter(过滤法):按照

发散性或相关性对各个特征进行评分,设定阈值或者待选择特征的个数进行筛选 - Wrapper(包装法):根据目标函数(往往是预测效果评分),每次选择若干特征,或者排除若干特征

- Embedded(嵌入法):先使用某些机器学习的模型进行训练,得到各个特征的权值系数,根据系数从大到小选择特征(类似于Filter,只不过系数是通过训练得来的)

最后

以上就是现代自行车最近收集整理的关于特征挖掘(一):问题与方法总结一、维数灾难(Curse of dimensionality)二、特征选择的全部内容,更多相关特征挖掘(一):问题与方法总结一、维数灾难(Curse内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复