声明:本文来自于微信公众号 新智元,作者:新智元,授权靠谱客转载发布。

【新智元导读】就在刚刚,老黄在SIGGRAPH大会上透露:Blackwell的工程样片,已在本周正式向全世界发送!随后,老黄和小扎展开了炉边对话,并且亲密换衣,说到激动处,小扎气得一度爆粗。

惊爆消息来了!

刚刚,老黄在SIGGRAPH计算机图形会议上透露:就在本周,英伟达已经开始向全世界发送Blackwell的工程样片了!

紧接着,主持人Lauren Goode便调侃道:没错,大家低个头,凳子下面就有。

值得一提的是,在这款当今最强的AI芯片背后,同样也离不开AI——

没有AI,Hopper将无法问世;没有AI,Blackwell也无法成为可能。

在他和小扎上演的一场炉边对话中,讲到情绪激动时,小扎甚至一度忍不住出口爆粗。

由于两位大佬之前的换衣效果实在是一言难尽。

这次,小扎专门给老黄送上了定制的「黑皮衣风」棉服。

上身之后,的确效果拔群!

当然,小扎也穿上了老黄仅用了2小时的「二手」皮衣。(这可比全新的值钱多了)

英伟达的数字「副本」世界

在大会上,老黄宣布,英伟达构建了世界上首个能够理解基于 OpenUSD(语言、几何、材料、物理和空间的生成性AI模型,

什么是OpenUSD呢?它指的就是Universal Scene Description,可以理解为一种通用场景描述。

老黄表示,比起AI对文本执行的操作,更令人兴奋的,是我们可以对图像执行同样的操作。

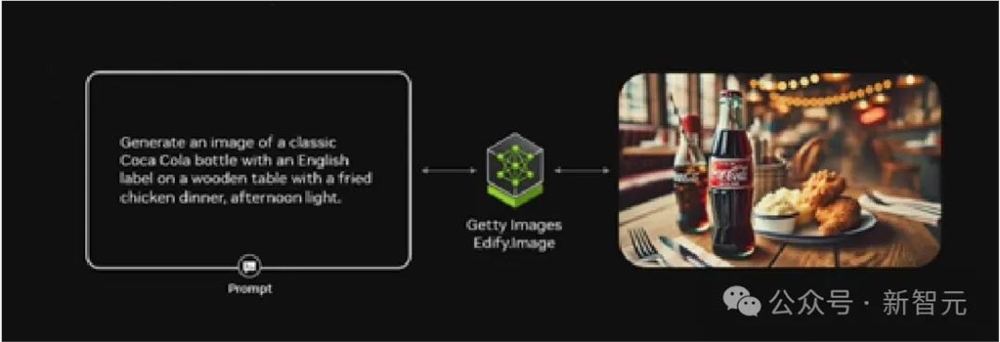

比如英伟达创建的Edify AI模型,就是一个文本到2D的基础模型。

对于品牌来说,它可以创造出可口可乐、汽车、奢侈品等等,然而控制提示,就是一件困难的事。

这是因为,词语的纬度非常低,它在内容上极其压缩,但同时又非常不精确。

为此,英伟达创造了一种方法——创造另一个模型,实现控制和调整它与更多条件的对齐。

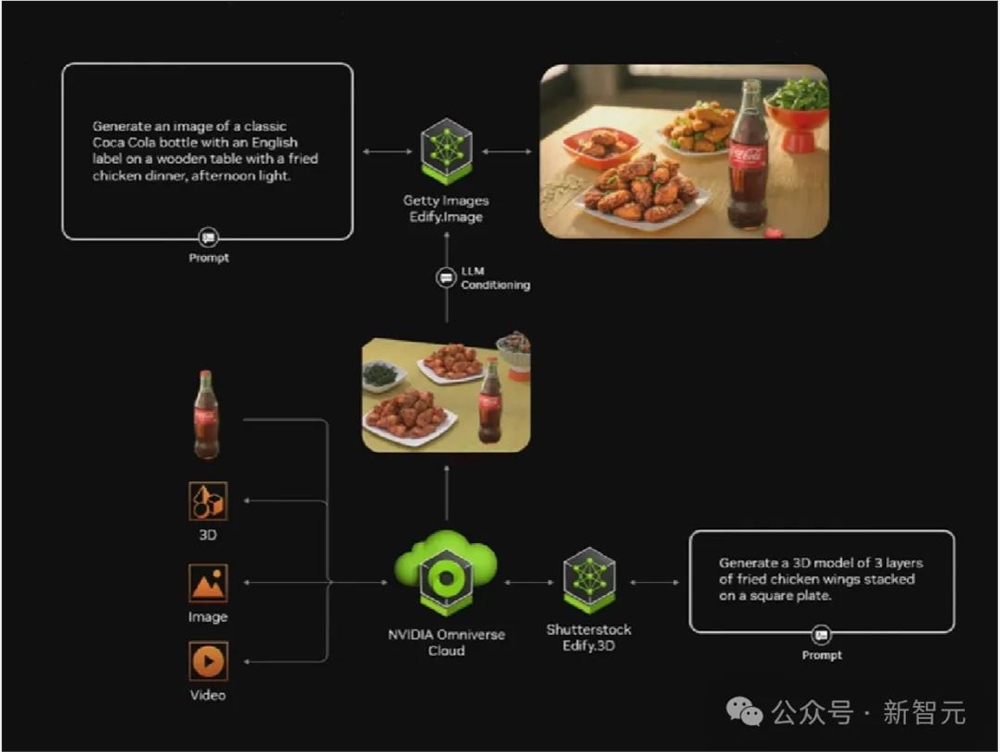

使用Omniverse,可以组合所有这些多模态数据和内容,无论是3D,AI,动画,还是材质。

我们可以改变它的姿势、位置,总之改变我们想要的任何东西。

使用Omniverse中的条件化提示,就跟检索增强生成一样,可以理解为一种3D增强生成。

这样,我们就可以按照喜欢的方式生成图像了。

接下来,WPP用Shutterstock与世界知名品牌完成的作品,直接震撼了全场。

在一个空房间里给我建一张桌子,周围摆着椅子,在一个繁忙的餐馆里。

在晨光中给我建一张摆着玉米卷和一碗莎莎酱的桌子。

在一条空旷的道路上给我建一辆车,周围是树木,靠近一座现代房屋。

在一片空旷的田野里给我建一棵树。

在所有方向给我建数百棵这样的树。

让这片树林有灌木丛和藤蔓悬挂其间。

给我建一片巨大的热带雨林,里面有奇异的鲜花和阳光射线。

Omniverse现在能够理解文本到USD的转换。它能够理解文本,并拥有一个语义数据库,因此可以搜索所有的3D对象。

因此,小女孩可以描绘自己想以什么方式填充3D树,完成之后,3D场景就会进入生成式AI模型,将其转化为照片级真实感的模型。

从此,越来越多的生成式AI会出现在Omniverse中,帮人们创建这些模拟,或数字孪生。

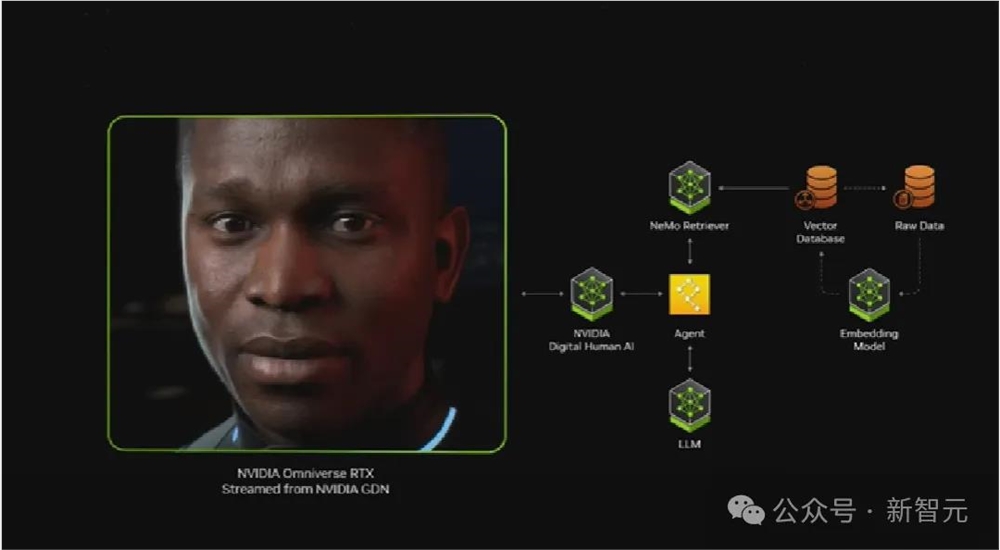

比如下面这个数字AI,将使每家公司都有客户服务。

在当下,客户服务是由人类完成的,但在未来,AI将参与其中。

客户服务会连接到一个数字人前端,也就是一个IO。这个IO可以说话,还能与我们眼神交流。

各类AI都可以连接到这个数字人,甚至数字人还可以连接到英伟达的检索增强生成客户服务AI上。

NIM服务

这次大会上,英伟达推出了一套全新的NIM微服务。

NIM专为不同的工作流量身定制,包括OpenUSD、3D 建模、物理、材料、机器人、工业数字孪生和物理AI。

在AI和图形领域,英伟达推出了专为生成物理AI应用程序设计的全新OpenUSD NIM微服务。

这个工作流包括,用于机器人模拟等的新NIM微服务,来加速人形机器人的开发。

「三体」创造机器人

老黄预言,下一波AI,是物理AI。

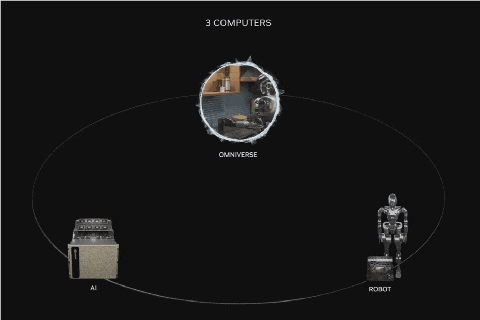

如果机器人技术想进步,就需要先进的AI和逼真的虚拟世界;而在部署下一代人形机器人之前,我们需要对AI进行训练。

机器人技术需要三台计算机:一台用于训练AI,一台在物理精确的模拟中测试AI,另一台位于机器人本身内部,可以学习如何优化机器人。

也就是说,第三台AI是实际运行AI 的计算机。

为此,英伟达创造了三台计算机。

没有AI,就没有H100/H200和B100

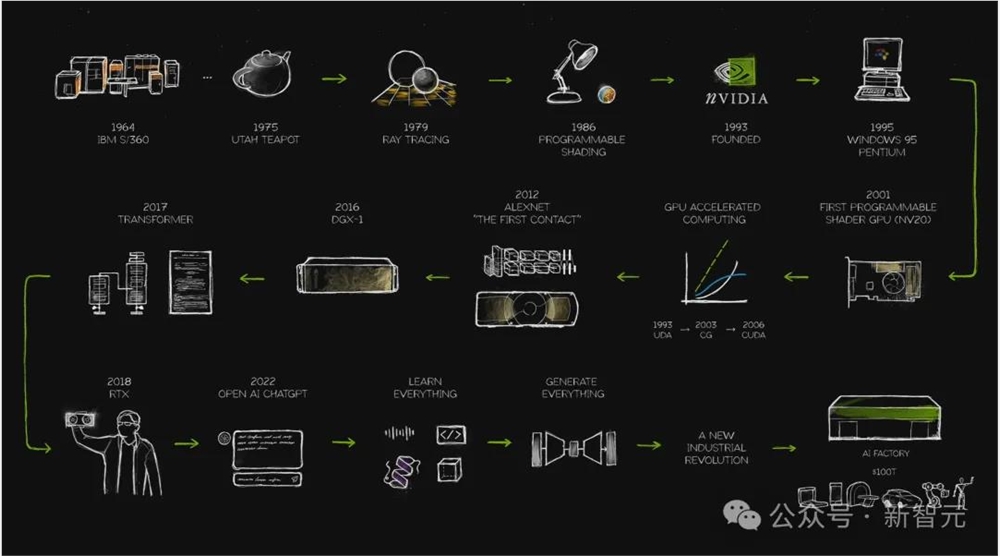

从1990年代开始的英伟达历史中,真正的DNA就在于计算机图形学。

计算机图形学,也一路把英伟达带到了今天的位置。

这幅图中,展示了计算机行业一些重要的里程碑,包括IMB360系统、犹他茶壶、光追、可编程着色等等

1993年,英伟达成立。八年后,他们发明了第一个可编程着色GPU,很大程度上推动了英伟达的发展历程。

可以说,英伟达所做的一切,背后的核心就是加速计算。他们坚信,如果创建一种计算模型来增强通用计算,就可以解决普通计算机无法解决的问题。

首选的领域,就是计算机图形学。他们赌对了。

将计算机图形学应用到当时非主流的领域——3D图形视频游戏,直接推动了英伟达的飞轮。

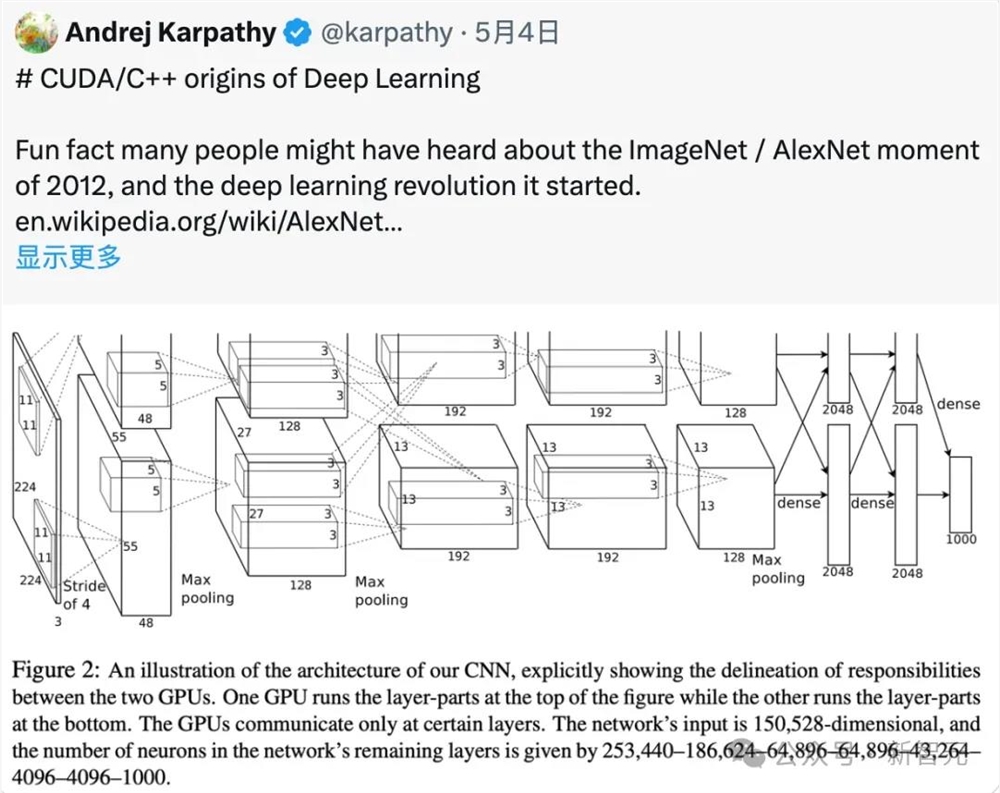

此后,他们花了很长时间让CUDA无处不在,然后在2012年,就仿佛《星际迷航》中一般,英伟达第一次接触了AlexNet。

在2012年,那是一个爆炸性的时刻,AlexNet在计算机视觉上取得了惊人的突破。它的核心——深度学习如此深刻,再也不需要工程师们提供输入后,去想象输出的样子了。

2016年,英伟达推出了第一台为深度学习打造的计算机DGX-1,被马斯克看上,随后产品被交付给当时名不见经传的OpenAI。

随后,RTX、DLSS被发明出来。

然后,就是ChatGPT的诞生。

未来人人都有AI助手

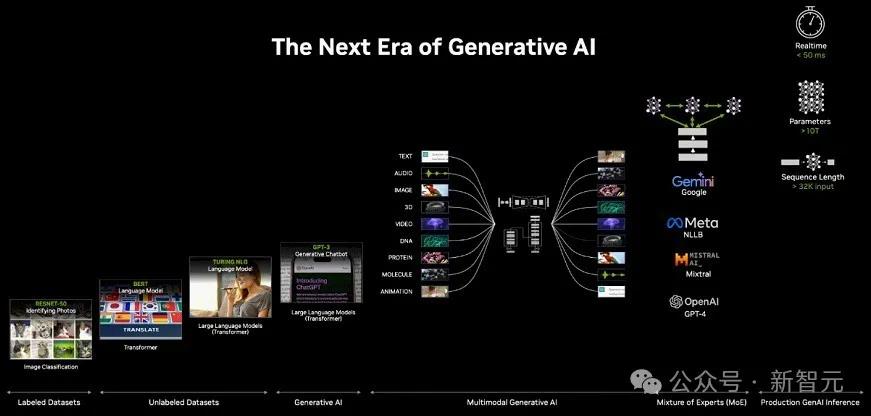

如今,我们已经学会用AI学习一切,不仅仅是单词,还有图像、视频、3D、化学物质、蛋白质、物理学、热力学、流体动力学、粒子物理学等等。

我们理解了所有这些不同模态的意义。

在老黄看来,基于视觉计算的生成式AI革命,正在增强人类的创造力。

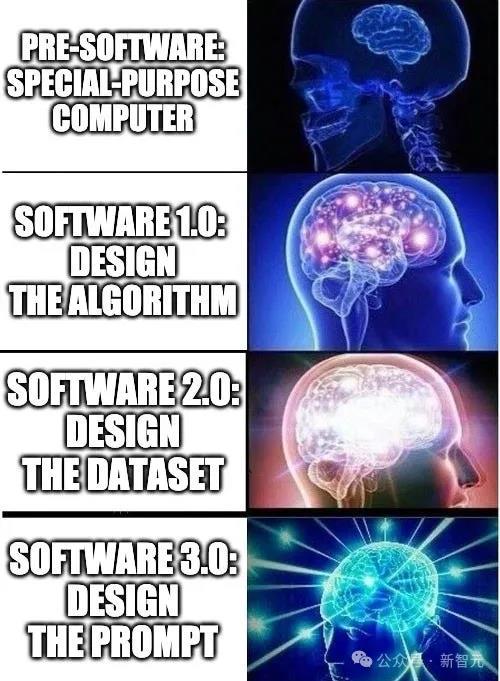

我们真正处于革命性的时刻,迈向软件3.0的时代——没有哪个行业,能逃过AI的影响!

老黄预言:每个人都会有一个AI助手,每家公司、公司内的每一项工作,都将得到AI的帮助。

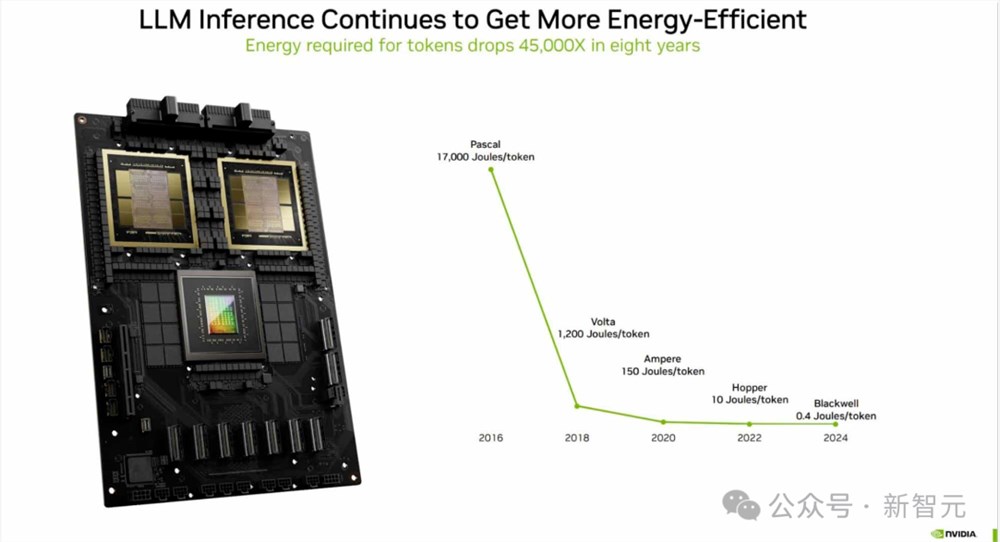

加速计算,让能源问题有解

虽然生成式AI有望提高人类生产力,但AI基础设施的耗能问题,却是困扰整个地球的大问题。

ChatGPT的一次搜索,相当于10次谷歌搜索的电量。

数据中心消耗了全球总体能源的1%到2%,甚至可能在十年内达到6%。

怎么办?老黄有解。

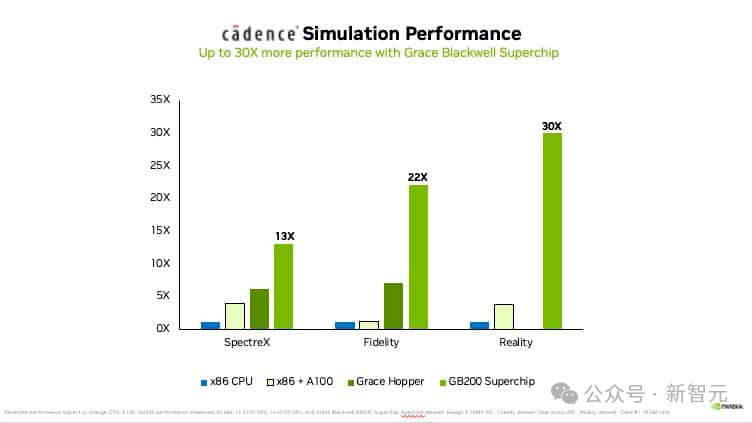

他表示,加速计算技术,有望使计算更节能。

「加速计算可以帮我们节省大量能源,它能节省20倍、50倍,并且执行相同的处理,」老黄说。

「作为一个社会,我们要做的第一件事就是加速我们能做到的每一项应用:这减少了全世界的能源使用量。」

这也是为什么Blackwell备受期待,因为它使用同样的能量,却大大加速了应用程序。

而且,它还会越来越便宜。

老黄强调:要记住,生成式AI的目标并不是训练,而是推理。理想情况下,推理可以为我们创建预测天气的新模型、预测新材料、优化供应链等等。

要知道,数据中心并不是唯一消耗能源的地方。全球数据中心只占总计算量的40%,60%的能源消耗在网上,移动着电子、比特和字节。

因此,生成式AI将减少网上的能源消耗,因为不需要去检索信息,我们可以在现场直接生成了。

而且就在刚刚,英伟达在GCP中部署了GPU,来运行Pandas。

这个世界上最领先的数据科学平台,直接把速度从50提升到了100倍,超过了通用计算。

在过去10到12年的时间里,我们已经将深度学习的速度提升了100万倍,成本和能耗降低了100万倍,这就是为什么LLM能够诞生。

不过,英伟达还会通过设计新的处理器、新系统、Tensor核心GPU和NVLink交换机结构,给AI带来新的创新。

老黄和小扎的炉边对谈

今年SIGGRAPH上两位CEO的炉边对谈让很多人期待已久。用小扎本人的话来说,「两个行业内最资深的创始人」,究竟会碰撞出怎样的火花?

下一波浪潮

不出意外的是,这两位「青梅煮酒」的英雄都各自分享了自己的预判,大谈未来的技术发展趋势,从GenAI,到Agent,再到小扎始终念念不忘的「元宇宙」。

老黄表示,GenAI的技术力量也让他感到震撼,「我不记得有哪项技术以如此迅猛的速度影响了消费者、企业、工业和学界,而且跨越了从气候技术到生物技术,再到物理科学的所有不同领域。」

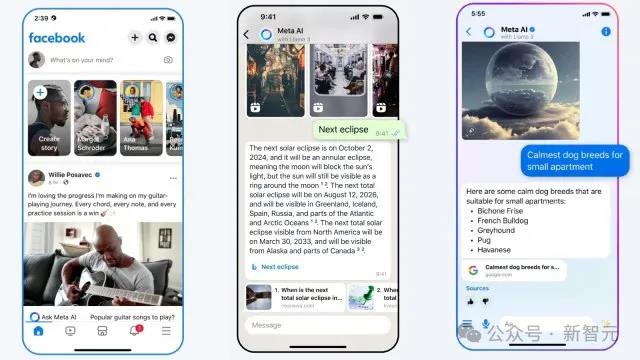

小扎也表示,GenAI很可能会重塑Meta的各类社交媒体软件。

曾经,这些产品的核心——推荐系统,仅仅是将感兴趣的内容推送给用户。

但GenAI将不再局限于已有内容,不仅能协助创作者,还会为用户创建即时内容,或综合现有内容进行生成。

关于Agent的发展,两人似乎也有类似的观点。

在之前的演讲中,老黄就明确表示,「未来每个人都将有自己的AI助手」。

这场对谈中,小扎也表述了类似的愿景。他正在为Meta规划AI助手和AI Studio产品,让每个人都能为不同用途创建自己的Agent。

未来,每个企业都将拥有自己的AI,正如今天所有公司都有自己的社交媒体和邮箱账号一样。

他们口中的「AI助手」,究竟要达到何种程度的「智能」?

我们目前看到的Llama3仅仅是一个「聊天机器人」般的语言模型,只能对人类的提问做出响应。但小扎希望,可以给AI赋予「意图」(intent)。

老黄则将其描述为「规划能力」,能像人类一样在脑海中形成「决策树」,进而指导行为。

他甚至更大胆地预测,这种AI助手的成本仅有每小时10美元,却能大大提高工程师们的工作表现。「如果你还没雇佣AI,就赶紧行动起来!」

对于Meta最核心也是最独特的AR/VR技术,小扎的蓝图也相当精确,充分体现了他的强迫症人格。

(据老黄爆料,小扎切西红柿都有毫米级的精度,而且每片西红柿都不能相互接触。)

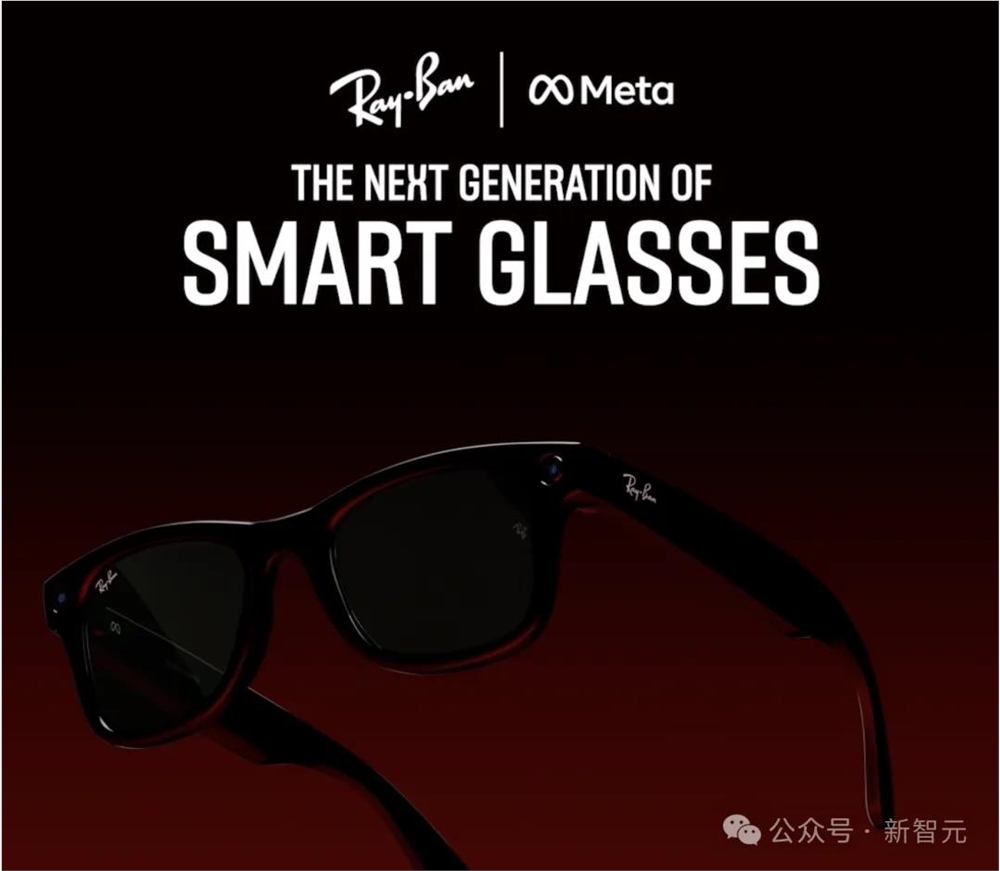

去年9月,Meta联合雷朋推出了新款智能眼镜,配备音频设备和摄像头,让用户直接从双眼视角拍照,或将眼镜中看到的视野直接直播到Facebook或Instagram上,并集成了对话助手Meta AI。

小扎表示,基于雷朋眼镜现在的情况,定价300美元的无显示屏AI眼镜将成为非常热门的产品。

根据他的预测,智能眼镜在未来会成为一种类似手机的设备,每个戴眼镜的人都将带上智能眼镜(全世界超过10亿人)。

接下来几年时间,Meta还将推出有全息AR功能的眼镜,虽然成本依旧很高,但将会是可行的产品。

与智能眼镜不同,混合现实头显更类似于工作站或游戏机,不方便携带但算力更强,能为用户提供更加沉浸式的体验。

而且,随着全息AR技术的发展,「虚拟会议」即将成为现实。

不同于Zoom平台上的头像或视频,每个人都将有自己的全息影像,即使身处不同的物理空间,也能让全息图打造的「虚拟人」在同一空间内合作交互。

开源是前进之路

提到Meta,他们一贯实行的「开源」策略也是不得不谈的要点。

老黄就十分赞赏这种策略,他表示,Llama2可能是去年AI领域最重要的事件;加上PyTorch和最新发布的Llama3.1,Meta已经构建了一整个生态系统。

但小扎表示,他们走上开源之路也是一种「随机应变」。

在很多赛道上,尤其是分布式计算系统和数据中心方面,Meta的起跑线其实落后于其他公司,因此团队想到了开源,尤其是开放计算(open compute)。

没有想到的是,这种权宜之计反而成为「弯道超车」的关键策略。

正是开源,让Meta发布的产品成为行业标准,整个供应链也围绕其建立。通过将项目开源,Meta甚至还节省了数十亿美元。

比如,Meta进入GPU领域的时间其实晚于大多数公司,但他们目前运营的GPU超算集群,规模几乎超过了所有竞争对手。

当然,这背后少不了老黄的大力支持,毕竟Meta的60万张GPU也都出自英伟达之手。

开源虽然能推动这个社区和行业的进步,但小扎也很诚实地表示,开源不是做慈善,我们选择这种策略并不是因为有一颗无私奉献的心。

更主要的目的,是希望让正在构建的产品登峰造极,成为最好的东西。

PyTorch就是最典型的例子,全世界的开发人员,包括英伟达的两三百名工程师,都在帮这个开源框架找bug、做优化,构成了老黄口中的「PyTorch的工程之山」。

虽然小扎自己也承认,开源是有私心的,但谈到「封闭」平台时还是克制不住地情绪激动。全场唯一脏话就出自这个话题。

虽然Meta坐拥一众王者级社交软件,但这些应用程序都需要通过竞争对手的平台进行分发,尤其是苹果应用商店,以及谷歌的安卓系统。

让小扎很气恼的是,他曾经有过很多产品创意,但受限于这些移动平台的各种限制,最终都无法成行。

移动互联网时代的这种极度依赖平台的特点,与曾经PC时代的开放完全不同,这让小扎相当怀念网页端的Facebook。

因此,他满怀信心地表示,我们正在塑造下一代计算平台,即混合现实技术,其中开源软件将重新拥有更大的价值。

下一代平台和生态系统将更具有开放性、包容性,类似之前的Windows或安卓生态,而非完全封闭的苹果。

这种「让开源重新伟大」的雄心,让人不禁想起Llama3.1发布时他的比喻——Llama3.1是这个时代的Linux。

CEO不好做

整个对谈过程中,两人颇有惺惺相惜之感,而且经常谈到CEO这份职业的艰难。

时年61岁、穿着皮夹克的Jensen甚至一脸严肃地自比娇花:「我们是CEO,像娇嫩的花朵,需要很多支持。」

小扎甚至紧跟着接了一句,「我们现在相当憔悴了」。

这种感慨,也许来自于两位资深创始人曾经和公司共同经历的风雨。

在小扎看来,老黄当年顶着不被看好的压力,硬要把计算机做成「超级巨兽」,让英伟达终成行业传奇;

在老黄看来,小扎带着Meta多次转型,从PC端到移动端,从社交媒体到VR/AR和AI的研究。

对谈的最后,老黄直言两人的共同之处,「我知道那样做(转型)有多难,我们两个都曾经被狠狠打击过,但这就是成为先锋和创新所必备的。」

参考资料:

https://www.youtube.com/watch?v=H0WxJ7caZQU

https://www.youtube.com/watch?v=w-cmMcMZoZ4

(举报)

发表评论取消回复