概述

GRU(Gated Recurrent Unit)是Cho在2014年提出,为LSTM的一个变种,GRU保持了LSTM的效果、结构更加简单易于训练,同时也可以解决长短时记忆和梯度问题。

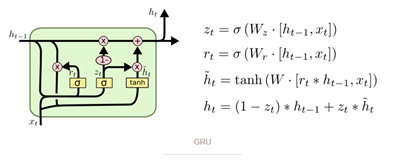

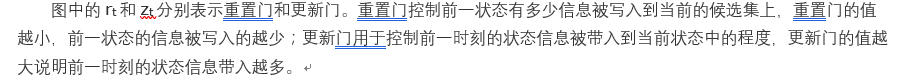

在LSTM中引入了三个门函数:输入门、遗忘门和输出门来控制输入值、记忆值和输出值。而在GRU模型将细胞状态和隐藏状态进行混合,其中只有两个门:分别是更新门和重置门。具体结构如下图所示:

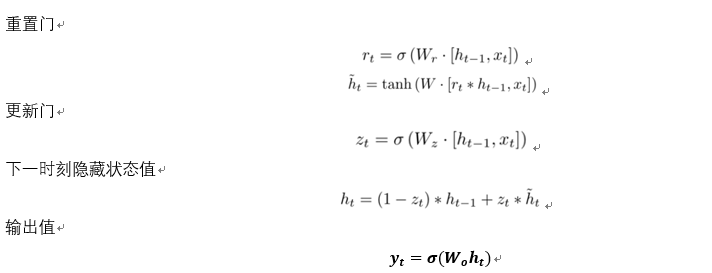

前向传播

最后

以上就是花痴背包最近收集整理的关于GRU理解概述前向传播的全部内容,更多相关GRU理解概述前向传播内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复