下图所体现出来的知识点:

红色字体表示隐藏知识点

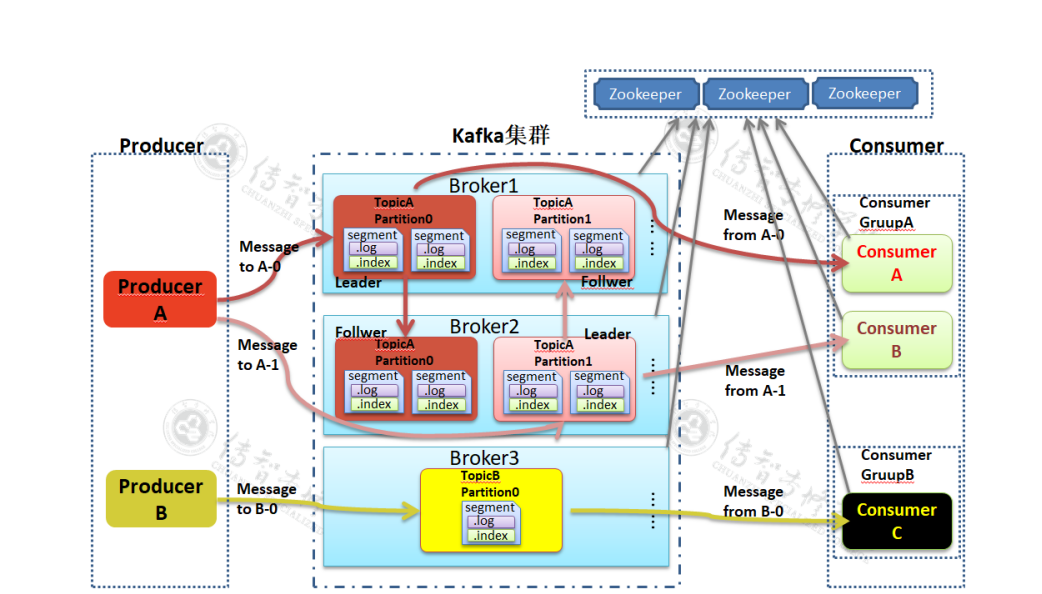

1、kafka生态系统四大角色:生产者(Producer)、kafka集群(Broker)、消费者(Consumer)、Zookeeper。

2、每个消费者都必须属于一个消费组,一个组内的消费者可以有多个。

3、一个Topic(主题)可以有1到多个Partition(分区)。

4、一个Partition可以有1到多个 segment。

5、每个 segment 由一个 log 和 一个 index 文件组成。

6、被复制的分区叫做 Leader(主副本),复制出来的叫做 Follower(从副本)。

7、生产者只往主副本写数据,消费者只从主副本拉取数据。

8、从副本只做数据备份,不做数据读写。

9、一个分区内的一条数据,只能被一个消费组内的一个消费者消费。

10、消费者的最大并发度由 topic 的分区数量决定。

11、分区副本的数量必须小于等于 broker 的数量。

12、一个 topic 内的多个分区,每个分区只是所有数据的一部分。所有分区的数据累加到一起是这个 topic 的全部数据。

13、zookeeper 中记录了 broker 的 id 、消费者消费数据的 offset,消费者与partition的对应关系(ConsumerA—>Partition-0,ConsumerB—>Partition-1)

1、什么是kafka

- 是一个分布式、分区的、多副本的、多订阅者的消息发布订阅系统。

2、kafka的使用场景

- 应用耦合

- 异步处理

- 削峰限流

- 消息驱动的系统

如何理解参考:https://blog.csdn.net/wzc8961661/article/details/104913727

3、kafka优点

- 可靠性强(分布式-分区-副本)

- 扩展性强(可伸缩)

- 性能高(数据读写)

- 耐用性强(数据持久化)

- 时效性强

4、kafka缺点

- 由于是批量发送,数据并非真正的实时。

- 仅支持同一分区内消息有序,无法实现全局消息有序。

- 有可能导致消息重复消费。

- 依赖 zookeeper 进行元数据管理。

5、kafka架构(流程)

- 生产者(Producer)—>

- kafka集群(Broker)—>

- 消费者(Consumer)—>

- zookeeper。

6、kafka架构(API)

- 生产者(Producer)—>

- 消费者(Consumer)—>

- StreamAPI(实时流)—>

- ConnectAPI(连接)。

**7、Topic 内部有哪些组成 **

- 每个 Topic 包含一个或多个 Partition(分区)

- 一个 Partition(分区)中存在多个 segment 文件段

- 每个 segment 分为两部分:.log 文件和 .index 文件

8、分区和消费组内的消费者之间的关系有哪些情况?

Partition = 消费任务的并发度=刚刚好,每个任务读取一个 Partition数据Partition > 消费任务的并发度=有部分消费任务读取多个分区的数据Partition < 消费任务的并发度=有部分消费任务空闲(可以创建多于分区的消费者数量)

9、分区数、消费者与读取效率之间的关系

分区数越多,同一时间可以有越多的消费者来进行消费,消费数据的速度就会越快,提高消费的性能

10、副本数与 Broker 之间的关系

数据副本(包含本身)数一般情况下小于等于 Broker 的个数

11、什么是 主/从副本

- 被复制的分区叫做主副本(Leader)

- 复制出来的叫做从副本(Follower)

12、主/从副本的作用是什么

- 主副本负责数据的 读写

- 从副本只做数据备份,不做数据读写

13、LSR是什么

- lsr 是一组与 leaders 完全同步的消息副本(包括 leaders 本身)

14、生产者生产数据到kafka集群,数据到分区的方式

- a、没有指定分区编号,没有指定 key 时,采用轮询方式发送数据

- b、没有指定分区编号,指定 key 时,数据分发策略为对 key 取 hash 值,这个值与分区数量取余,余数就是分区编号。

- c、指定分区编号,所有数据输入到指定的分区内

- d、自定义分区

15、Consumer 消费数据的流程

- a、首先 Consumer 连接指定的 Topic partition 所在的 leader broker,使用折半/二分查找,先确定数据所在的 segment

- b、确定在哪个 segment 后,使用确定的 segment 内的 index 文件,找到数据具体的位置采用 pull 方式从 kafkalogs 中获取消息

16、kafka 中的数据删除机制是什么

- a、时间维度:默认存储168小时(一周)

- b、数据大小:默认 -1(不删除),可以自行设置

17、kafka 如何保证数据不丢失

- a、生产者如何保证数据不丢失?

- 答:通过 ack 机制,确保数据不丢失

- b、kafka 集群如何保证数据不丢失?

- 答:通过数据副本保证数据不丢失

- c、消费者如何保证数据不丢失?

- 答:通过维护数据的 offset(偏移量)值保证数据不丢失

18、kafka 高性能的原因有哪些

- 顺序读写

- 分区

- 批量发送

- 数据压缩

19、kafka 高效查询数据的原因有哪些

- a、kafka 把 topic 中一个 partition 大文件分成多个小文件段(segment),通过多个小文件段,就容易定期清除或删除已经消费完的文件,减少磁盘占用

- b、通过索引信息可以快速定位 message 和确定 response 的最大大小

- c、通过 index 元数据全部映射到 memory,可以避免 segment file 的 IO 磁盘操作

- d、通过索引文件稀疏存储,可以大幅降低 index 文件元数据占用空间大小

20、如何从 kafka 得到准确的信息(不是重读数据)

- a、在数据生产过程中避免重复

- b、在数据消耗过程中避免重复

21、kafka 的设计是什么样的

- kafka将消息以 topic 为单位进行归纳,将向 kafka topic 发布消息的程序称为 producer,将预定 topic 并消费消息的程序称为 consumer。

- kafka 以集群的方式运行,可以由一个或多个服务组成,每个服务叫做一个 broker

- producer 通过网络将消息发送到 kafka 集群,集群向消费者提供消息

22、数据传输的事务定义有哪三种

a、最多一次:消息不会被重复发送,最多被传输一次,但也有可能一次不传输,可能会造成数据丢失b、最少一次:消息不会被漏发送,最少被传输一次,但也有可能被重复传输,可能会造成数据的重复消费c、精确的一次(Exactly once):不会漏传输也不会重复传输,每个消息都传输一次而且仅仅被传输一次,这是大家所期望的

23、kafka 判断一个节点是否还活着有哪些条件

a、节点必须可以维护 zookeeper 的连接,zookeeper 通过心跳机制检查每个节点的连接b、如果节点是个 follower,它必须能及时同步 leader 的写从操作,延时不能太久

24、kafka 与传统消息系统之间有哪些区别

- a、kafka 持久化日志:这些日志可以被重复读取和无限期保留

- b、kafka 是一个分布式系统:它以集群的方式运行,可以灵活伸缩,在内部通过复制数据提升容错能力和高可用性

- c、kafka 支持实时的流式处理

25、kafka 创建 topic 时将分区放置到不同的 Broker 的策略是什么

- 前提:副本因子不能大于 Broker 的个数

- 第一个分区(编号为0)的第一个副本放置位置是随机从 BrokerList 选择的

- 其他分区的第一个副本放置位置相对于第一个分区(编号为0)依次往后移

- 例如:有5个 Broker,5个分区,假设第一个分区放在第四个 Broker 上;那么第二个分区 将会放在第五个 Broker 上;第三个分区将会放在第一个 Broker 上;第四个分区将会放在第二个 Broker 上;第五个分区将会放在第三个 Broker 上。

26、kafka 新建的分区会在那个目录创建

若 log.dirs 参数只配置了一个目录,那么分配到各个 Broker 上的分区将在这个目录下创建文件夹用于存放数据若 log.dirs 参数配置了多个目录,那么 kafka 会在含有分区目录总数最少的文件夹中创建新的分区目录,分区目录名为:Topic 名 + 分区 ID。注意:不是磁盘使用量最少的目录

27、Partition (分区)的数据如何保存到硬盘

- Topic 中的多个 Partition 以文件夹的形式保存到 Broker,每个分区序号从0递增,且消息有序,Partition文件下有多个 segment(xxx.index,xxx.log)segment 文件里的

大小和配置文件大小一致,可以根据要求修改,默认为 1G,如果大小大于 1G时,会滚动一个新的 segment,并且以上一个 segment 最后一条消息的 offset(偏移量)来 命名

28、kafka 的 ack 机制

request.required.acks 有三个值:0 1 -10:生产者不会等待 broker 的 ack,这个延迟最低但是存储的保证最弱,当 server 挂掉的时候就会丢失数据1:服务端会等待 ack 值,leader 副本确认接收到消息后发送 ack,但是如果 leader 挂掉后,它不确保是否复制完成的新 leader 也会导致数据丢失-1:同样在 1 的基础上,服务端会等所有的 follower 的副本收到数据后才会收到 leader 发出的 ack,这样数据不会丢失

29、kafka 的消费者如何消费数据

- 消费者每次消费数据的时候,消费者都会记录消费的物理偏移量(offset)的位置,等到下次消费时,会接着上次位置继续消费。同时也可以按照指定的 offset 进行重新消费

30、如何使 kafka 集群内的数据是有序的

- 只创建一个分区(但是实际这样会存在性能问题,具体业务具体分析后确认)

31、Zookeeper 汇总保留了哪些数据

a、消费者提交的 offset(偏移量)b、分区和消费者的所有关系(关联)c、broker 的 id说明:leader 检测、分布式同步、配置管理、识别新节点何时离开或链接、集群、节点实时状态

32、Kafka Consumer(消费者)什么情况会触发再平衡 Reblance

a、一旦消费者加入或退出消费组,导致消费组成员列表发生变化,消费组中的所有消费者都要执行再平衡b、订阅 Topic(主题)分区发生变化,所有消费者也都要再平衡

33、描述 Kafka Consumer 再平衡步骤

a、关闭数据拉取线程,清空队列和消息六,提交偏移量b、释放分区所有权,删除 zk 中分区和消费者的所有关系c、将所有分区重新分配给每个消费者,每个消费者都会分到不同分区d、将分区对应的消费者所有关系写入 zk,记录分区的所有权信息e、重启消费者拉取线程管理器,管理每个分区的拉取线程

34、手动提交 offset 有什么好处

- 使更新 offset 更及时,避免因 offset 更新不及时导致重复消费数据的问题

35、为什么 kafka 中的数据需要定期删除或合并

- kafka 只用于做数据的临时存储、临时缓冲,不是永久存储(永久性存储使用 HDFS)

最后

以上就是饱满凉面最近收集整理的关于Kafka知识点总结的全部内容,更多相关Kafka知识点总结内容请搜索靠谱客的其他文章。

发表评论 取消回复