胶囊网络(CapsulesNet)理解:

一.回顾CNN:

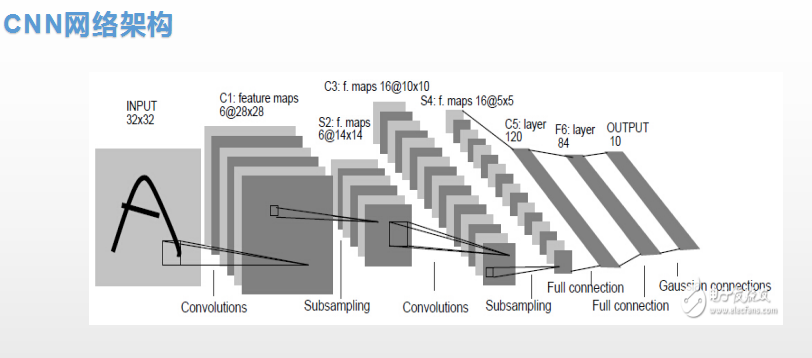

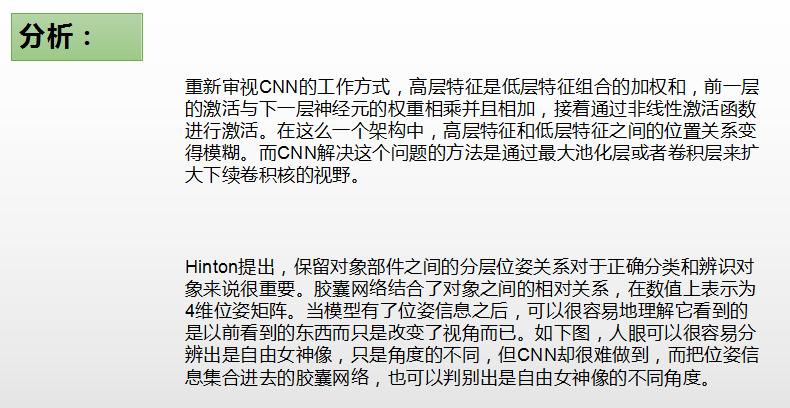

CNN网络层级结构

CNN网络一共有5个层级结构:

- 输入层

- 卷积层

- 激活层

- 池化层

- 全连接FC层

-

1.输入层

与传统神经网络/机器学习一样,模型需要输入的进行预处理操作,常见的3中预处理方式有:

- 去均值

- 归一化

- PCA/SVD降维等

-

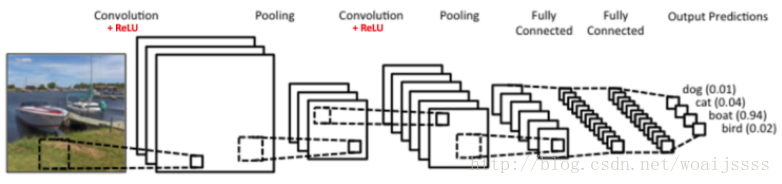

2.卷积层

- 局部感知:人的大脑识别图片的过程中,并不是一下子整张图同时识别,而是对于图片中的每一个特征首先局部感知,然后更高层次对局部进行综合操作,从而得到全局信息。

-

卷积层使用“卷积核”进行局部感知。举个例子来讲,一个32×32×3的RGB图经过一层5×5×3的卷积后变成了一个28×28×1的特征图,那么输入层共有32×32×3=3072个神经元,第一层隐层会有28×28=784个神经元,这784个神经元对原输入层的神经元只是局部连接,如下图所示:

-

3.激励层

所谓激励,实际上是对卷积层的输出结果做一次非线性映射。

如果不用激励函数(其实就相当于激励函数是f(x)=x),这种情况下,每一层的输出都是上一层输入的线性函数。容易得出,无论有多少神经网络层,输出都是输入的线性组合,与没有隐层的效果是一样的,这就是最原始的感知机了。

常用的激励函数有:Sigmoid函数

Tanh函数

ReLU

Leaky ReLU

ELU

Maxout

激励层建议:首先ReLU,因为迭代速度快,但是有可能效果不加。如果ReLU失效的情况下,考虑使用Leaky ReLU或者Maxout,此时一般情况都可以解决。Tanh函数在文本和音频处理有比较好的效果。4.池化层

池化(Pooling):也称为欠采样或下采样。主要用于特征降维,压缩数据和参数的数量,减小过拟合,同时提高模型的容错性。主要有:

- Max Pooling:最大池化

- Average Pooling:平均池化

-

5.输出层

经过前面若干次卷积+激励+池化后,终于来到了输出层,模型会将学到的一个高质量的特征图片全连接层。其实在全连接层之前,如果神经元数目过大,学习能力强,有可能出现过拟合。因此,可以引入dropout操作,来随机删除神经网络中的部分神经元,来解决此问题。还可以进行局部归一化(LRN)、数据增强等操作,来增加鲁棒性,这里不做介绍。

当来到了全连接层之后,可以理解为一个简单的多分类神经网络(如:BP神经网络),通过softmax函数得到最终的输出。整个模型训练完毕。

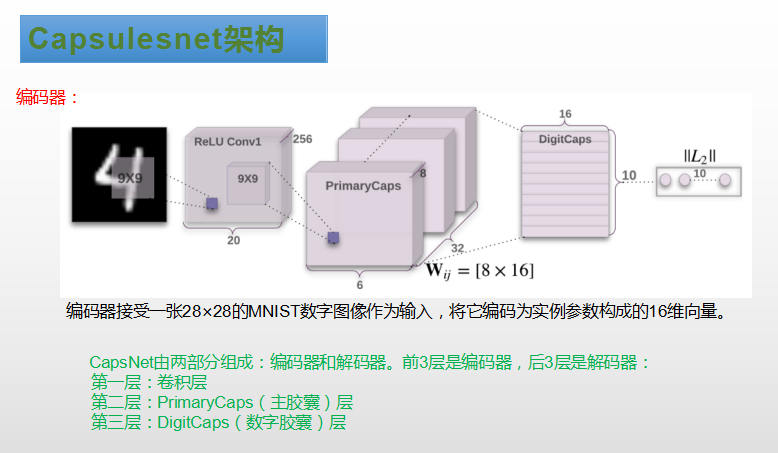

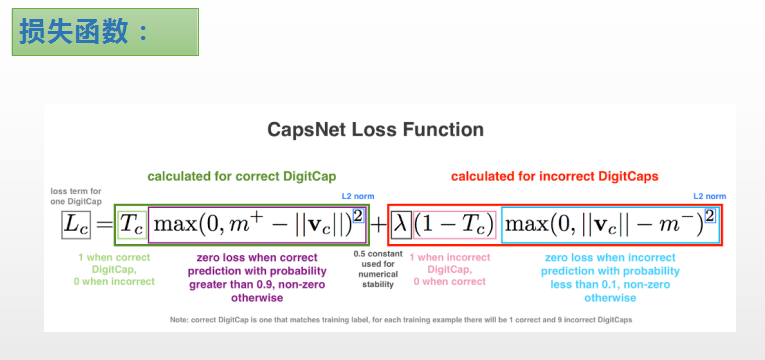

二.胶囊网络:

最后

以上就是激动大侠最近收集整理的关于胶囊网络(CapsulesNet)理解 胶囊网络(CapsulesNet)理解:的全部内容,更多相关胶囊网络(CapsulesNet)理解 胶囊网络(CapsulesNet)理解内容请搜索靠谱客的其他文章。

发表评论 取消回复