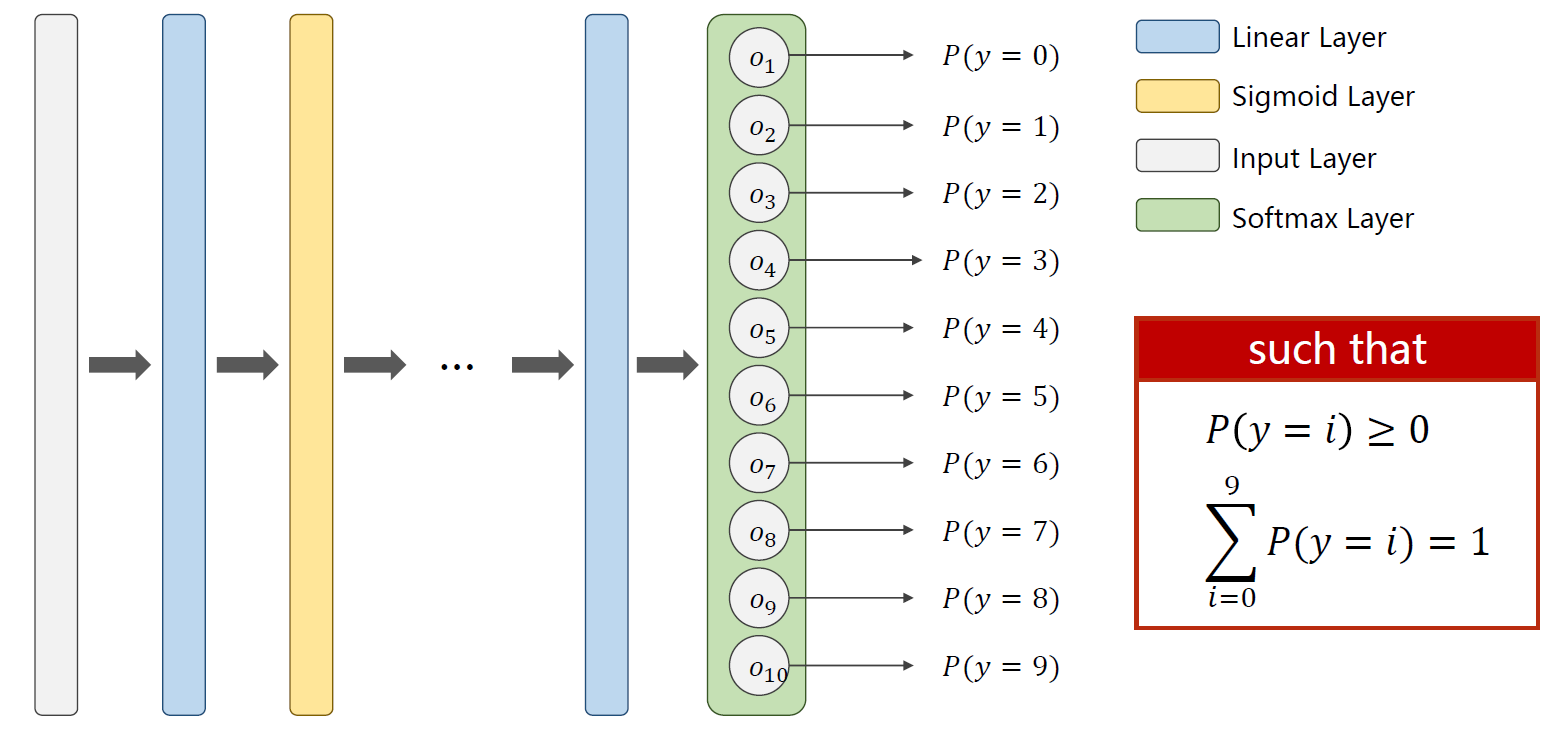

1、softmax函数的引出

处理多分类问题时,一般的激活函数会产生矛盾的效果,需要满足两个条件,所有的P均大于0,所有的P相加等于1。

而softmax函数可以满足这一点

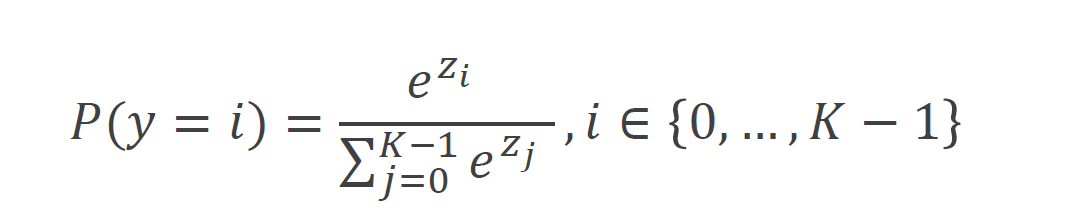

函数公式:

真的是非常Amazing啊

下面这个实例展示它是如何计算的

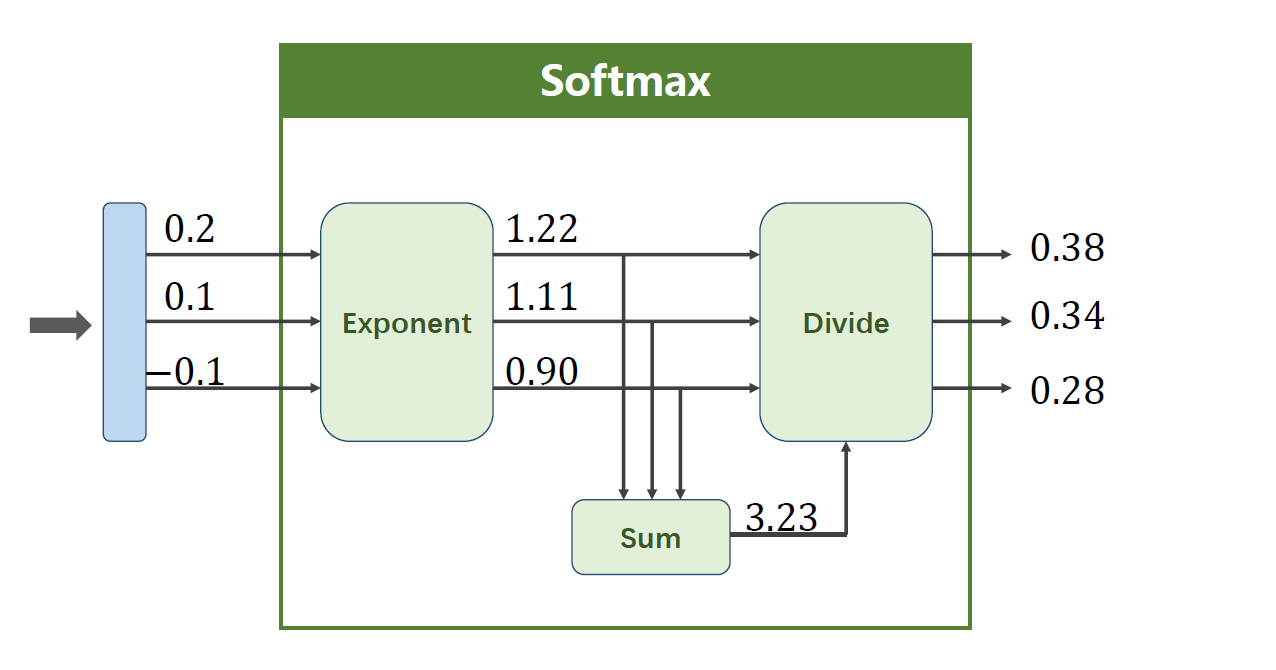

2、损失函数的选取

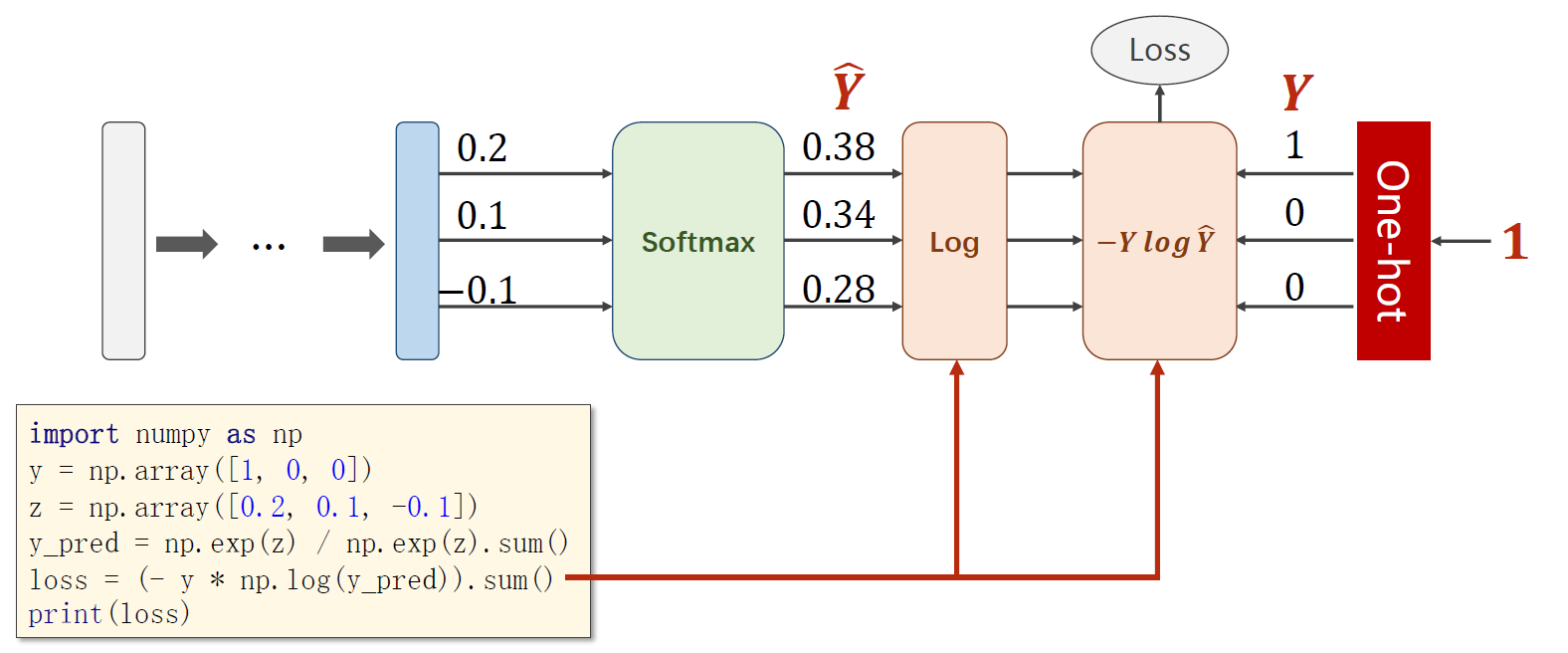

对于二分类问题,之前我们选取了交叉熵作为损失函数,多分类问题有了些许变化,损失函数为

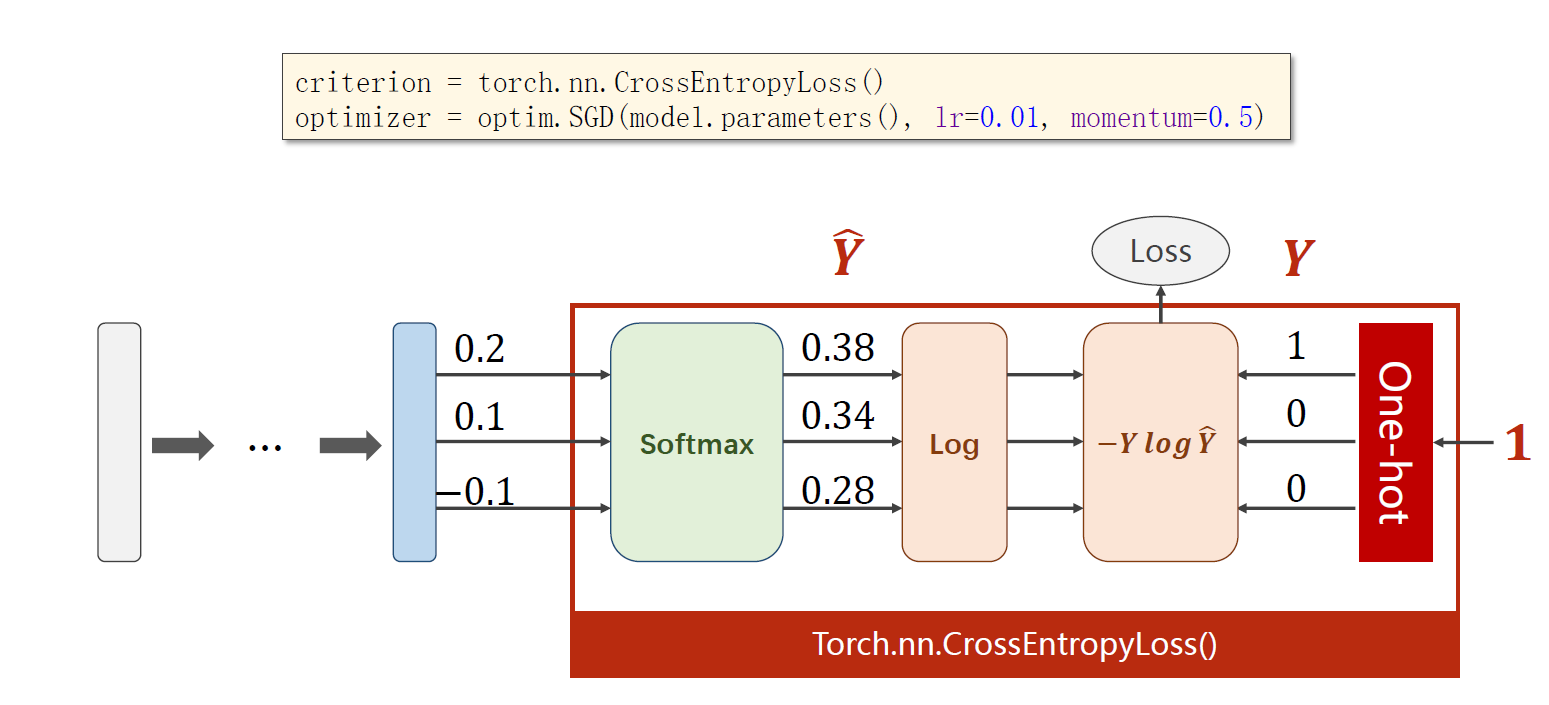

用程序语言来表达整个过程:

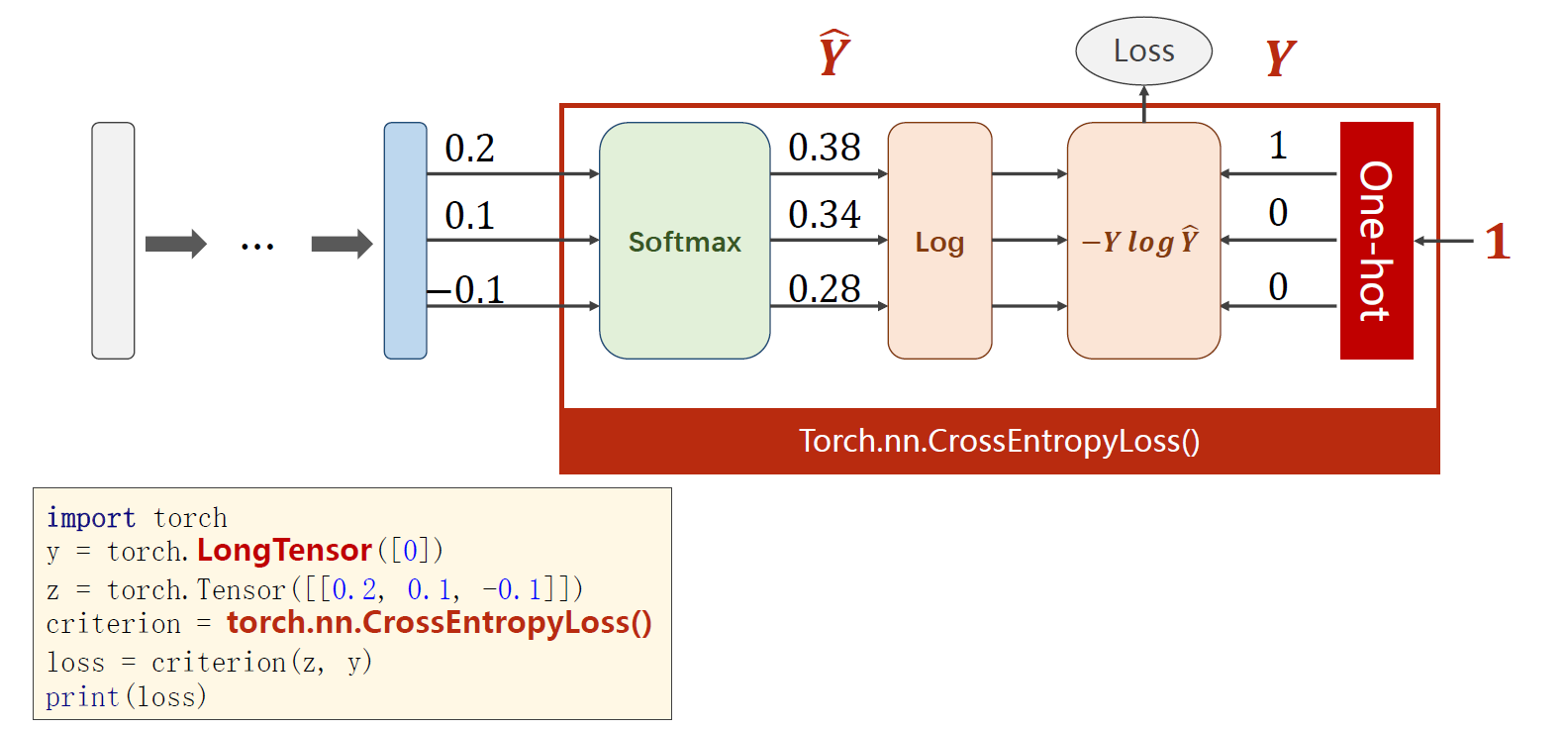

3、用pytorch来书写过程

注:CrossEntropyLoss()包含了Softmax,因此最后面的一层不用额外激活

4、实例过程

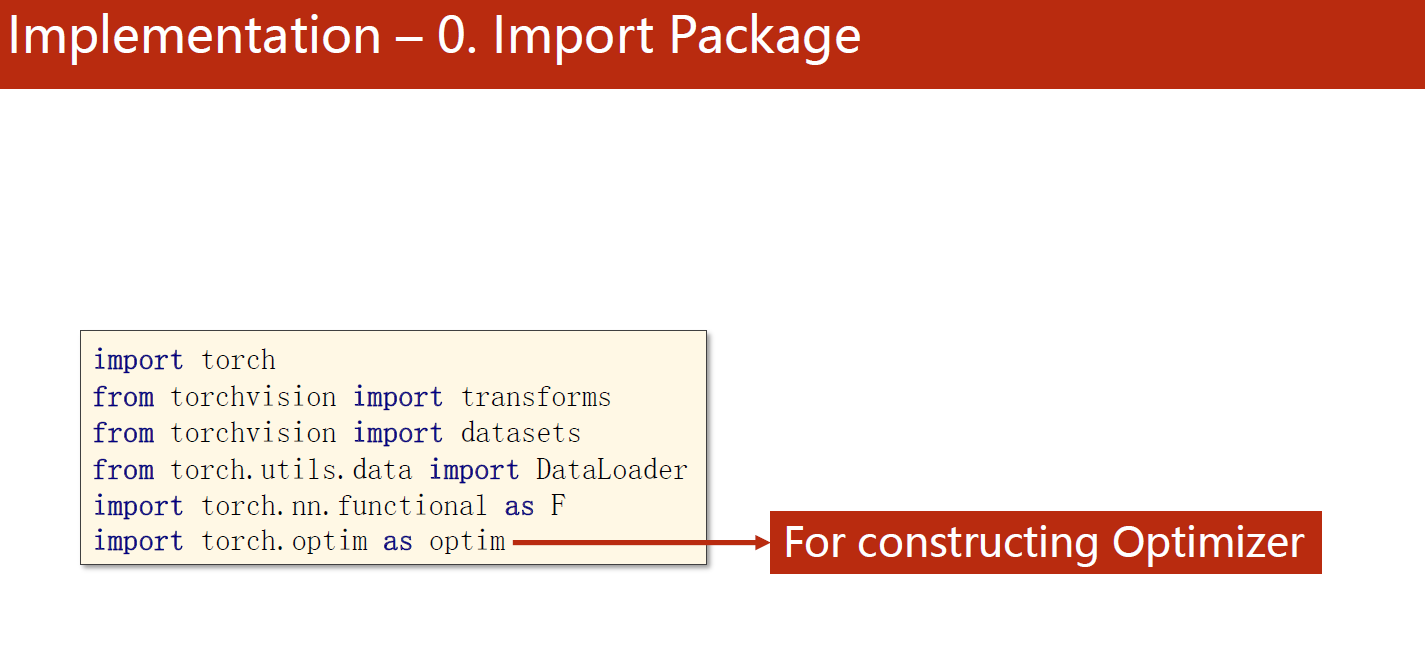

0、调包

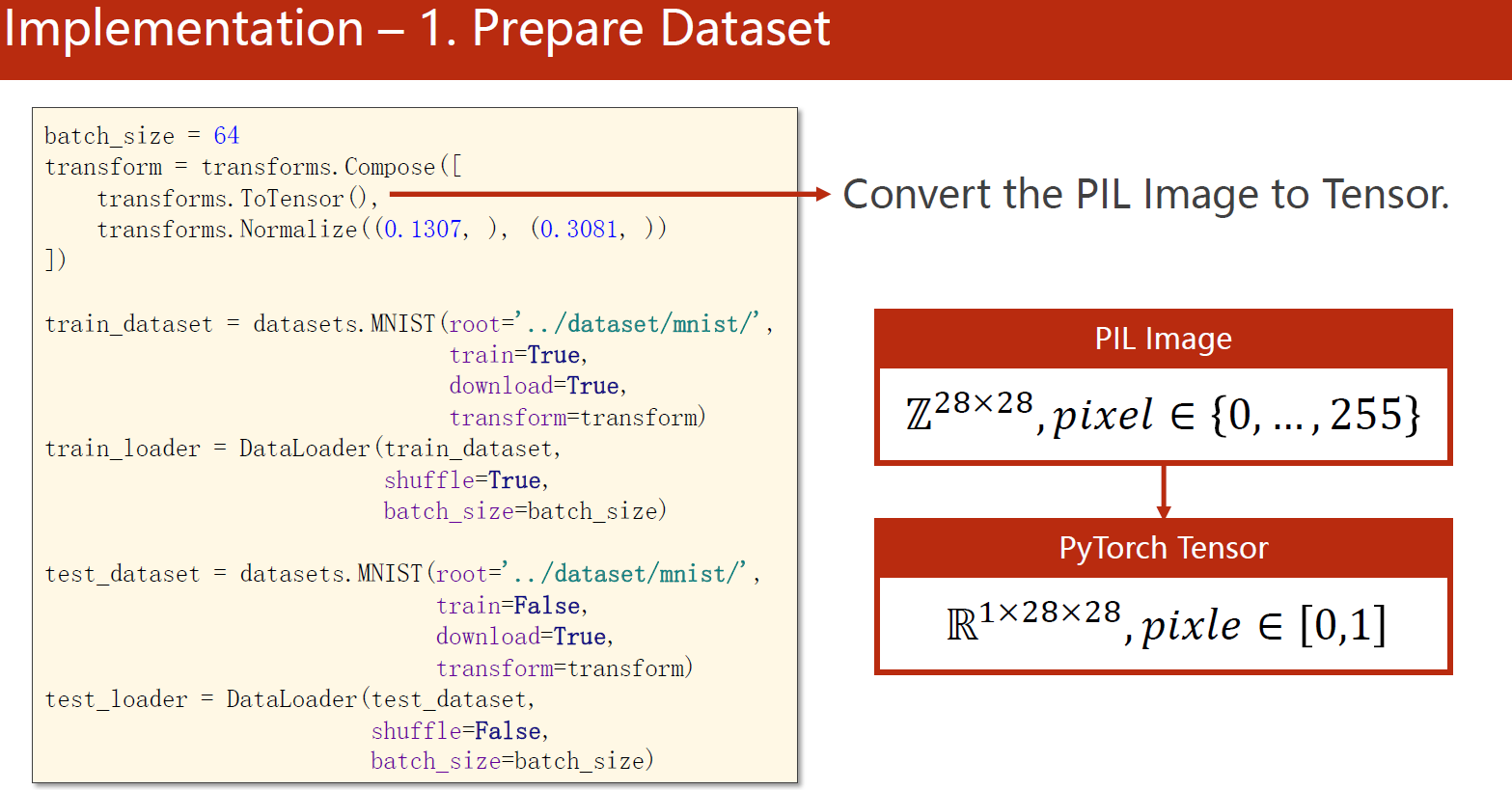

1、准备数据集

ToTensor()是将一幅图片的所有像素点变成一个向量

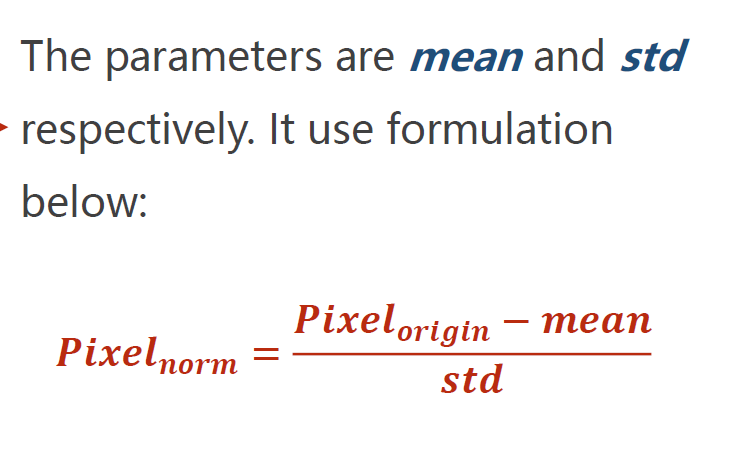

Normalize是概率论中化成标准正态分布的公式:(x-u)/sigma

0.1307为u,0.3081为sigma 由MNIST数据集确定

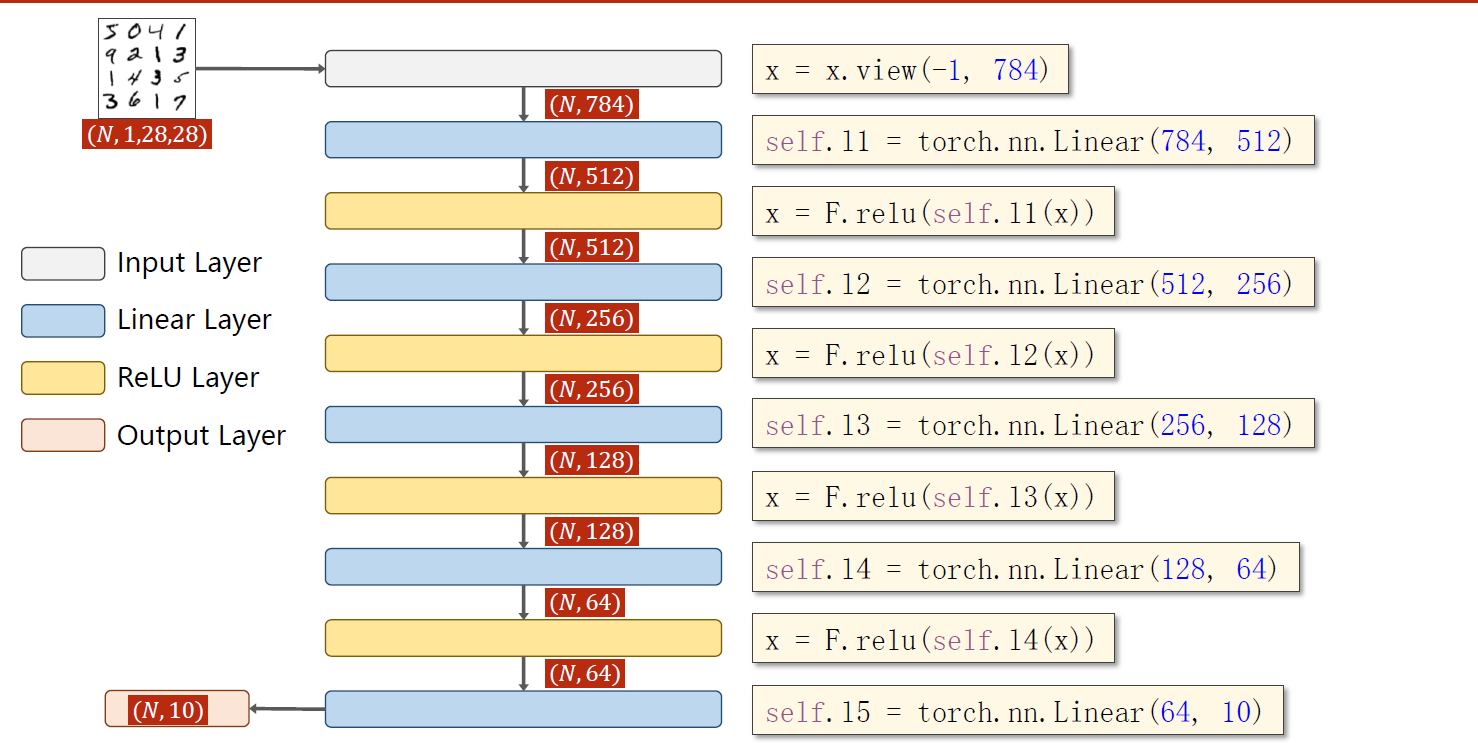

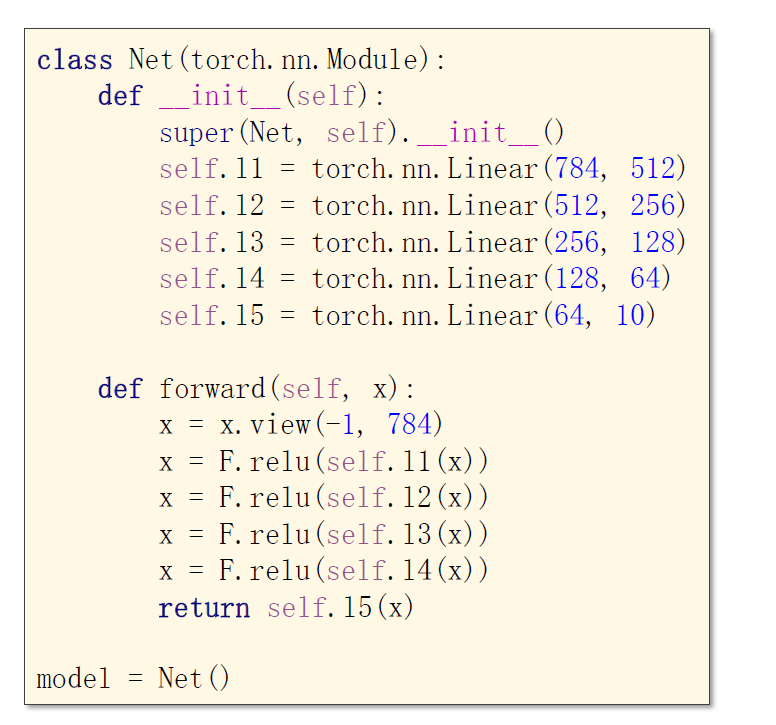

2、设计模型

view(-1,784) -1代表程序会自动计算这个数值

3、构建损失函数和优化器

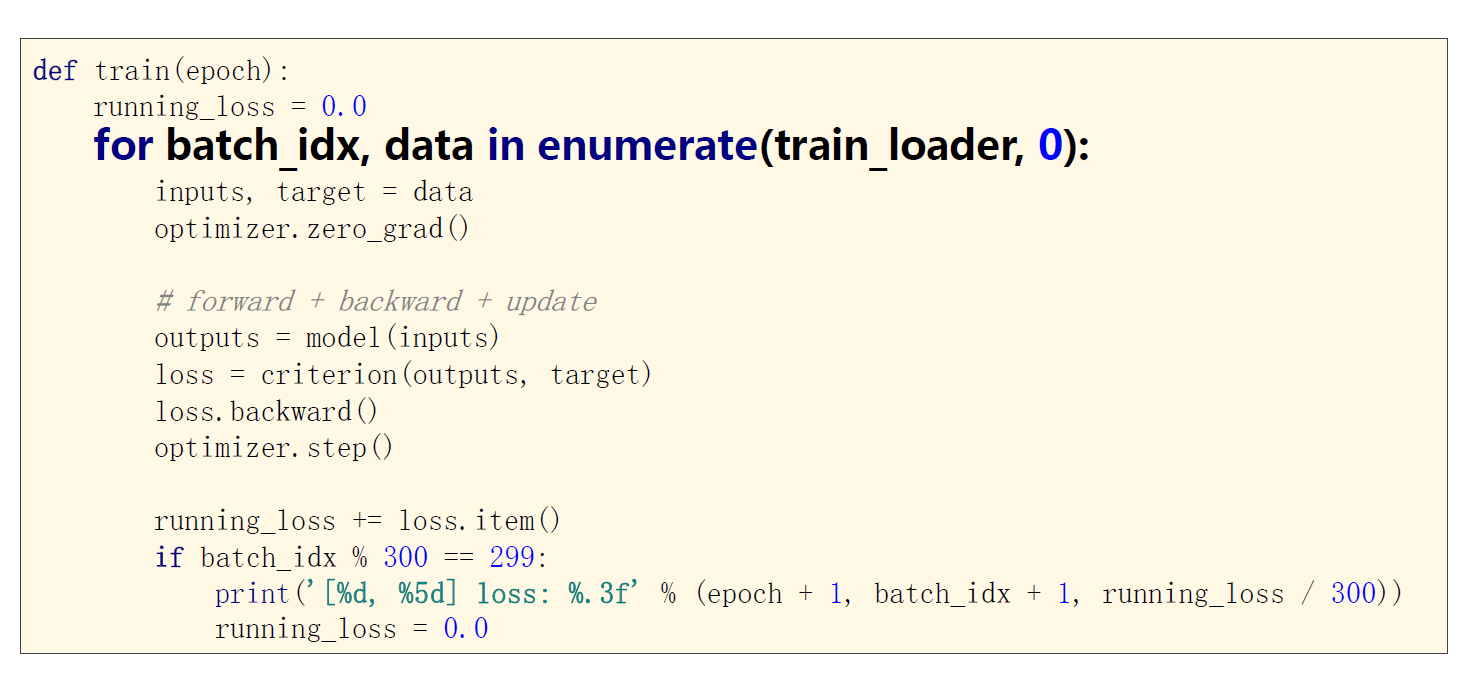

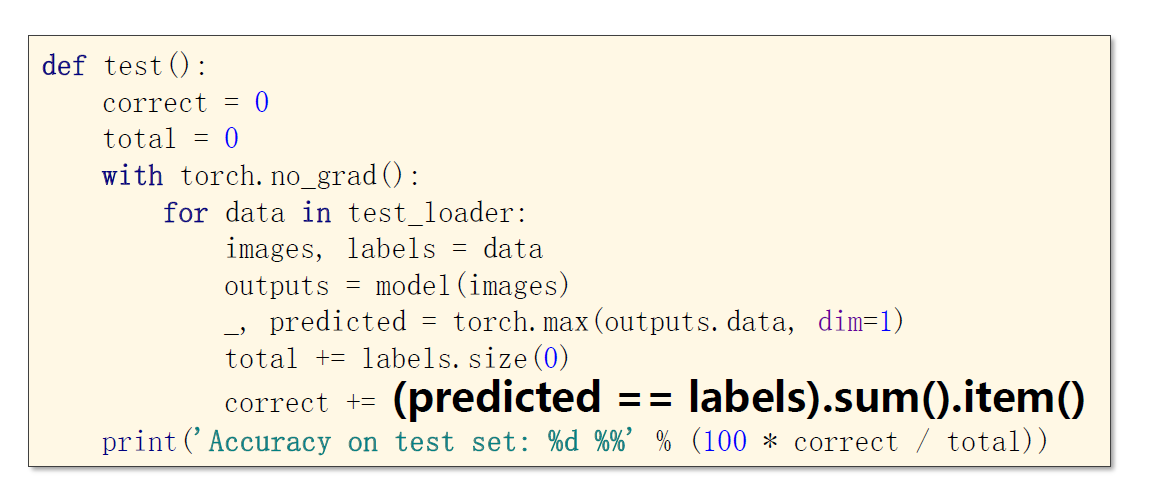

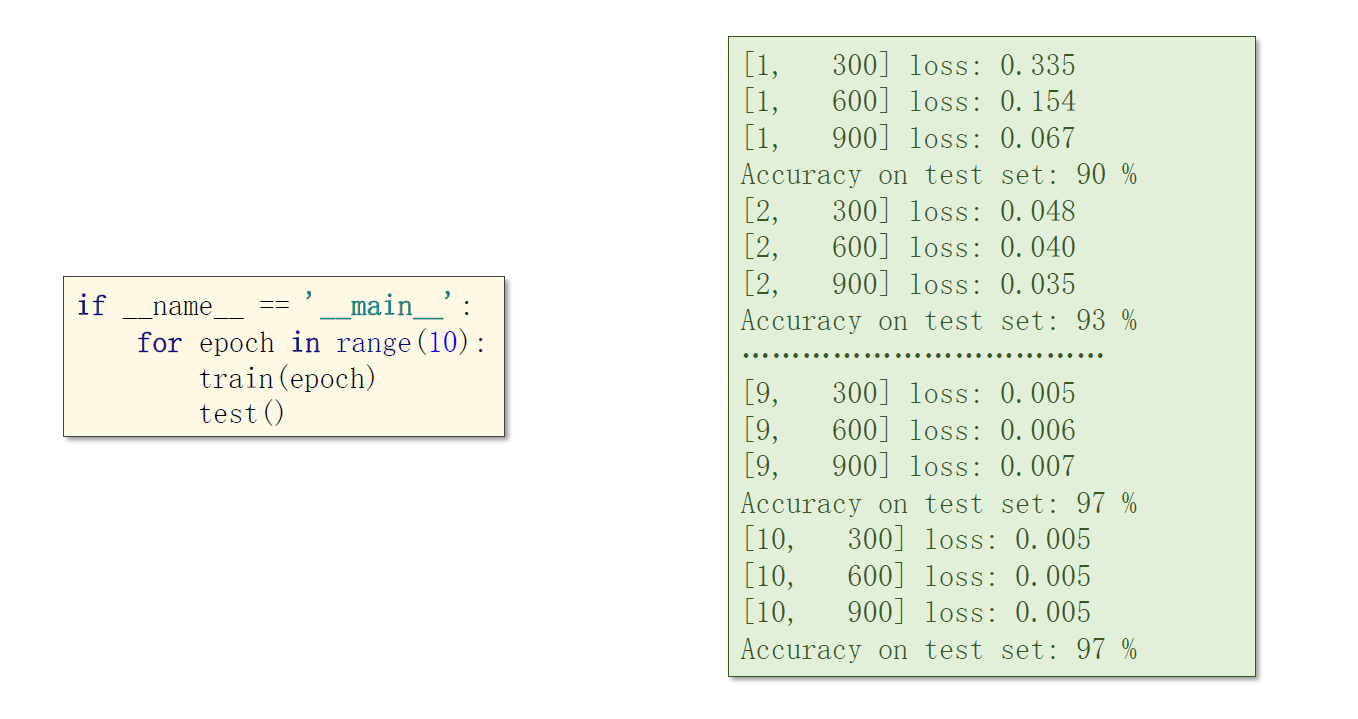

4、训练和测试

with torch.no_grad()测试时,设置无梯度运行

dim=1 横向扫描像素点

最后

以上就是外向铅笔最近收集整理的关于pytorch学习笔记(八):全连接层处理图像分类问题的全部内容,更多相关pytorch学习笔记(八)内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复