Spark集群启动时worker节点启不起来

spark集群中使用命令:

- 注意:到spark安装文件夹下的sbin文件夹下启动

- 命令:./start-all.sh

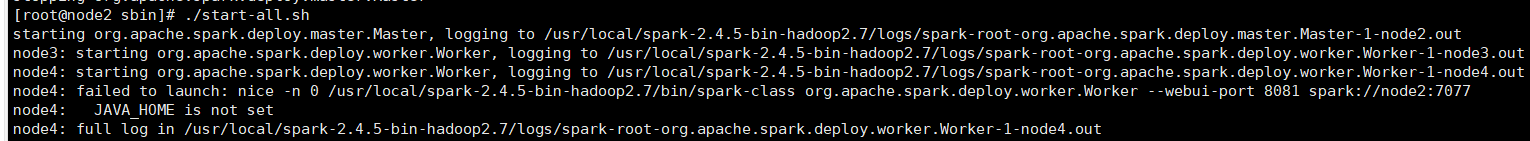

启动集群时报错:

分析日志:

- JAVA_HOME is not set (没有设置java的环境变量)

- 首先先检查一下自己的java环境变量配置了没(一般到spark集群这个步骤都配置了)

- 检查当前用户下的java环境是正常的,经分析寻找资料在这个博客中找到了 原理

https://stackoverflow.com/questions/33955635/why-does-start-all-sh-from-root-cause-failed-to-launch-org-apache-spark-deploy

解决方法:

在当前用户的.bashrc文件中加入java的环境变量

vim ~/.bashrc

加入java环境变量

export JAVA_HOME=你的java安装路径

然后重新启动spark集群

此时你再看启动的服务 发现worker就启动了,问题也就解决了

最后

以上就是忐忑世界最近收集整理的关于Spark集群启动时worker节点启不起来的全部内容,更多相关Spark集群启动时worker节点启不起来内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

![[CDH 基础]-- Cloudera Manager Metrics(CDH-6.3.0)Cloudera Manager Metrics](https://www.shuijiaxian.com/files_image/reation/bcimg27.png)

发表评论 取消回复