Date: 2019-07 -28

1.印度电影《宝莱坞机器人之恋》中的机器人七弟采用的智能算法最有可能是以下哪一种(神经网络)

解释: 在第876句台词的时候,开发七弟的博士说“你们了解七弟的神经模式吗”。七弟在经过简单学习之后就有了完全可以通过图灵测试的能力,算是比较典型的学习型人工智能,神经网络作为一种运算模型,而其网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。遗传算法作为一种最优搜索算法,对于一个最优化问题,一定数量的候选解(称为个体)的抽象表示(称为染色体)的种群向更好的解进化。(但其实电影并与题目并不一定有很大的关联,根据个人的认知,也可以大概猜出答案)

2. 下面有关分类算法的准确率,召回率,F1 值的描述,错误的是?(C)

A. 准确率是检索出相关文档数与检索出的文档总数的比率,衡量的是检索系统的查准率

B.召回率是指检索出的相关文档数和文档库中所有的相关文档数的比率,衡量的是检索系统的查全率

C.正确率、召回率和 F 值取值都在0和1之间,数值越接近0,查准率或查全率就越高(应该是越接近1,PR更高)

D. 为了解决准确率和召回率冲突问题,引入了F1分数(分析PR的含义,可知PR在一定程度上是相互矛盾的。)

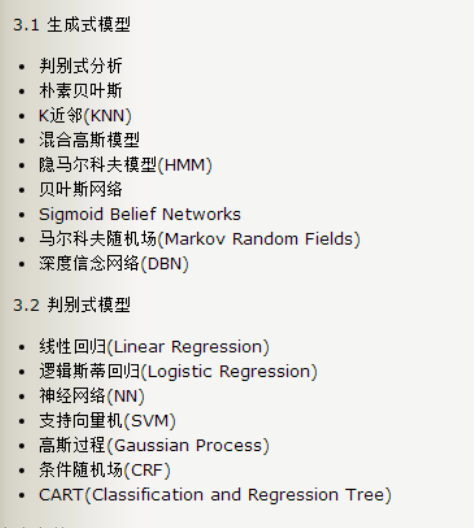

3. 以下几种模型方法属于判别式模型的有 (2,3)

1)混合高斯模型

2)条件随机场模型

3)区分度训练

4)隐马尔科夫模型

解释:

公式上看

生成模型: 学习时先得到 P(x,y),继而得到 P(y|x)。预测时应用最大后验概率法(MAP)得到预测类别 y。

判别模型: 直接学习得到P(y|x),利用MAP得到 y。或者直接学得一个映射函数 y=f(x)。

直观上看

生成模型: 关注数据是如何生成的

判别模型: 关注类别之间的差别

假如你的任务是识别一个语音属于哪种语言。例如对面一个人走过来,和你说了一句话,你需要识别出她说的到底是汉语、英语还是法语等。那么你可以有两种方法达到这个目的:

- 学习每一种语言,你花了大量精力把汉语、英语和法语等都学会了,我指的学会是你知道什么样的语音对应什么样的语言。然后再有人过来对你说,你就可以知道他说的是什么语音.

- 不去学习每一种语言,你只学习这些语言之间的差别,然后再判断(分类)。意思是指我学会了汉语和英语等语言的发音是有差别的,我学会这种差别就好了。

那么第一种方法就是生成方法,第二种方法是判别方法。

4. 在其他条件不变的前提下,以下哪种做法容易引起机器学习中的过拟合问题(D)

A. 增加训练集量

B.减少网络隐藏层节点数量

C.删除稀疏特征s

D.SVM算法中使用高斯核/RBF核代替线性核

解释:

造成过拟合的原因主要有:

1、训练数据不足,有限的训练数据

2、训练模型过度导致模型非常复杂,泛化能力差

选项A增加训练集可以解决训练数据不足的问题,防止过拟合

选项B对应使得模型复杂度降低,防止过拟合

选项C类似主成分分析,降低数据的特征维度,使得模型复杂度降低,防止过拟合

选项D使得模型的复杂化,会充分训练数据导致过拟合

5. 已知一组数据的协方差矩阵P,下面关于主分量说法错误的是(C)

A. 主分量分析的最佳准则是对一组数据进行按一组正交基分解, 在只取相同数量分量的条件下,以均方误差计算截尾误差最小

B. 在经主分量分解后,协方差矩阵成为对角矩阵

C.主分量分析就是K-L变换

D.主分量是通过求协方差矩阵的特征值得到

解释:这里的主分量分析其实就是主成分分析(PCA)。C选项错在原因:K-L变换与PCA变换是不同的概念,PCA的变换矩阵是协方差矩阵,K-L变换的变换矩阵可以有很多种(二阶矩阵、协方差矩阵、总类内离散度矩阵等等)。当K-L变换矩阵为协方差矩阵时,等同于PCA。 即K-L变换是比PCA更上层的概念,包含更多情况,不能一概而论的讲主成分分析就是K-L变换。

PCA:主成分分析(主分量分析)

主成分分析(PCA)是一种数据降维技巧,它能将大量相关变量转化为一组很少的不相关变量,这些无关变量称为主成分。例如,使用PCA可将30个相关(很可能冗余)的环境变量转化为5个无关的成分变量,并且尽可能地保留原始数据集的信息。

PCA分析的一般步骤如下:

- 数据预处理。PCA根据变量间的相关性来推导结果。用户可以输入原始数据矩阵或者相关系数矩阵到

principal()和fa()函数中进行计算,在计算前请确保数据中没有缺失值。 - 判断要选择的主成分数目(这里不涉及因子分析)。

- 选择主成分(这里不涉及旋转)。

- 解释结果。

- 计算主成分得分。

PCA的目标是用一组较少的不相关变量代替大量相关变量,同时尽可能保留初始变量的信息,这些推导所得的变量称为主成分,它们是观测变量的线性组合。如第一主成分为:

它是k个观测变量的加权组合,对初始变量集的方差解释性最大。第二主成分也是初始变量的线性组合,对方差的解释性排第二,同时与第一主成分正交(不相关)。后面每一个主成分都最大化它对方差的解释程度,同时与之前所有的主成分都正交.我们都希望能用较少的主成分来解释全部变量。

6. 以下机器学习中,在数据预处理时,不需要考虑归一化处理的是:C

A.logistic回归

B.SVM

C.树型模型(树模型,对数据量纲不敏感,因此不需要数据归一化 )

D.神经网络

7. 深度学习是当前很热门的机器学习算法。在深度学习中,涉及到大量矩阵相乘,现在需要计算三个稠密矩阵A,B,C的乘积ABC,假设三个矩阵的尺寸分别为m*n,n*p,p*q,且m<n<p<q,以下计算顺序效率最高的是:(B)

A.A(BC)

B.(AB)C

解释:

a*b,b*c两矩阵相乘效率为a*c*b

ABC=(AB)C=A(BC).

(AB)C = m*n*p + m*p*q,

A(BC)=n*p*q + m*n*q.

m*n*p<m*n*q,m*p*q< n*p*q, 所以 (AB)C 最小

8. 以下哪个模型是生成式模型:贝叶斯模型

而 逻辑回归、SVM、条件随机场是判别式模型。

9.

考虑如下数据集,其中Customer ID(顾客id),Transaction ID(事务id),Items Bought(购买项)。如果将每个事务id看成一个购物篮,计算项集{e}, {b, d}, {b, d, e}的支持度:

答案:s({e}) =0.8s({b, d})= 0.2s({b, d, e})= 0.2

10. 以下哪些方法不可以直接来对文本分类?K-Means

决策树、支持向量机、KNN均可用于进行文本分类;

尤其是对于KNN进行文本分类时,已有的数据点是有label数据,对于新的数据需要计算其最近邻的K个样本的类别最大支持度(vote原则)得到相应的类别。

Kmeans是聚类方法,典型的无监督学习方法。分类是监督学习方法,BCD都是常见的分类方法。

KNN分类算法(先验数据中就有类别之分,未知的数据会被归类为之前类别中的某一类!)KNN算法解释及源码实现

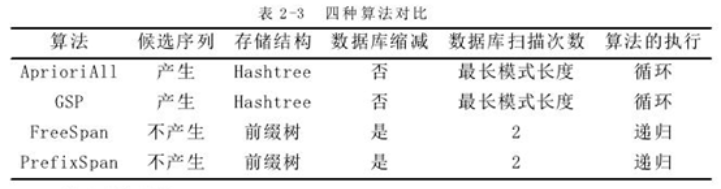

11. 下面有关序列模式挖掘算法的描述,错误的是?C

A.AprioriAll算法和GSP算法都属于Apriori类算法,都要产生大量的候选序列

B.FreeSpan算法和PrefixSpan算法不生成大量的候选序列以及不需要反复扫描原数据库

C.在时空的执行效率上,FreeSpan比PrefixSpan更优 (PrefixSpan比FreeSpan更优)

D.和AprioriAll相比,GSP的执行效率比较高

参考解释:

1. Apriori算法 :关联分析原始算法,用于从候选项集中发现频繁项集。两个步骤:进行自连接、进行剪枝。缺点:无时序先后性。

AprioriAll算法:AprioriAll算法与Apriori算法的执行过程是一样的,不同点在于候选集的产生,需要区分最后两个元素的前后。

AprioriSome算法:可以看做是AprioriAll算法的改进

AprioriAll算法和AprioriSome算法的比较:

(1)AprioriAll用 去计算出所有的候选Ck,而AprioriSome会直接用 去计算所有的候选 ,因为 包含 ,所以AprioriSome会产生比较多的候选。

(2)虽然AprioriSome跳跃式计算候选,但因为它所产生的候选比较多,可能在回溯阶段前就占满内存。

(3)如果内存占满了,AprioriSome就会被迫去计算最后一组的候选。

(4)对于较低的支持度,有较长的大序列,AprioriSome算法要好些。

2. GPS算法:类Apriori算法。用于从候选项集中发现具有时序先后性的频繁项集。两个步骤:进行自连接、进行剪枝。缺点:每次计算支持度,都需要扫描全部数据集;对序列模式很长的情况,由于其对应的短的序列模式规模太大,算法很难处理。

3. SPADE算法:改进的GPS算法,规避多次对数据集D进行全表扫描的问题。与GSP算法大体相同,多了一个ID_LIST记录,使得每一次的ID_LIST根据上一次的ID_LIST得到(从而得到支持度)。而ID_LIST的规模是随着剪枝的不断进行而缩小的。所以也就解决了GSP算法多次扫描数据集D问题。

4. FreeSpan算法:即频繁模式投影的序列模式挖掘。核心思想是分治算法。基本思想为:利用频繁项递归地将序列数据库投影到更小的投影数据库集中,在每个投影数据库中生成子序列片断。这一过程对数据和待检验的频繁模式集进行了分割,并且将每一次检验限制在与其相符合的更小的投影数据库中。

优点:减少产生候选序列所需的开销。缺点:可能会产生许多投影数据库,开销很大,会产生很多的

5. PrefixSpan 算法:从FreeSpan中推导演化而来的。收缩速度比FreeSpan还要更快些。

自己的理解:序列模式挖掘

12.下列不是SVM核函数的是:logistic核函数

解释: SVM核函数包括线性核函数、多项式核函数、径向基核函数、高斯核函数、幂指数核函数、拉普拉斯核函数、ANOVA核函数、二次有理核函数、多元二次核函数、逆多元二次核函数以及Sigmoid核函数

13. 以下关于PMF(概率质量函数),PDF(概率密度函数),CDF(累积分布函数)描述错误的是(A)

A. PDF描述的是连续型随机变量在特定取值区间的概率(PDF非概率)

B.CDF是PDF在特定区间上的积分

C.PMF描述的是离散型随机变量在特定取值点的概率

D.有一个分布的CDF函数H(x),则H(a)等于P(X<=a)

解释:

概率质量函数 (probability mass function,PMF)是离散随机变量在各特定取值上的概率。

概率密度函数(p robability density function,PDF )是对 连续随机变量 定义的,本身不是概率,只有对连续随机变量的取值进行积分后才是概率。

累积分布函数(cumulative distribution function,CDF) 能完整描述一个实数随机变量X的概率分布,是概率密度函数的积分。对於所有实数x ,与pdf相对。

14. 一般,k-NN最近邻方法在( 样本少但典型性好)的情况下效果较好。

解释:

样本数少:kNN每次预测要计算距离,所以是带着整个样本集跑的(也有些剪辑近邻之类的会剪掉一些),所以样本数越少越好。

典型性:不仅是kNN,每个分类算法都希望样本典型性好,这样才好做分类。

15. 输入图片大小为200×200,依次经过一层卷积(kernel size 5×5,padding 1,stride 2),pooling(kernel size 3×3,padding 0,stride 1),又一层卷积(kernel size 3×3,padding 1,stride 1)之后,输出特征图大小为:97*97

解释:

计算尺寸不被整除只在GoogLeNet中遇到过。卷积向下取整,池化向上取整。

本题 (200-5+2*1)/2+1 为99.5,取99

(99-3)/1+1 为97

(97-3+2*1)/1+1 为97

研究过网络的话看到stride为1的时候,当kernel为 3 padding为1或者kernel为5 padding为2 一看就是卷积前后尺寸不变。

计算GoogLeNet全过程的尺寸也一样。

16. 在spss的基础分析模块中,作用是“以行列表的形式揭示数据之间的关系”的是( 交叉表)

17. 类域界面方程法中,不能求线性不可分情况下分类问题近似或精确解的方法是?B

A. 伪逆法

B.感知器算法 (感知器 连异或都不能解决)

C.基于二次准则的H-K算法

D.势函数法

解释:

伪逆法:径向基(RBF)神经网络的训练算法,径向基解决的就是线性不可分的情况。

感知器算法:线性分类模型。

H-K算法:在最小均方误差准则下求得权矢量,二次准则解决非线性问题。

势函数法:势函数非线性。

18. 随机抽样一致算法(random sample consensus,RANSAC),采用迭代的方式从一组包含离群的被观测数据中估算出数学模型的参数。对于RANSAC的基本假设描述不正确的是: B

A. 给定一组(通常很小)的内群,存在一个程序,这个程序可以估算最佳解释或最适用于这一数据模型的参数

B.离群点离inliers集中区域的差距再可控范围内(在不可控制的范围内)

C."内群”数据可以通过几组模型的参数来叙述其分别,而“离群”数据则是不适合模型化的数据

D.数据会受噪声影响,噪声指的是离群,例如从极端的噪声或错误解释有关数据的测量或不正确的假设

19. 在统计模式识分类问题中,当先验概率未知时,可以使用(BC)?

A. 最小损失准则

B. N-P判决

C.最小最大损失准则

D.最小误判概率准则

解释:

选项 A

最小损失准则中需要用到先验概率

选项 B

在贝叶斯决策中,对于先验概率p(y),分为已知和未知两种情况。

1. p(y)已知,直接使用贝叶斯公式求后验概率即可;

2. p(y)未知,可以使用聂曼-皮尔逊决策(N-P判决)来计算决策面。

聂曼-皮尔逊决策(N-P判决)可以归结为找阈值a,即:

- 如果p(x|w1)/p(x|w2)>a,则 x属于w1;

- 如果p(x|w1)/p(x|w2)<a,则 x属于w 2;

选项C

最大最小损失规则主要就是使用解决最小损失规则时先验概率未知或难以计算的问题的。

20. 从使用的主要技术上看,可以把分类方法归结为哪几种类型

从使用技术上来分,可以分为四种类型:基于距离的分类方法、决策树分类方法、贝叶斯分类方法和规则归纳方法。

基于距离的分类方法主要有最邻近方法;

决策树方法有ID3、C4.5、VFDT等;

贝叶斯方法包括朴素贝叶斯方法和EM算法;

规则归纳方法包括AQ算法、CN2算法和FOIL算法。

21. 数据清理中,处理缺失值的方法是?

估算 - 整例删除 - 变量删除 - 成对删除

解释:

由于调查、编码和录入误差,数据中可能存在一些无效值和缺失值,需要给予适当的处理。常用的处理方法有:估算,整例删除,变量删除和成对删除。

估算(estimation)。最简单的办法就是用某个变量的样本均值、中位数或众数代替无效值和缺失值。这种办法简单,但没有充分考虑数据中已有的信息,误差可能较大。另一种办法就是根据调查对象对其他问题的答案,通过变量之间的相关分析或逻辑推论进行估计。例如,某一产品的拥有情况可能与家庭收入有关,可以根据调查对象的家庭收入推算拥有这一产品的可能性。

整例删除(casewise deletion)是剔除含有缺失值的样本。由于很多问卷都可能存在缺失值,这种做法的结果可能导致有效样本量大大减少,无法充分利用已经收集到的数据。因此,只适合关键变量缺失,或者含有无效值或缺失值的样本比重很小的情况。

变量删除(variable deletion)。如果某一变量的无效值和缺失值很多,而且该变量对于所研究的问题不是特别重要,则可以考虑将该变量删除。这种做法减少了供分析用的变量数目,但没有改变样本量。

成对删除(pairwise deletion)是用一个特殊码(通常是9、99、999等)代表无效值和缺失值,同时保留数据集中的全部变量和样本。但是,在具体计算时只采用有完整答案的样本,因而不同的分析因涉及的变量不同,其有效样本量也会有所不同。这是一种保守的处理方法,最大限度地保留了数据集中的可用信息。

采用不同的处理方法可能对分析结果产生影响,尤其是当缺失值的出现并非随机且变量之间明显相关时。因此,在调查中应当尽量避免出现无效值和缺失值,保证数据的完整性。

22. 以下()属于线性分类器最佳准则?

解释:

线性分类器有三大类:感知器准则函数、SVM、Fisher准则,而贝叶斯分类器不是线性分类器。

感知器准则函数:代价函数J=-(W*X+w0),分类的准则是最小化代价函数。感知器是神经网络(NN)的基础,网上有很多介绍。

SVM:支持向量机也是很经典的算法,优化目标是最大化间隔(margin),又称最大间隔分类器,是一种典型的线性分类器。(使用核函数可解决非线性问题)

Fisher准则:更广泛的称呼是线性判别分析(LDA),将所有样本投影到一条远点出发的直线,使得同类样本距离尽可能小,不同类样本距离尽可能大,具体为最大化“广义瑞利商”。

贝叶斯分类器:一种基于统计方法的分类器,要求先了解样本的分布特点(高斯、指数等),所以使用起来限制很多。在满足一些特定条件下,其优化目标与线性分类器有相同结构(同方差高斯分布等),其余条件下不是线性分类。

23. 假定某同学使用Naive Bayesian(NB)分类模型时,不小心将训练数据的两个维度搞重复了,那么关于NB的说法中正确的是:

A.模型效果相比无重复特征的情况下精确度会降低

B.当两列特征高度相关时,无法用两列特征相同时所得到的结论来分析问题

解释: 主要原因就是由于存在重复的类别之后,破坏了原本的独立性假设。

24. 在()情况下,用分支定界法做特征选择计算量相对较少?B.D (没懂)

B.选用的可分性判据J对特征数目单调不减

D, n为原始特征个数,d是要选出的特征个数。

25. 基于二次准则函数的H-K算法较之于感知器算法的优点是()?BD

B.可以判别问题是否线性可分

D.其解的适应性更好

26. 以下说法中正确的是(BD)

A.SVM对噪声(如来自其他分布的噪声样本)鲁棒

B.在AdaBoost算法中,所有被分错的样本的权重更新比例相同

C.Boosting和Bagging都是组合多个分类器投票的方法,二者都是根据单个分类器的正确率决定其权重

D.给定n个数据点,如果其中一半用于训练,一般用于测试,则训练误差和测试误差之间的差别会随着n的增加而减少

解释:

A. SVM并不是对噪声鲁棒的,soft-margin就是针对数据集中存在一些特异点,引入松弛变量得出的。所以当来自其它分布的噪声较多时,将不再鲁棒;

B.AdaBoost算法中不同的训练集是通过调整每个样本对应的权重来实现的。开始时,每个样本对应的权重是相同的,即其中n为样本个数,在此样本分布下训练出一弱分类器。对于分类错误的样本,加大其对应的权重;而对于分类正确的样本,降低其权重,这样分错的样本就被凸显出来,从而得到一个新的样本分布。在新的样本分布下,再次对样本进行训练,得到弱分类器。以此类推,将所有的弱分类器重叠加起来,得到强分类器。

C.

Boost和Bagging都是组合多个分类器投票的方法,二者均是根据单个分类器的正确率决定其权重。

Bagging与Boosting的区别:取样方式不同。Bagging采用均匀取样,而Boosting根据错误率取样。Bagging的各个预测函数没有权重,而Boosting是由权重的,Bagging的各个预测函数可以并行生成,而Boosing的哥哥预测函数只能顺序生成。

Bagging中每个基分类器的权重都是相同的;

- Adaboost与Bagging的区别:

- 采样方式:Adaboost是错误分类的样本的权重较大实际是每个样本都会使用;Bagging采用有放回的随机采样;

- 基分类器的权重系数:Adaboost中错误率较低的分类器权重较大;Bagging中采用投票法,所以每个基分类器的权重系数都是一样的。

- Bias-variance权衡:Adaboost更加关注bias,即总分类器的拟合能力更好;Bagging更加关注variance,即总分类器对数据扰动的承受能力更强

D.明显正确

27. 关于线性回归的描述,有

基本假设包括随机干扰项是均值为0,方差为1的标准正态分布 (T)

基本假设包括随机干扰项是均值为0的同方差正态分布 (F)

在违背基本假设时,普通最小二乘法估计量不再是最佳线性无偏估计量 (F)

在违背基本假设时,模型不再可以估计 (T)

可以用DW检验残差是否存在序列相关性 (F)

多重共线性会使得参数估计值方差减小 (T)

解释: 一元线性回归的基本假设有

1、随机误差项是一个期望值或平均值为0的随机变量;

2、对于解释变量的所有观测值,随机误差项有相同的方差;

3、随机误差项彼此不相关;

4、解释变量是确定性变量,不是随机变量,与随机误差项彼此之间相互独立;

5、解释变量之间不存在精确的(完全的)线性关系,即解释变量的样本观测值矩阵是满秩矩阵;

6、随机误差项服从正态分布

违背基本假设的计量经济学模型还是可以估计的,只是不能使用普通最小二乘法进行估计。

当存在异方差时,普通最小二乘法估计存在以下问题: 参数估计值虽然是无偏的,但不是最小方差线性无偏估计。

杜宾-瓦特森(DW)检验,计量经济,统计分析中常用的一种检验序列一阶 自相关 最常用的方法。

所谓多重共线性(Multicollinearity)是指线性回归模型中的解释变量之间由于存在精确相关关系或高度相关关系而使模型估计失真或难以估计准确。影响

(1)完全共线性下参数估计量不存在

(2)近似共线性下OLS估计量非有效

多重共线性使参数估计值的方差增大,1/(1-r2)为方差膨胀因子(Variance Inflation Factor, VIF)

(3)参数估计量经济含义不合理

(4)变量的显著性检验失去意义,可能将重要的解释变量排除在模型之外

(5)模型的预测功能失效。变大的方差容易使区间预测的“区间”变大,使预测失去意义。

28. 下列哪些方法可以用来对高维数据进行降维:

LASSO - PCA(主成分分析)- 聚类分析 - 小波分析法 - 线性判别法 - 拉普拉斯特征映射

29. 下列哪个不属于常用的文本分类的特征选择算法?D

A.卡方检验值

B.互信息

C.信息增益

D.主成分分析 (PCA是特征转换算法)

常采用特征选择方法。常见的六种特征选择方法:

1)DF(Document Frequency) 文档频率

DF:统计特征词出现的文档数量,用来衡量某个特征词的重要性

2)MI(Mutual Information) 互信息法

互信息法用于衡量特征词与文档类别直接的信息量。

如果某个特征词的频率很低,那么互信息得分就会很大,因此互信息法倾向"低频"的特征词。

相对的词频很高的词,得分就会变低,如果这词携带了很高的信息量,互信息法就会变得低效。

3)(Information Gain) 信息增益法

通过某个特征词的缺失与存在的两种情况下,语料中前后信息的增加,衡量某个特征词的重要性。

4)CHI(Chi-square) 卡方检验法

利用了统计学中的"假设检验"的基本思想:首先假设特征词与类别直接是不相关的

如果利用CHI分布计算出的检验值偏离阈值越大,那么更有信心否定原假设,接受原假设的备则假设:特征词与类别有着很高的关联度。

5)WLLR(Weighted Log Likelihood Ration)加权对数似然

6)WFO(Weighted Frequency and Odds)加权频率和可能性

30. 有两个样本点,第一个点为正样本,它的特征向量是(0,-1);第二个点为负样本,它的特征向量是(2,3),从这两个样本点组成的训练集构建一个线性SVM分类器的分类面方程是()

答案:x+2y=3

31. ARMA 是常见的时间序列算法模型.

32. 在HMM中,如果已知观察序列和产生观察序列的状态序列,那么可用以下哪种方法直接进行参数估计(极大似然估计)

33. 机器学习中L1正则化和L2正则化的区别是?

L1:使用L1可以得到稀疏的权值

L2 :使用L2可以得到平滑的权值

34. 数据挖掘的挖掘方法包括:( )ABCD

聚类分析 -回归分析 - 神经网咯 - 决策树算法

35. 统计和人工智能学科和数据挖掘息息相关。

36. 隐马尔可夫模型三个基本问题以及相应的算法说法正确的是( )ABC

A.评估—前向后向算法

B.解码—维特比算法

C.学习—Baum-Welch算法

解释:

针对以下三个问题,人们提出了相应的算法

*1 评估问题: 前向算法

*2 解码问题: Viterbi算法

*3 学习问题: Baum-Welch算法(向前向后算法)

前向、后向算法解决的是一个评估问题,即给定一个模型,求某特定观测序列的概率,用于评估该序列最匹配的模型。

Baum-Welch算法解决的是一个模型训练问题,即参数估计,是一种无监督的训练方法,主要通过EM迭代实现;

维特比算法解决的是给定 一个模型和某个特定的输出序列,求最可能产生这个输出的状态序列。如通过海藻变化(输出序列)来观测天气(状态序列),是预测问题,通信中的解码问题。

37. 以下描述错误的是:ABC

A. SVM是这样一个分类器,他寻找具有最小边缘的超平面,因此它也经常被称为最小边缘分类器(minimal margin classifier)(SVM的策略就是最大间隔分类器 )

B.在聚类分析当中,簇内的相似性越大,簇间的差别越大,聚类的效果就越差。(应该越好)

C.在决策树中,随着树中结点数变得太大,即使模型的训练误差还在继续减低,但是检验误差开始增大,这是出现了模型拟合不足的问题。(过拟合的问题)

D.聚类分析可以看作是一种非监督的分类。

38. 在分类问题中,我们经常会遇到正负样本数据量不等的情况,比如正样本为10w条数据,负样本只有1w条数据,以下合适的处理方法是()ACD

A. 将负样本重复10次,生成10w样本量,打乱顺序参与分类

C.从10w正样本中随机抽取1w参与分类

D.将负样本每个权重设置为10,正样本权重为1,参与训练过程

39. 影响聚类算法效果的主要原因有:( )?ABC

A.特征选取

B.模式相似性测度

C.分类准则

D.已知类别的样本质量(已知类别的样本质量,说的是有监督的训练吧,因为只有有监督的训练才要知道样本的类别,然后作为监督训练 的训练集,样本的质量自然是重要的。 )

40. SPSS中,数据整理的功能主要集中在(数据和转换)等菜单中。

41. 一监狱人脸识别准入系统用来识别待进入人员的身份,此系统一共包括识别4种不同的人员:狱警,小偷,送餐员,其他。下面哪种学习方法最适合此种应用需求:(多分类问题)。

实际业务中:

二分类足够了,因为人脸识别系统只需要做到识别:合法身份和非法身份,前者准入,后者不准入或者报警。

42. K-Means是无监督的聚类算法。

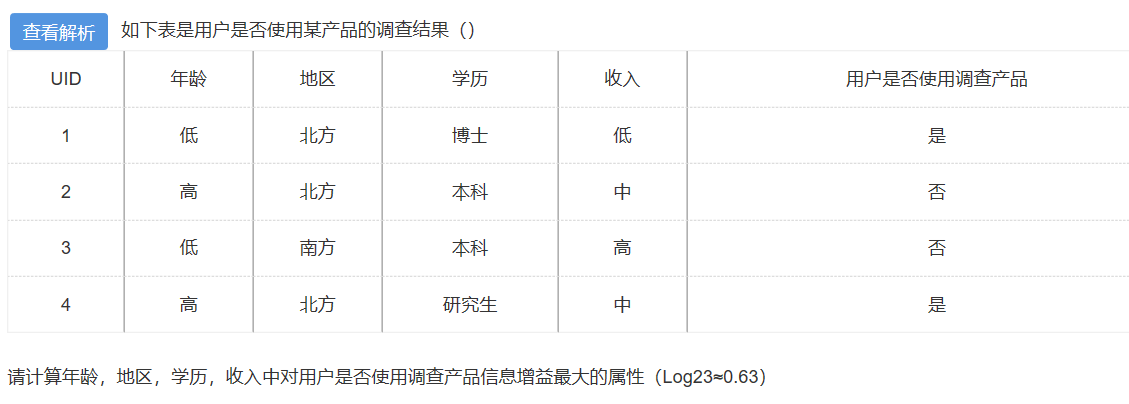

43.

答案是:学历

需要计算信息增益,具体计算过程详见另一篇博客。

44.解决隐马模型中预测问题的算法是? 维特比算法 见36题的解释

45. 下列方法中,可以用于特征降维的方法包括()ABCD

A. 主成分分析PCA

B.线性判别分析LDA

C.深度学习SparseAutoEncoder

D.矩阵奇异值分解SVD

E.最小二乘法LeastSquares

46.位势函数法的积累势函数K(x)的作用相当于Bayes判决中的() 后验概率 + 类概率密度与先验概率的乘积

47. 关于K-means聚类算法说法正确的是()ABC

A.对大数据集有较高的效率并且具有可伸缩性。

B.是一种无监督学习方法。

C.k值无法自动获取,初始聚类中心随机选择。

D.初始聚类中心的选择对聚类结果影响不大。(影响大)

解释:聚类是一个将数据集中在某些方面相似的数据成员进行分类组织的过程,聚类就是一种发现这种内在结构的技术,聚类技术经常被称为无监督学习。K均值聚类算法是先随机选取K个对象作为初始的聚类中心,然后计算每个对象与各个种子聚类中心之间的距离,把每个对象分配给距离它最近的聚类中心。k-means聚类算法是局部收敛的;k-means的聚类结果和初始聚类中心点的选取有关;k-means聚类算法的时间复杂度是O(NKT),其中N为样本个数,K为聚类团数量,T为迭代次数;k-means聚类算法无法自动确定聚类团数量。

K-Means的主要优点有:①原理比较简单,实现也是很容易,收敛速度快。②聚类效果较优。③算法的可解释度比较强。④主要需要调参的参数仅仅是簇数k。K-Means的主要缺点有:①K值的选取不好把握②对于不是凸的数据集比较难收敛③如果各隐含类别的数据不平衡,比如各隐含类别的数据量严重失衡,或者各隐含类别的方差不同,则聚类效果不佳。④采用迭代方法,得到的结果只是局部最优。⑤对噪音和异常点比较的敏感。

48. SPSS的界面中,以下是主窗口是( 数据编辑窗口)

49. 关于 logit 回归和 SVM 不正确的是() A

A.Logit回归目标函数是最小化后验概率

B.Logit回归可以用于预测事件发生概率的大小

C.SVM目标是结构风险最小化

D.SVM可以有效避免模型过拟合 !!!!

解释:

A. Logit回归本质上是一种根据样本对权值进行极大似然估计的方法,而后验概率正比于先验概率和似然函数的乘积。logit仅仅是最大化似然函数,并没有最大化后验概率,更谈不上最小化后验概率。A错误

B. Logit回归的输出就是样本属于正类别的几率,可以计算出概率,B正确

C. SVM的目标是找到使得训练数据尽可能分开且分类间隔最大的超平面,应该属于结构风险最小化,严格来说也是错误的。

D. SVM可以通过正则化系数控制模型的复杂度,避免过拟合。

50. 均值移动(Mean Shift)算法的核心思想是:

找到概率密度梯度为零的采样点,并以此作为特征空间聚类的模式点

51.

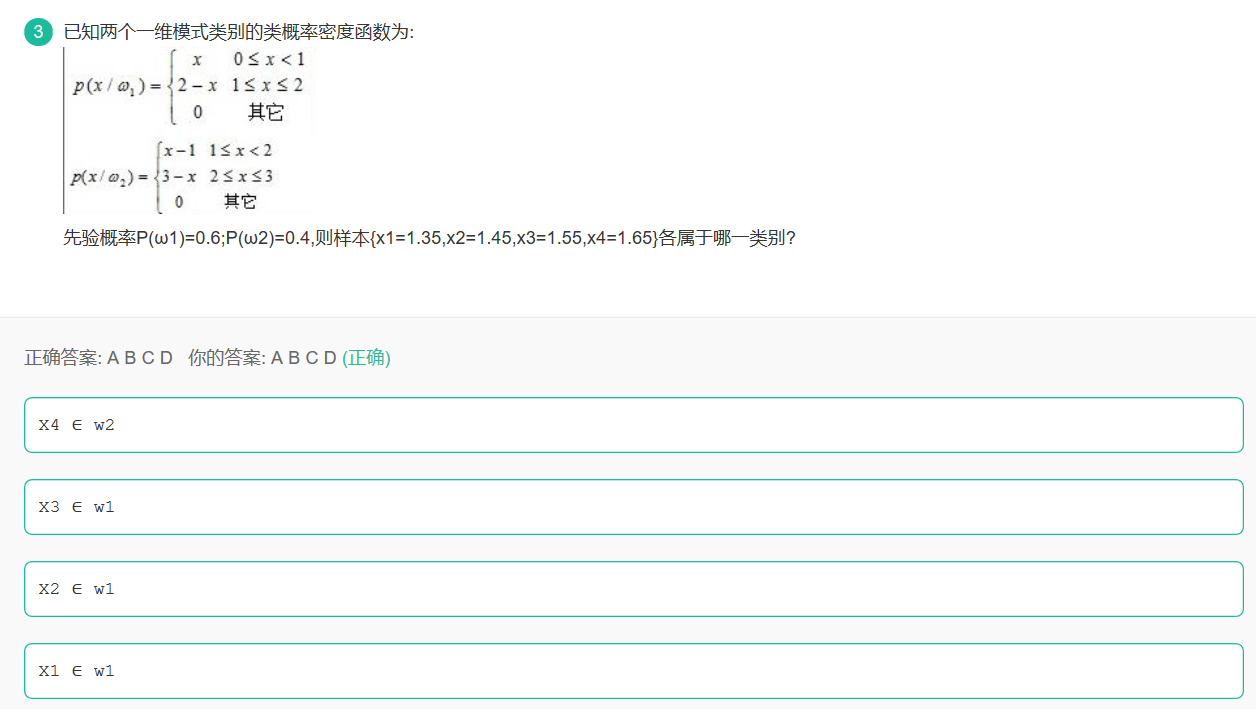

解释:

概率问题基本上都是贝叶斯和全概率互相关联/考察,,他们之间往往可以通过条件概率建立联系。

本题中,要判断 xi 属于w1,还是w2,就是判断 p(w1 | xi) 和 p(w2 | xi)的大小关系。即在xi已经发生的情况下,xi 属于哪个类别(w1 ,w2)的可能性更大。

p(w1 | xi) = p(xiw1) / p(xi) = p(xi | w1) * p(w1) / p(xi) = 0.6*(2 - xi) / p(xi) // 因为xi都在 (1,2)范围

p(w2 | xi) = p(xiw2) / p(xi) = p(xi | w2) * p(w2) / p(xi) = 0.4*(xi - 1) / p(xi) // 因为xi都在 (1,2)范围

上面两等式相减,得:

delta = p(w1 | xi) - p(w2 | xi) = (1.6 - xi) / p(xi)

所以,在上诉样本中,大于1.6的,属于w2,小于1.6的,属于w1。

看了一些公司的概率题基本上都是在贝叶斯和全概率上面扯,掌握这个套路就行。

52. 机器学习中做特征选择时,可能用到的方法有?

卡方 - 信息增益 - 平均互信息 - 期望交叉熵。

53. Nave Bayes是一种特殊的Bayes分类器,特征变量是X,类别标签是C,它的一个假定是:(特征变量X的各个维度是类别条件独立随机变量)

最后

以上就是平淡蜜粉最近收集整理的关于python ---机器学习【3】(7-28)的全部内容,更多相关python内容请搜索靠谱客的其他文章。

发表评论 取消回复