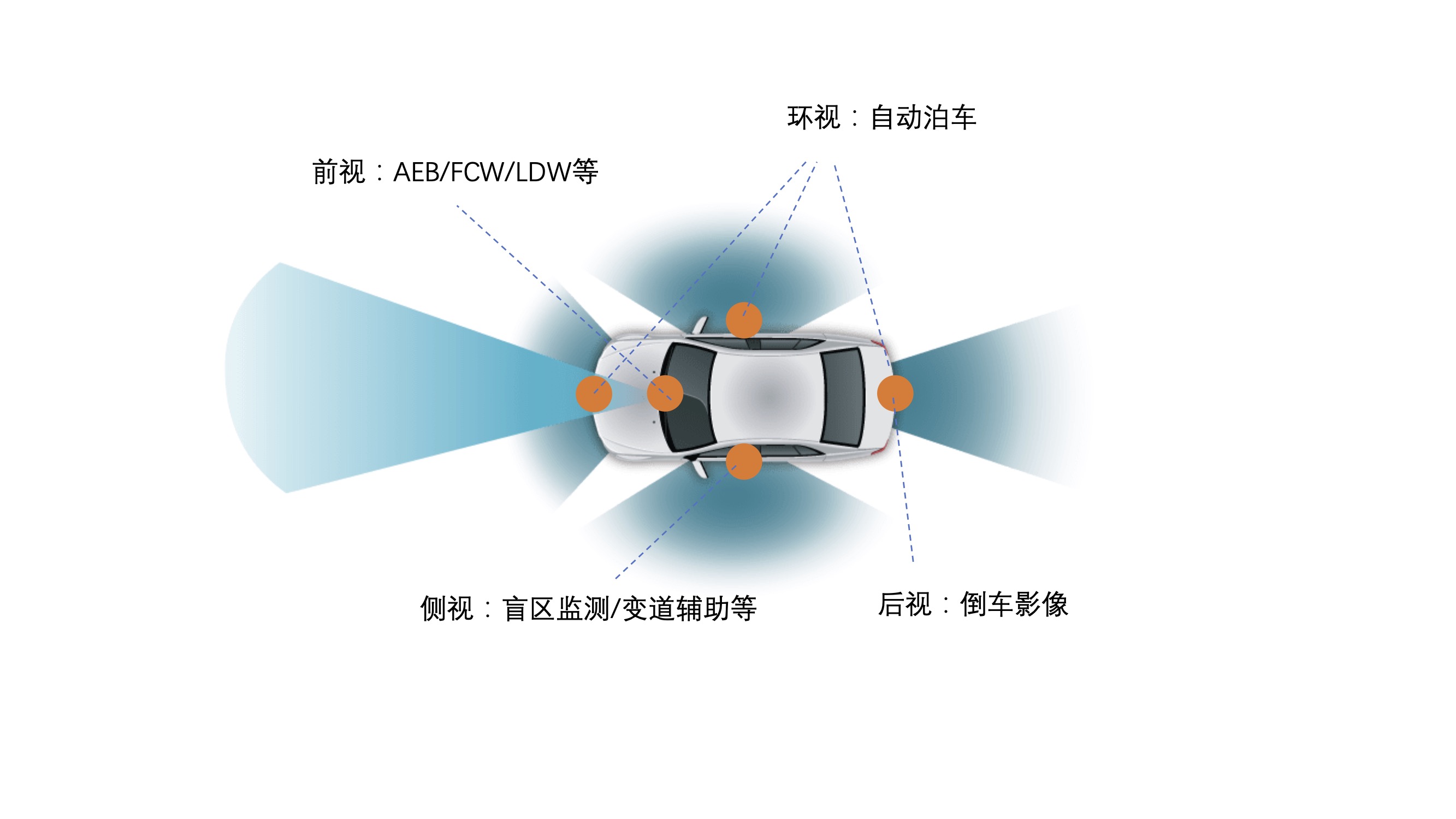

图1 摄像头在自动驾驶当中的应用

作者:Aili-Light | 公众号:艾利光科技

近年来,自动驾驶受到越来越多的关注,当前各大厂商的技术基本上集中在L2-L4级别。为了实现这些功能,感知系统一般会融合多种传感器的冗余数据,综合计算出周围的环境信息,提供给给控制系统。常见的车载传感器包括:毫米波雷达、视觉摄像头、激光雷达、GPS、IMU等。

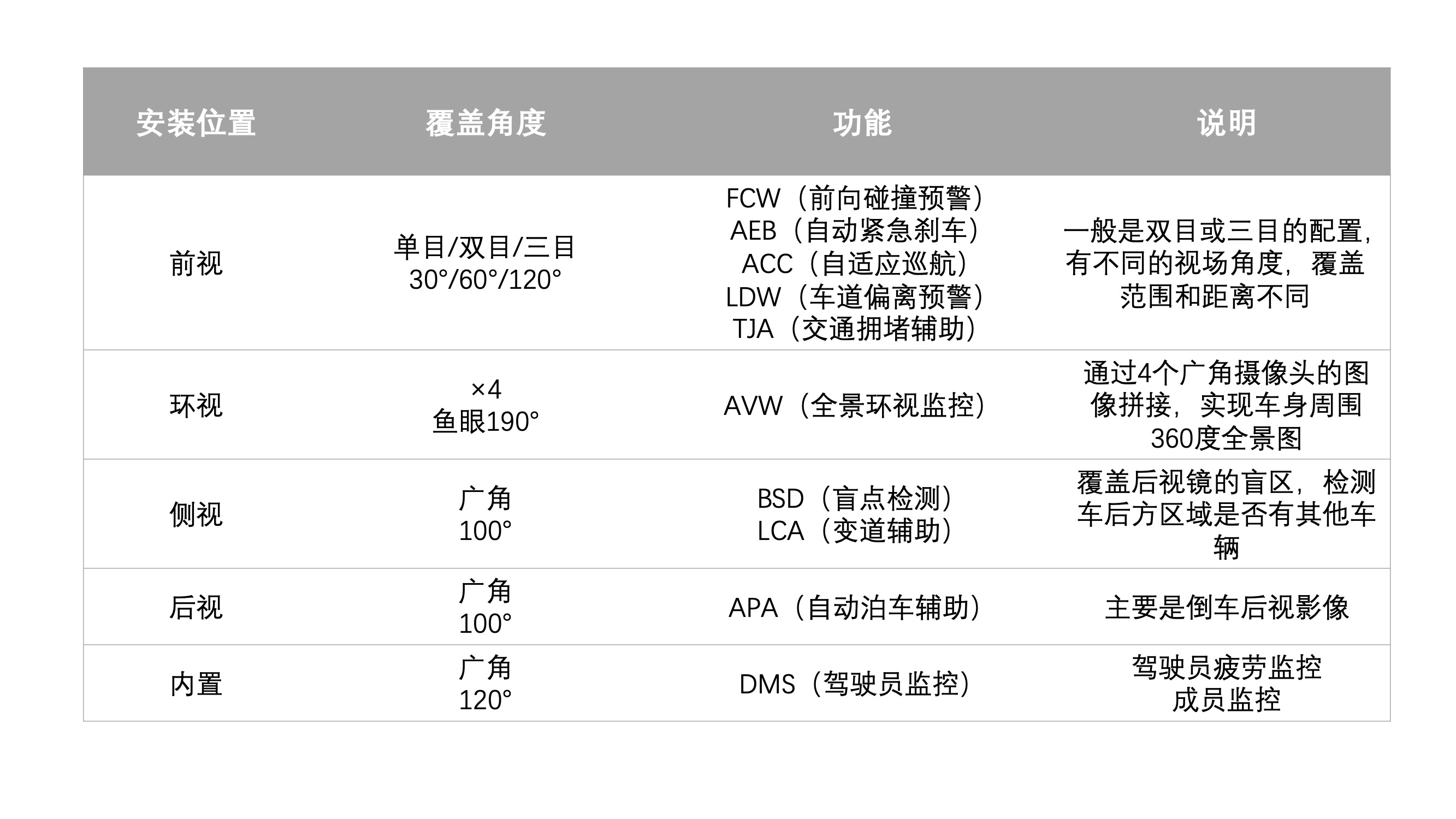

视觉摄像头作为其中一个很重要的传感器,应用在几乎所有的自动驾驶功能当中。例如特斯拉的自动驾驶系统FSD就搭配了8颗8百万像素(8MP)的摄像头,蔚来和小鹏等厂商,也配置了10颗以上的8百万像素摄像头。通常根据摄像头的安装位置,把车载摄像头分为前视、后视、环视、侧视以及舱内。如表1所示,不同的安装位置,所起的作用和功能不同,这些功能分为:

表1: 车载摄像头的分类和功能

自动驾驶对功能的定义并没有统一的标准,各家厂商定义了不同的功能和覆盖的场景,例如奥迪A8所定义的自动驾驶场景是: 在高速或有隔离带的多车道道路,堵车场景下(60km/h以下)开启的拥堵辅助(TJP,Traffic Jam Pilot)功能。又如广汽新能源埃安LX的自动驾驶场景是: 高精地图全路段的全速域自动驾驶,即在高精地图覆盖的中国高速及城市快速路,实现0-120km/h全速域脱手、脱脚自动驾驶。

因此,为了实现不同的功能,视觉摄像头需要满足不同的要求。例如在高速公路行驶的场景下,车速可达到120km/h,自动驾驶系统需要摄像头能看清200m之外的物体,才能让系统有足够的反应时间。理论上,越高的车速,需要的检测距离就会越远,检测的角度越小。然而在城市低速场景下,又需要摄像头能够覆盖驾驶员的盲区,有较大的视野范围。那么我们如何根据功能需求,选择合适的视觉摄像头配置呢?

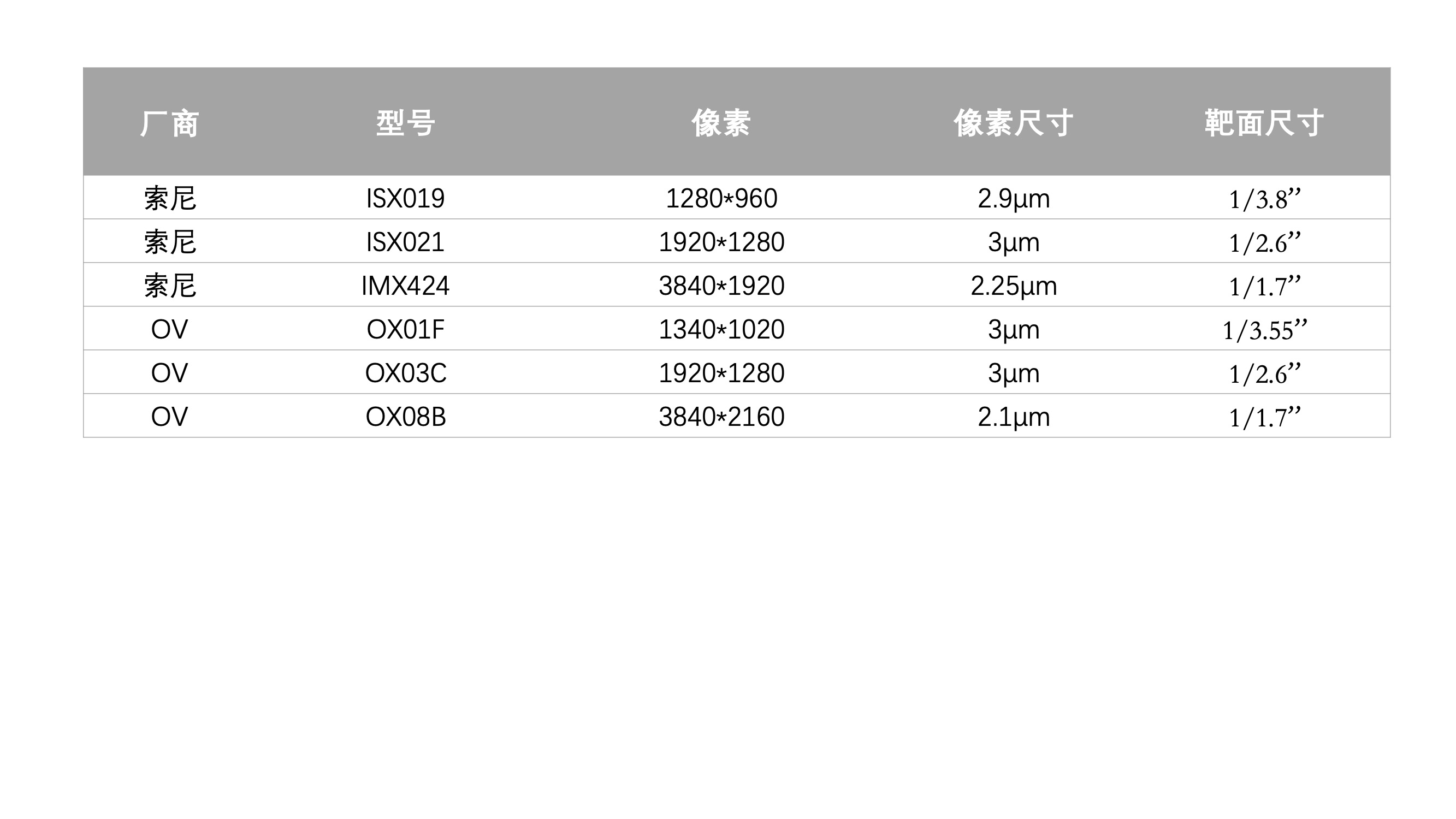

表2:常见的车规感光芯片的像素和靶面尺寸(单位为英寸)

图2:感光芯片的靶面尺寸示意图,越大的靶面尺寸表示进光量越多,一般车载CMOS的靶面尺寸1/3.5’’到1/1.7’’

镜头的视场角决定了每个像素能感知到的物体大小,例如2百万像素、靶面尺寸为1/2.6’’、FOV60°的摄像头,在110m远处,每个像素对应的大小约是6.5cm 。如果一辆小汽车的尺寸是1.6m×1.6m,它在图像中就会占据24×24个像素。一般情况下,假设镜头符合小孔成像模型,可以近似地认为像素数量M和物体尺寸h的关系为:

M=(h/d)*(f/p)

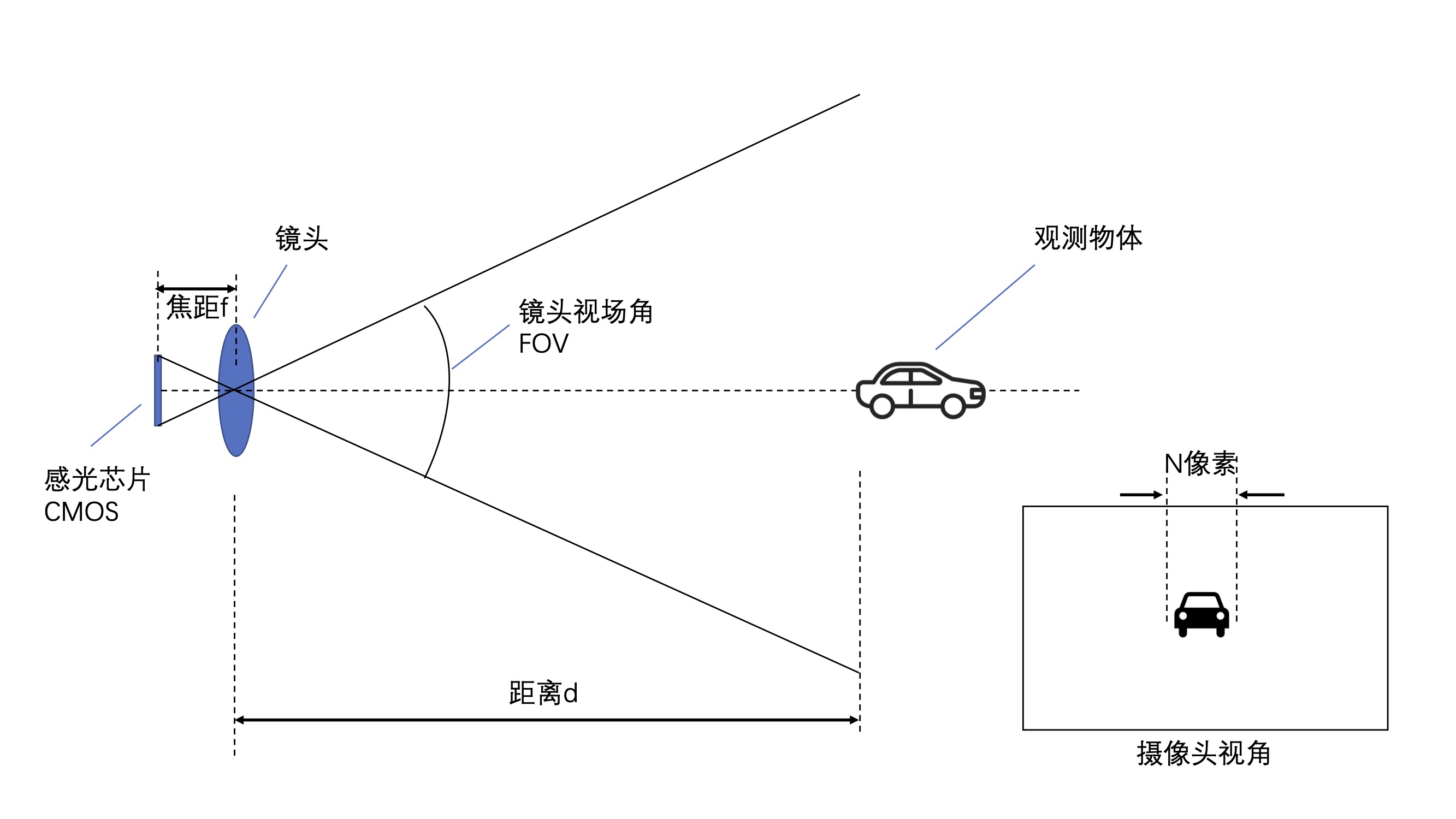

其中d是物体的距离,f是焦距,p是单个像素的大小,其几何关系如图3所示。

大部分的自动驾驶算法采用了卷积神经网络来识别物体,如果物体占据的像素点过少,则会被算法过滤掉,当做噪声处理。为了达到识别的效果,通常认为至少需要24个以上的像素来做判断,因此我们可以定义物体最小可分辨像素数为24,由此得出不同大小的物体,摄像头能观测到的最远距离。

了解更多车载摄像头信息,欢迎访问艾利光科技公众号,点击阅读原文。

最后

以上就是悦耳板栗最近收集整理的关于L2-L4自动驾驶视觉方案推荐(一)的全部内容,更多相关L2-L4自动驾驶视觉方案推荐(一)内容请搜索靠谱客的其他文章。

https://mp.weixin.qq.com/s?__biz=Mzg5MTczNzE3OA==&mid=2247483677&idx=1&sn=9800cb3ce57d68e7cfce145a91ab4590&chksm=cfc98428f8be0d3e338fd892d561f11953e80c6e315ca547434cc19b49390137770c06258821#rd

https://mp.weixin.qq.com/s?__biz=Mzg5MTczNzE3OA==&mid=2247483677&idx=1&sn=9800cb3ce57d68e7cfce145a91ab4590&chksm=cfc98428f8be0d3e338fd892d561f11953e80c6e315ca547434cc19b49390137770c06258821#rd

![[运动控制算法]Pure Pursuit纯路径跟踪算法纯路径跟踪总结参考](https://www.shuijiaxian.com/files_image/reation/bcimg21.png)

发表评论 取消回复