我是靠谱客的博主 爱笑鸭子,这篇文章主要介绍权重衰减(weight decay)的理解及Tensorflow的实现权重衰减(weight decay)的理解及Tensorflow的实现,现在分享给大家,希望可以做个参考。

权重衰减(weight decay)的理解及Tensorflow的实现

- 概要

- 公式解析

- 为什么会起作用

- Tensorflow的实现

1.概要:

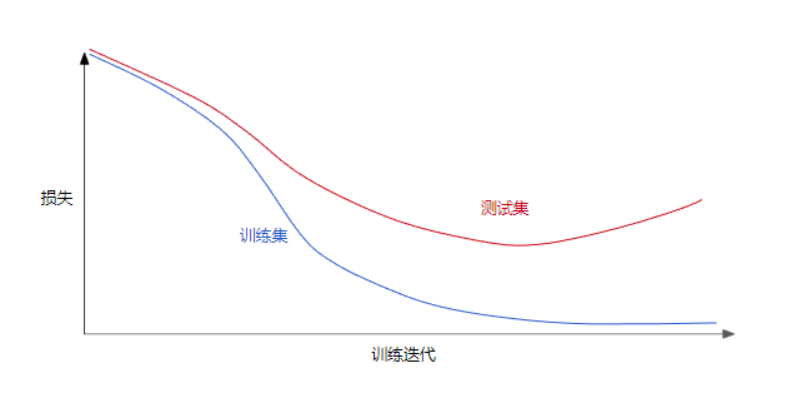

权重衰减即L2正则化,目的是通过在Loss函数后加一个正则化项,通过使权重减小的方式,一定减少模型过拟合的问题。

2.公式解析:

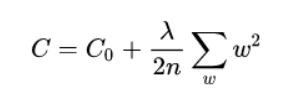

L2正则化的公式如图;

其中 C0 是原来并没有使用L2正则化时的损失函数,比如交叉熵函数等;

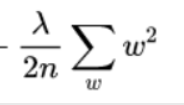

后面的:

这一项是正则化项,即计算权重矩阵w的所有项的平方和÷2n,然后× λ(也叫正则化系数),作为最终Loss函数的一项参与梯度下

最后

以上就是爱笑鸭子最近收集整理的关于权重衰减(weight decay)的理解及Tensorflow的实现权重衰减(weight decay)的理解及Tensorflow的实现的全部内容,更多相关权重衰减(weight内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复