按照Docker创建的集群下使用ansible部署hadoop教程,使用最新版本的hadoop3.0以后版本,一直出现mater节点正常启动,也包括datanode节点。查阅网上很多资料都是反应多次格式化引起。但是发现slave节点根本没有出现那些目录。所以心中一直有这个疑虑。当然也跳过很多坑!困扰我整整一个星期。

报着不解决问题死不休的心态,终于在茫茫问题解决贴中找到答案

传送门:hadoop错误- slave节点无法启动data node数据节点进程,但是master节点datanode正常启动

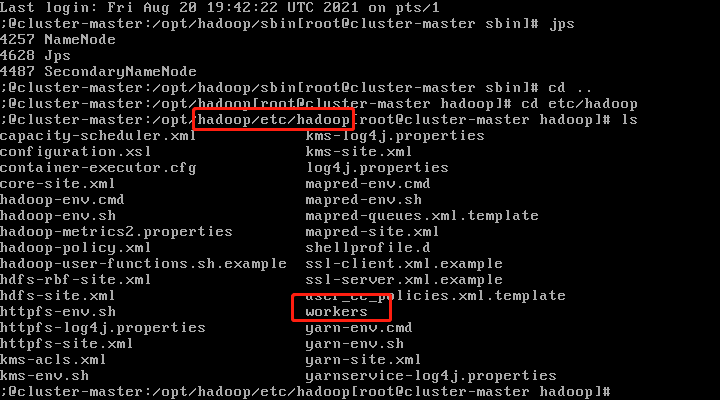

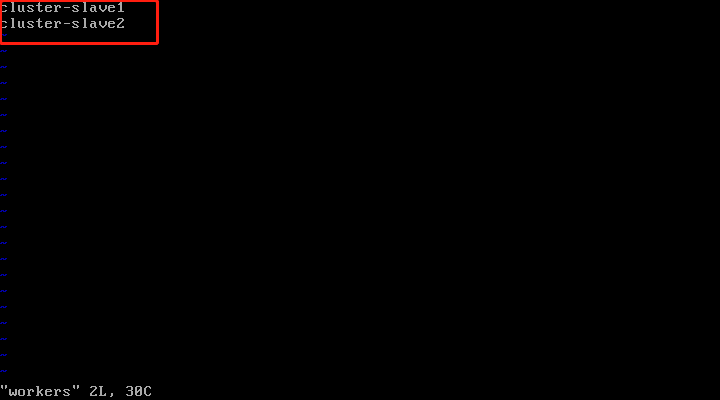

原因是:hadoop3.0以后slaves更名为workers。。。。。,直接在master节点的hadoop下配置文件workers填写子节点的主机名或ip地址即可

默认是localhost

同时修改slaver节点的workers,保存后重启./start-dfs.sh(前提是先stop掉服务)

整整一个星期的坑,爬完~~~~~~~

最后

以上就是俏皮小懒虫最近收集整理的关于hadoop slave节点无法启动datanode数据节点进程,但是master节点datanode正常启动的全部内容,更多相关hadoop内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复