import torch

from d2l import torch as d2l

from torch import nn

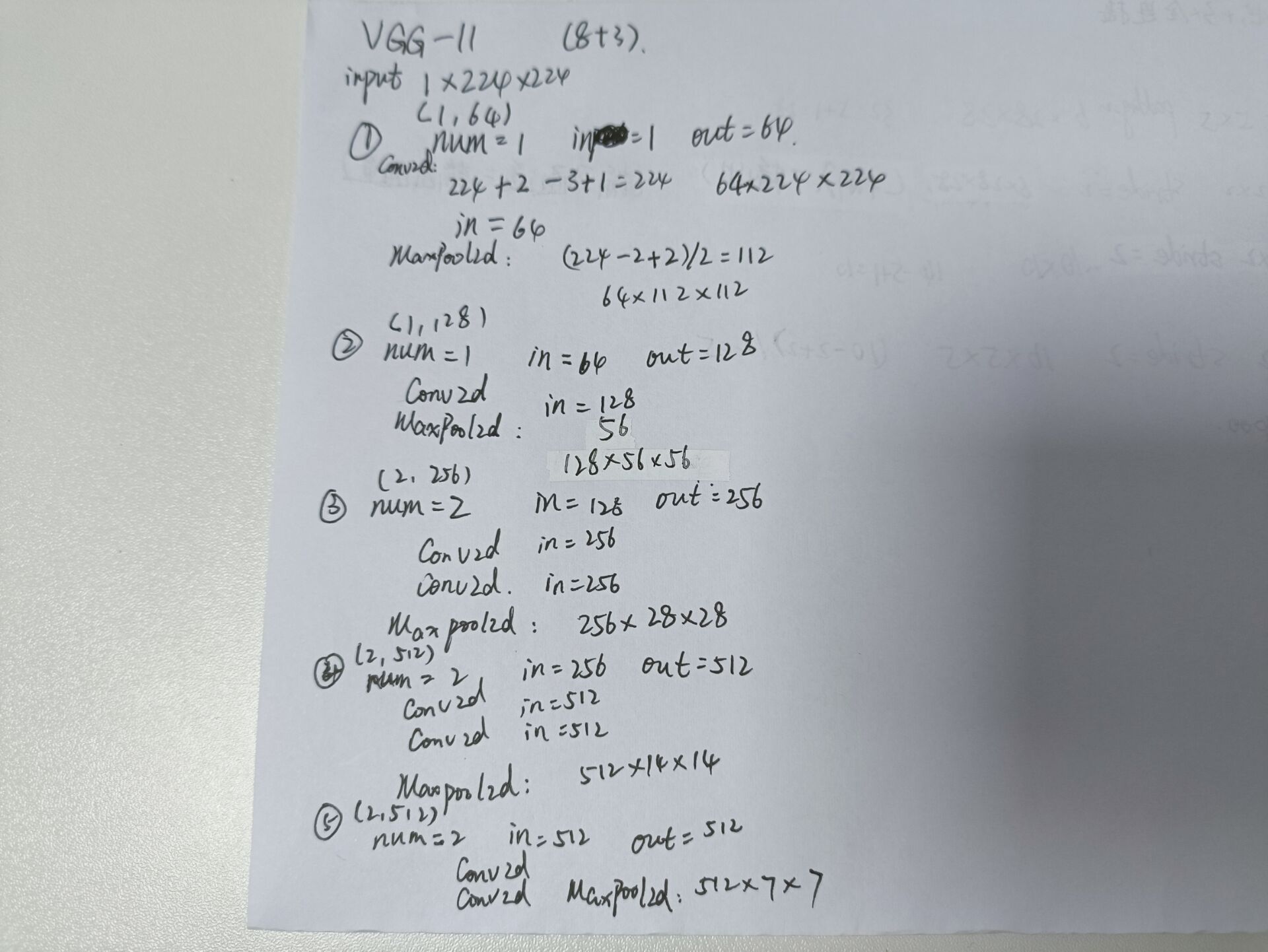

# 卷积层个数 输入通道个数 输出通道个数

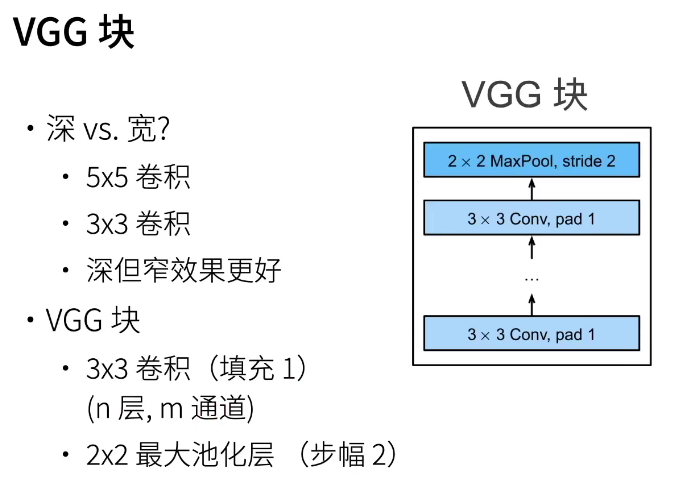

def vgg_block(num_convs,in_channels,out_channels):

layars=[]

for _ in range(num_convs):

layars.append(nn.Conv2d(in_channels,out_channels,kernel_size=3,padding=1))

layars.append(nn.ReLU())

in_channels = out_channels

layars.append(nn.MaxPool2d(kernel_size=2,stride=2))

return nn.Sequential(*layars)

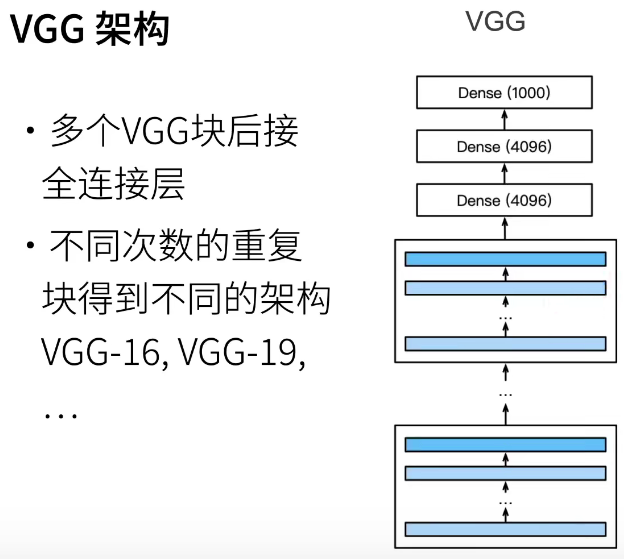

conv_arch = ((1,64),(1,128),(2,256),(2,512),(2,512))

def vgg(conv_arch):

conv_blks=[]

in_channels = 1

# 卷积层部分

for (num_convs, out_channels) in conv_arch:

conv_blks.append(vgg_block(num_convs, in_channels, out_channels))

in_channels = out_channels

return nn.Sequential(

*conv_blks, nn.Flatten(),

# 全连接层部分

nn.Linear(out_channels * 7 * 7, 4096), nn.ReLU(), nn.Dropout(0.5),

nn.Linear(4096, 4096), nn.ReLU(), nn.Dropout(0.5),

nn.Linear(4096, 10))

net = vgg(conv_arch)

X = torch.randn(size=(1, 1, 224, 224))

for blk in net:

X = blk(X)

print(blk.__class__.__name__,'output shape:t',X.shape)

# 由于VGG-11比AlexNet计算量更大,因此构建一个通道数较少的网络

ratio = 4

small_conv_arch = [(pair[0], pair[1] // ratio) for pair in conv_arch]

net = vgg(small_conv_arch)

lr, num_epochs, batch_size = 0.05, 10, 128

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224)

d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())

最后

以上就是大意跳跳糖最近收集整理的关于李沐笔记(使用块的网络VGG)的全部内容,更多相关李沐笔记(使用块内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复