目录

- 1. Inception V1

- 1.1 Inception module

- 2. Inception V2

- 3. Inception V3

- 4. Inception V4, Inception-ResNet

- 5. Xception(extreme inception)

主要列举的网络结构有:

- Inception V1: Going Deeper with Convolutions

- Inception V2: Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift

- Inception V3: Rethinking the Inception Architecture for Computer Vision

- Inception V4, Inception-ResNet: Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning

- Xception: Xception: Deep Learning with Depthwise Separable Convolutions

1. Inception V1

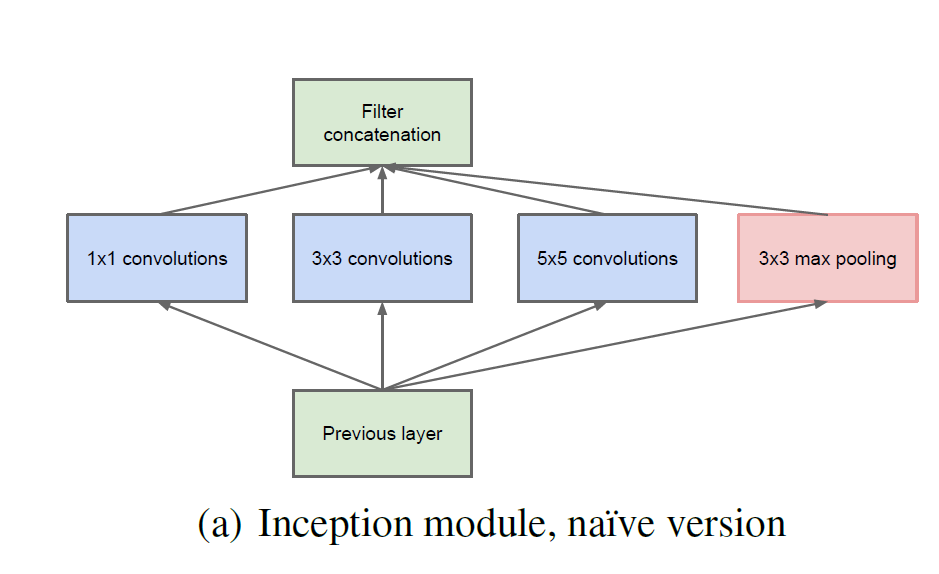

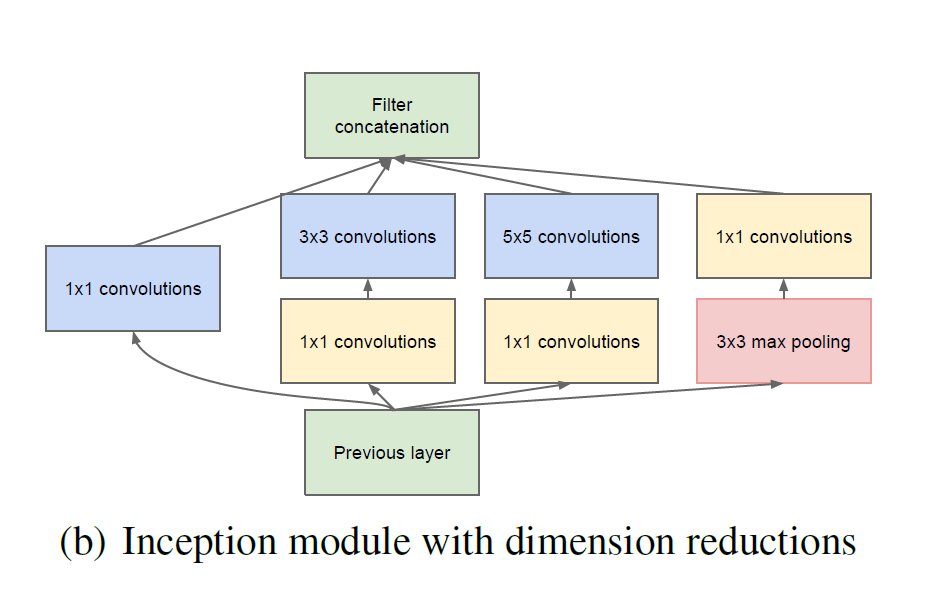

1.1 Inception module

- 利用Inception module叠加的形式构造网络;可以近似一个稀疏结构;

- 不同size的卷积核能够增强网络的适应力;

- 即增加了网络的深度,同时增加了网络对尺度的适应性;

- 随着更多的Inception module的叠加,同样也会带来计算成本的增加;

- Network-in-Network在卷积中的表示形式使:(1times 1)的卷积;

- (1times 1)的卷积能够有效地的降维,在其后使用激活函数,能够提高网络的表达能力;

- 有降维、减少参数量的作用;

- 提高了内部计算资源的利用率;

整个网络结构:

- 中间增加了两个loss,保证更好的收敛,有正则化的作用;

- 在最后一个全链接层前,使用Global average pooling;

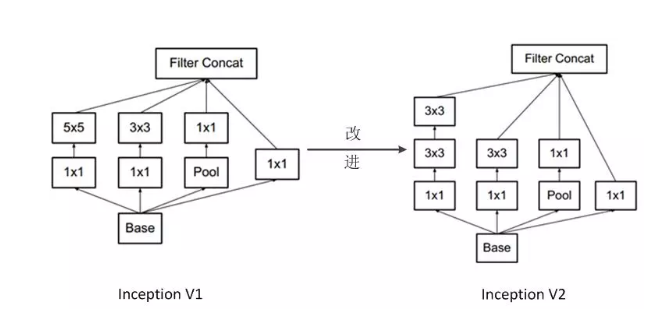

2. Inception V2

- 使用Batch Normalization层,即对min-batch内部进行标准化处理,使其输出规范到标准正态分布;

- 利用两个(3times 3)的卷积层代替一个(5times 5)的卷积层,降低了参数数量;

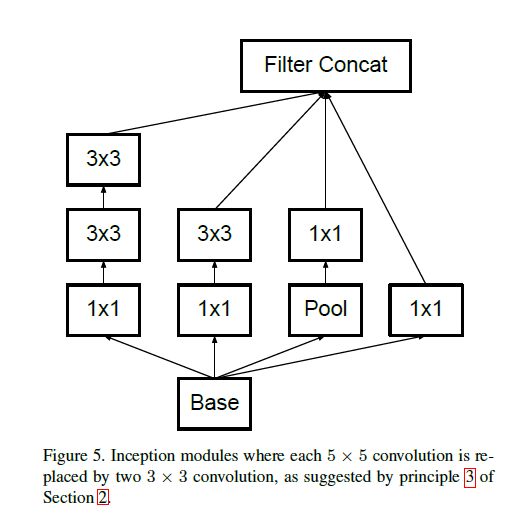

3. Inception V3

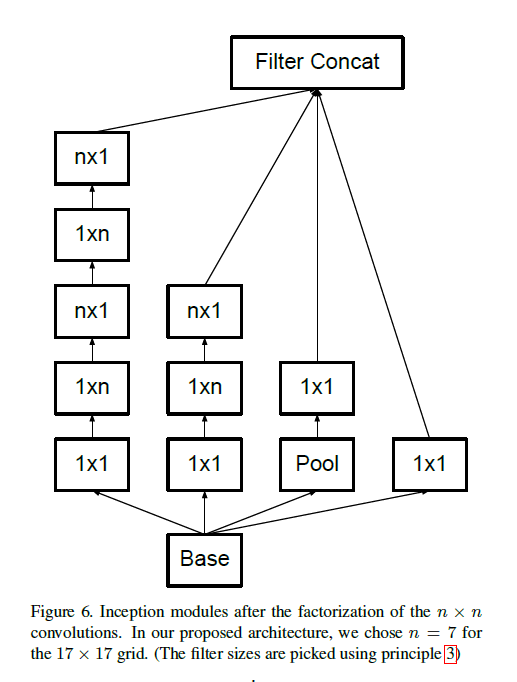

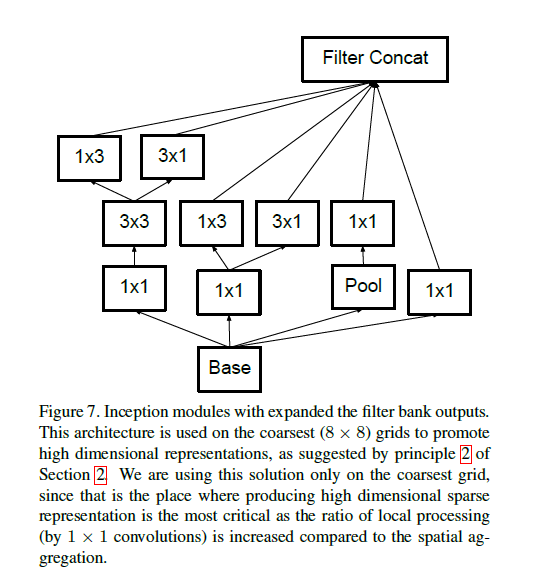

- 卷积分解:将(7times 7)的卷积分解成(1times 7, 7times 1)的两个卷积,(3times 3)的卷积也类似分解;可以用于加速计算,同时可以加深网络,也增加了网络的非线性;

- 在整个网络结构中,有三种卷积分解模型,见下图;

- 输入从(224 times 224)变成了(299 times 299);

4. Inception V4, Inception-ResNet

- 将Inception module与Residual Connection结合使用,加速训练,精度更高;

5. Xception(extreme inception)

转载于:https://www.cnblogs.com/chenzhen0530/p/10689278.html

最后

以上就是开朗唇彩最近收集整理的关于深度卷积网络-Inception系列的全部内容,更多相关深度卷积网络-Inception系列内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复