点击上方“3D视觉工坊”,选择“星标”

干货第一时间送达

/ 导读 /

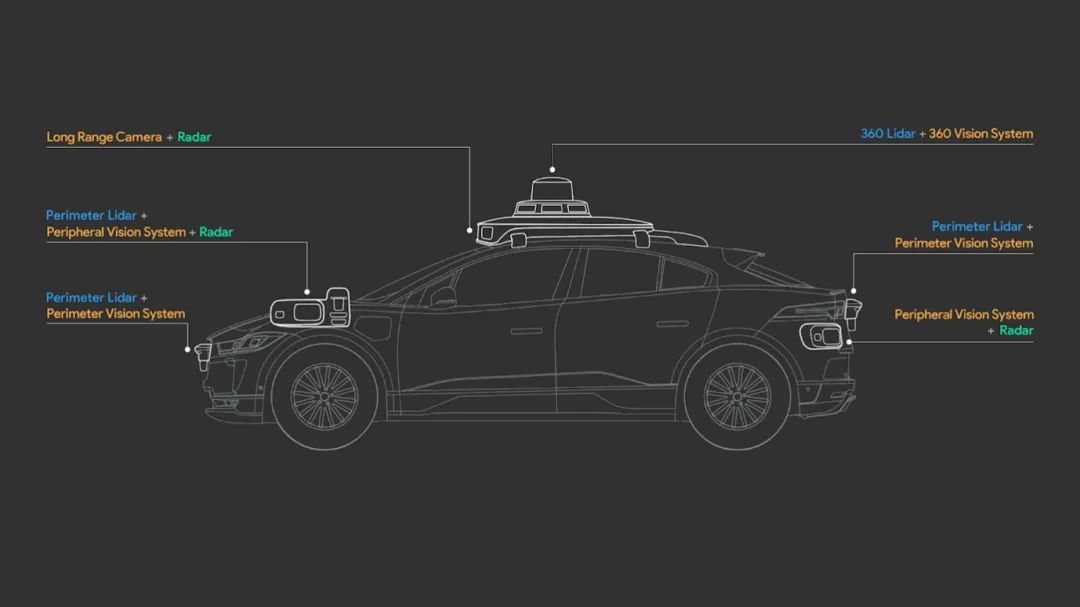

目前搭载自动驾驶功能的车辆所搭载的主流传感器有摄像头、毫米波雷达、超声波雷达和激光雷达。

为什么特斯拉不用激光雷达?

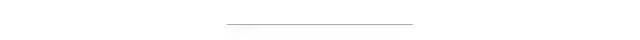

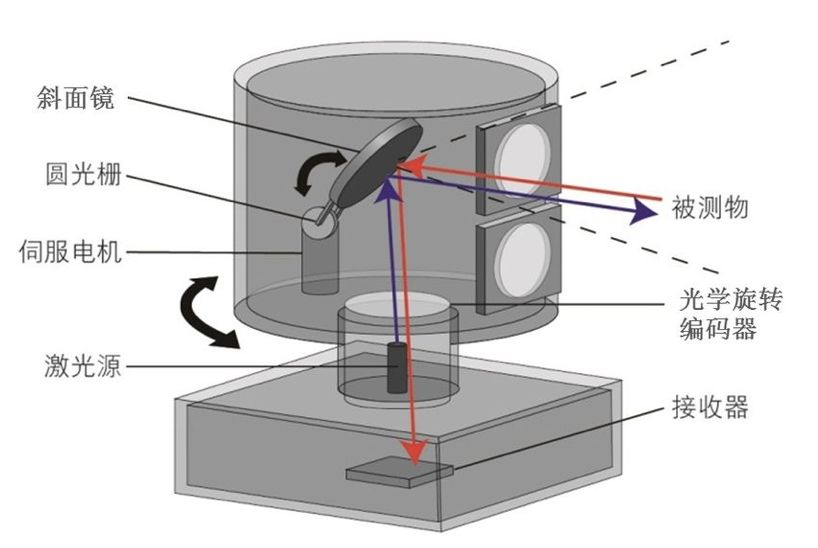

当前的汽车激光雷达主要分为机械式、MEMS、OPA、Flash四种方式,简单粗暴点理解就是:

激光雷达的原理类似于用激光笔对外发射光线,固态激光雷达对外发射激光的方向及角度是固定的,所以覆盖范围很有限,原理简单,器件比较稳定,造价也低。

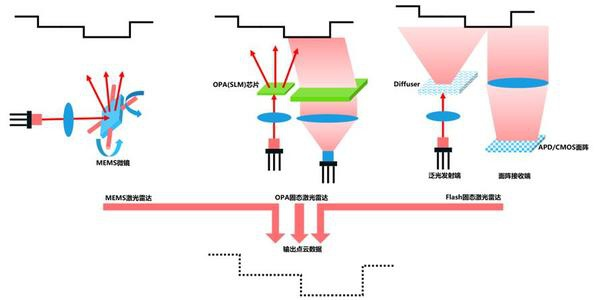

机械式激光雷达则是搞一面镜子绕着激光源转啊转,达到更多角度的覆盖,大家看到一些车辆上面有仪器在转啊转的,就是这个原理。因为对装配要求高,机械式激光雷达很难做到量产,例如,Velodyne 的32线激光雷达HDL-32E就需要32组发射光源与32组接收光源进行一一对应调试,还容易出故障。

混合固态激光雷达则是用MEMS振镜旋转来完成激光扫描,参考下图中的最右。需要运动的器件少于机械式激光雷达,所以在保证性能的情况下,更稳定,更容易满足汽车量产要求。

而特斯拉之所以不使用激光雷达,是因为激光雷达目前成本较高,并且能达到车规级的还不多,稳定性不高。

目前多家车企,如小鹏、蔚来都号称会在新车型中搭载激光雷达。而在L4级别自动驾驶领域,使用激光雷达的企业是以谷歌Waymo为代表的,是多传感器融合的路线,同时用上了摄像头和激光雷达。

多传感器融合是Waymo采用的主要路径,在自动驾驶应用中扮演着举足轻重的角色。

不同的传感器都有其自身的优势和劣势,例如摄像机在弱光及高对比度光线条件场景下很难捕捉足够的视觉信息;激光雷达在雾气/雨滴/雪花/汽车尾气/反射等场景下容易形成虚假点;毫米波雷达在通过隧道、大桥等场景下雷达探测可信性降低。

自动驾驶因其问题复杂度高、安全第一等特性,需要依靠多种传感器数据的相互融合来提高感知效果。将多传感器信息融合在一起的方式有多种,例如前融合和后融合。

前融合是将传感器原始信息直接融合到一起进行处理,这种方法使得算法在开始就能拿到最全面的数据。所有的数据都在最开始汇总在一起,但如果一个传感器出现问题,就会造成感知模块失效。

后融合是将各个传感器信息单独处理,各自在各自的处理通道上拿到接近最终形态的结果,之后再融合在一起。这种方法使得不同传感器彼此更加独立,即便个别传感器失效,或者标定同步有些许偏差,也对最终的结果影响不大。但对算力的消耗却比较大。

谷歌和特斯拉这两家公司,关于是否使用激光雷达的battle从未停止,diss连年不断。这不仅是两家公司之间的争论,也可以说是实现自动驾驶的路径之争。

特斯拉还不用高精地图?

什么是高精度地图

上面这张图是普通的导航地图,但这类地图在重庆这样的城市会经常失效。

重庆有大量穿行在山间的道路,重庆的高架一般都设有4层左右。在跟着导航走的时候,可能导航显示你走的是第三层的路线,而你走的却是第四层。

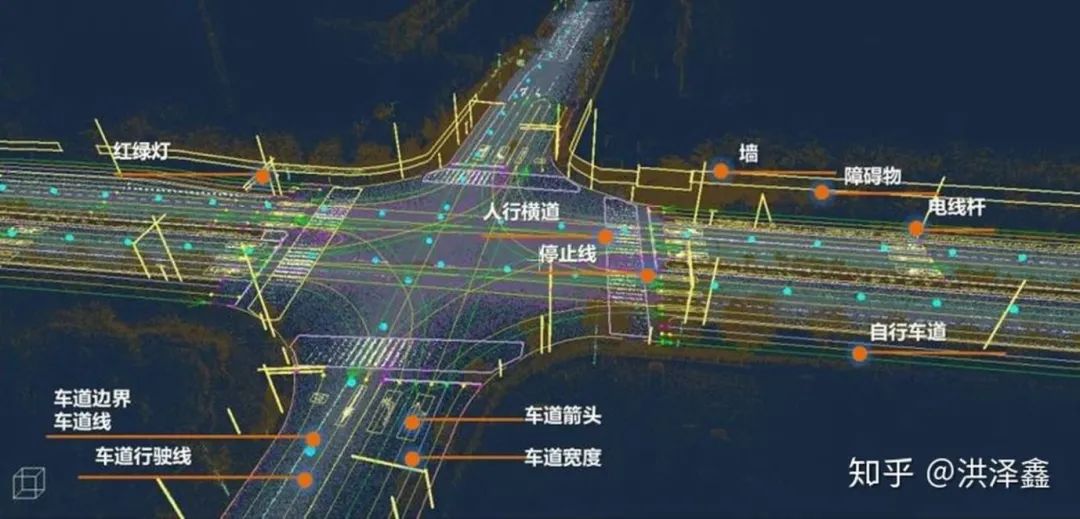

下面这张图是高精度地图:

这种图里只有车道线、路牌和红绿灯这些最基本的信息,这类高精度地图是给车看的,不是给人看的。因为车辆要实时用,不可能做得很真实漂亮,略去了很多细节。

如果把车辆比作一个人,那高精度地图就是你脑海里对于某个路段的记忆。如果旁边的景色跟你记忆中的景色匹配上了,就能够告诉你你具体是在哪个位置,避免出现像导航地图那样的问题,分不清是在主路还是在辅路,或者分不清在高架桥上还是在高架桥下。

一般的导航地图的作用就是导航,但在自动驾驶领域,导航只是高精度地图的最基本作用,除此之外,高精度地图还能发挥很多用处,简单举几个例子:

应对复杂天气和道路信息缺失

如果无人驾驶车开在路上,发现原本路上的一条车道线被磨没了,那车辆会不会就压线或者直接跑出当前车道了呢?有了高精度地图以后,在车道线残缺或没有车道线的场景中,高精度地图可提供道路信息,让车辆可以保持在一个车道里。

又或者突然下起暴雨或暴雪的情况下,有些车道线被路面雨水反光给影响了,或者被雪给盖住了。那靠着高精度地图,也能减少影响。

此外,在无人驾驶车经过一些坡道时,高精度地图里因为有坡道的信息,也能让车辆尽早做好速度规划。或者,当你要经过一个弯道时,高精度地图可提前为无人驾驶车提供弯道的曲率信息,让无人驾驶车可以规划好最适合弯道的拐弯速度。

让无人车驾驶决策更符合人类驾驶习惯

现在的无人驾驶车辆的速度都很低,主要是出于安全考虑。而且无人驾驶车辆对限速的感知并不一定准确,比如前一段路的限速是40公里每小时,这一段路变成了60公里每小时,但却没有指示牌。

如果车辆在路上一直保持40公里每小时的速度,肯定会被各种鸣笛、超车,更容易出事故。

而未来高精度地图也可以通过收集过往信息,知道每个时段在某个路段车辆的平均行驶速度,这样无人驾驶车可以选择一个更符合人类驾驶习惯的合适速度。就跟现有的一般导航地图可以查询过往某段路程在某个时间的预计行驶时间一样。

在面对复杂环境时,更好地了解其他车的行为

为了让无人驾驶车在行驶过程中能够及时、准确地对他车行为作出反应,保证行驶的舒适性与安全性,算法需要对他车的行为与路径作出相对准确的预测。

借助高精度地图提供的信息,可以为预测算法提供很强的辅助信息,举个例子,通过高精度地图查询到前方右侧有辅路入口或者车道合并的情况,那么该处出现的车辆就很有可能会作出向左变道或加速并入等动作。根据左右车道线虚实情况,也可以更好的帮无人驾驶车判断旁边车辆加塞的可能性。

未来,还可以跟路端的传感器信息相结合,比如现有马路上的限速摄像头,如果通过感知算法,能把路上车辆的情况都感知出来,并且同步在高精度地图里,那也就不用担心车辆周围会有感应不到的盲区了,也能避免鬼探头等情况的发生。

目前高精度地图最大的两个问题

1.标准不统一

可能各家都有各家的标准,所以数据无法共通,地图也无法共用。

统一高精地图的数据模型与交换格式,将有助于减少汽车制造商的开发时间和不必要的成本,同时保证未来跨品牌车辆使用的高清地图都可以不断共享刷新数据。

2019年6月,全国智能运输系统标准化技术委员会正式在官方网站发布智能驾驶电子地图数据模型与交换格式的相关国家标准征求意见稿,相信过不久标准也能得到统一。

参与起草相关的国家标准的单位有四维图新、高德软件有限公司、北京百度网讯科技有限公司、交通运输部公路科学研究院、武汉中海庭数据技术有限公司、上海汽车集团股份有限公司、北京建筑大学等。

2.更新成本高且慢

目前国内很多自动驾驶方案,较多地采用了激光雷达LiDAR的定位方案,通过LiDAR发射的激光,感知周边建筑及道路环境作为约束,实现高精度定位。

这种方案可以实现10cm量级的定位精度,但是激光雷达成本较高,很难做到大规模建图和经常性更新。

另外还有利用视觉方案进行定位的方案,但这种方案做出来的地图不确定性太大,毕竟是靠视觉,可能会漏检许多东西。

高精度地图对于无人驾驶车至关重要,不解决这两大难题,无人驾驶很难有大规模的商业化落地。

在坚决不用激光雷达以及高精度地图的情况下,特斯拉目前的自动驾驶功能还只能达到L2级别,只是自动驾驶辅助功能,不能脱离双手或者脱离双脚,技术的成熟度远远不够。

本文仅做学术分享,如有侵权,请联系删文。

下载1

在「3D视觉工坊」公众号后台回复:3D视觉,即可下载 3D视觉相关资料干货,涉及相机标定、三维重建、立体视觉、SLAM、深度学习、点云后处理、多视图几何等方向。

下载2

在「3D视觉工坊」公众号后台回复:3D视觉github资源汇总,即可下载包括结构光、标定源码、缺陷检测源码、深度估计与深度补全源码、点云处理相关源码、立体匹配源码、单目、双目3D检测、基于点云的3D检测、6D姿态估计源码汇总等。

下载3

在「3D视觉工坊」公众号后台回复:相机标定,即可下载独家相机标定学习课件与视频网址;后台回复:立体匹配,即可下载独家立体匹配学习课件与视频网址。

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的知识点汇总、入门进阶学习路线、最新paper分享、疑问解答四个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近3000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、可答疑解惑、助你高效解决问题

觉得有用,麻烦给个赞和在看~

最后

以上就是慈祥百褶裙最近收集整理的关于特斯拉为什么不用激光雷达和高精地图?的全部内容,更多相关特斯拉为什么不用激光雷达和高精地图内容请搜索靠谱客的其他文章。

发表评论 取消回复