我是靠谱客的博主 纯情狗,这篇文章主要介绍读论文《A Neural Probabilistic Language Model》读论文《A Neural Probabilistic Language Model》,现在分享给大家,希望可以做个参考。

读论文《A Neural Probabilistic Language Model》

原文地址:http://blog.csdn.net/qq_31456593/article/details/77482256

introduce

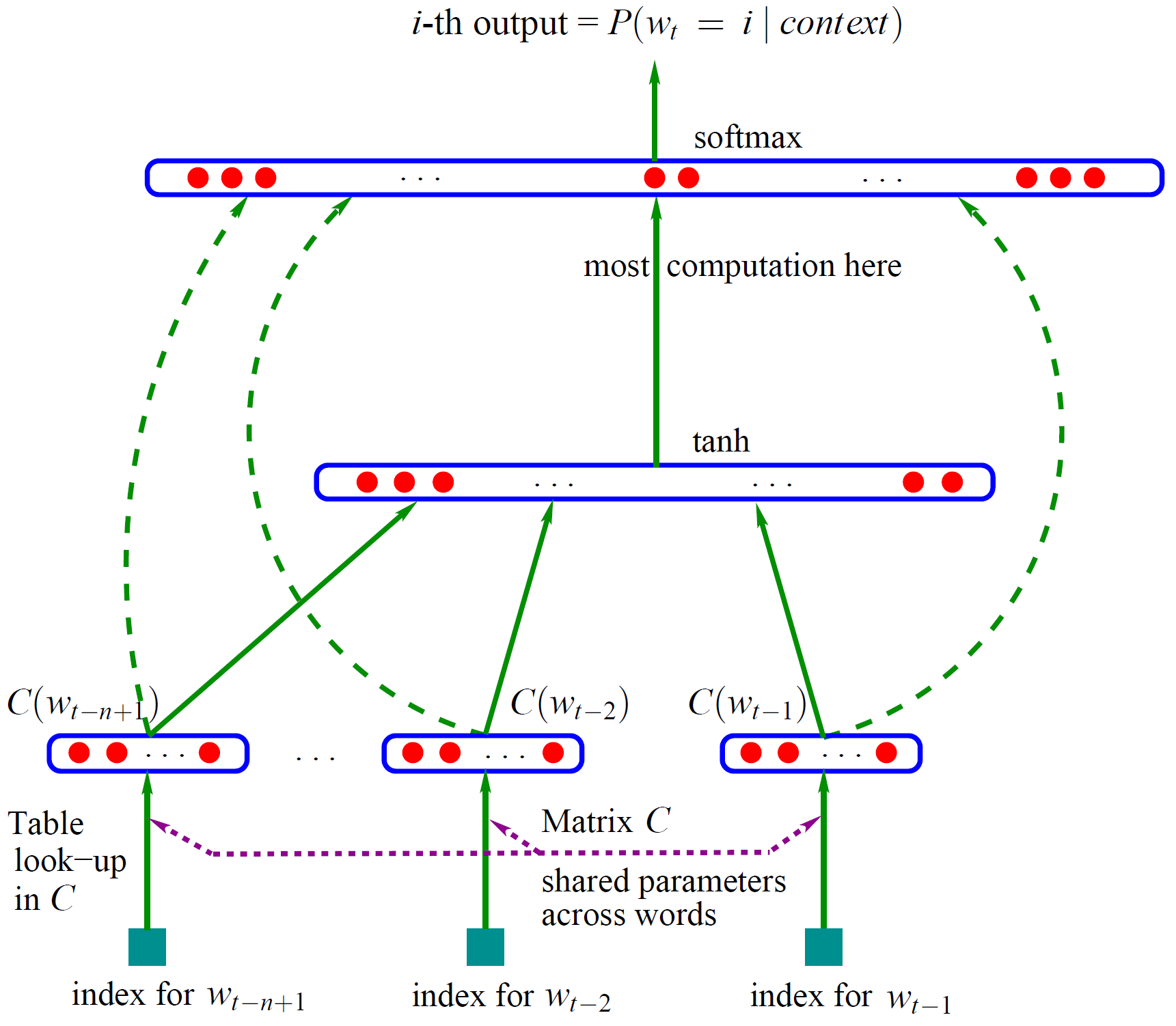

本文算是训练语言模型的经典之作,Bengio将神经网络引入语言模型的训练中,并得到了词嵌入这个副产物。词嵌入对后面深度学习在自然语言处理方面有很大的贡献,也是获取词的语义特征的有效方法。

论文的提出源于解决原词向量(one-hot表示)会照成维数灾难的问题,作者建议通过学习词的分布式表示来解决这个问题。作者基于n-gram模型,通过使用语料对神经网络进行训练,最大化上文的n个词语对当前词语的预测。该模型同时学到了(1)每个单词的分布式表示和(2)单词序列的概率分布函数。

该模型学习到的词汇表示,与传统的one-hot表示不同,它可通过词嵌入之间的距离(欧几里得距离、余弦距离等),表示词汇间的相似程度。如在:

The cat is walking in the bedroom

A dog was running in a room

中,cat和dog有着相似的语义

method

作者提出的网络模型如下图所示:

最后

以上就是纯情狗最近收集整理的关于读论文《A Neural Probabilistic Language Model》读论文《A Neural Probabilistic Language Model》的全部内容,更多相关读论文《A内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复