机器学习面试:1-10题(1day)

A. Logit回归本质上是一种根据样本对权值进行极大似然估计的方法,而后验概率正比于先验概率和似然函数的乘积。logit仅仅是最大似然函数,并没有最大化后验概率,更谈不上最小化后验概率。A错误

B. Logit回归的输出就是样本属于正类别的几率,可以计算出概率,正确

C. SVM的目标是找到使得训练数据尽可能分开且分类间隔最大的分离超平面,应该属于结构风险最小化。

D. SVM:训练好的模型的算法复杂度是由支持向量的个数决定的,而不是由数据的维度决定的,所以SVM不太容易产生overfitting,SVM训练出的模型比较容易被泛化(SVM如果训练得到的支持向量的个数比较少。)

神经网络是一个通用的逼近算法,所以它可以实现线性回归。

理论上,如果有足够多的隐层和只够大的训练集,可以模拟出任何方程。

D:参数C为惩罚因子,C越小,分类间隔越大,分类错误越多,趋于欠学习;C越大,分类间隔越小,分类错误越少,趋于过拟合。

在决策树的ID3算法中,父亲节点的信息增益比其子节点的信息增益大,G(A)=H(D)-H(D|A),信息增益大,对应的其熵值越小,熵值越小不确定性越小。

判别式模型(discriminative model)通过求解条件概率分布P(y|x)或者直接计算y的值来预测y。

生成式模型(generative model)通过对观测值和标注数据计算联合概率分布P(x,y)来达到判定估算y的目的。

常见的判别式模型:线性回归(Linear Regression)、逻辑回归(Logistic Regression)、支持向量机(SVM)、 传统神经网络(Traditional Neural Networks)、线性判别分析(Linear Discriminative Analysis)、条件随机场(Conditional Random Field)、kNN、最大熵模型;

常见的生成式模型:朴素贝叶斯(Naive Bayes)、 隐马尔科夫模型(HMM)、贝叶斯网络(Bayesian Networks)和隐含狄利克雷分布(Latent Dirichlet Allocation)。

ID3算法(信息增益):是一个多叉树模型,依赖于特征数目比较多的特征,而属性值最多的属性并不一定是最优的,抗噪性差,只适用于小规模数据集,需要将数据放到内存中。G(A)=H(D)-H(D|A);

C4.5算法(信息增益率):是一个多叉树模型,G(A)=H(D)-H(D|A),GR(A)=G(A)/H(A);

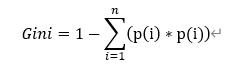

CART算法(基尼系数)(回归树算法):是一个二叉树模型。

Gain = Gini(D)-Gini(D|A)

欧氏距离:几何空间下两点距离。

集成算法:

1、bagging算法:bagging+决策树=随机森林

2、boosting算法:AdaBoost+决策树=提升树

bagging:对于分类问题:由投票表决产生分类结果

对于回归问题:由k个模型预测结果的均值作为最后预测的结果。

boosting:提升方法:在分类问题中,通过改变训练样本的权重,学习多个分类器,并将这些分类器进行线性组合,提高分类的性能。

最后

以上就是懵懂哑铃最近收集整理的关于机器学习面试题库:1-10题(1day)的全部内容,更多相关机器学习面试题库内容请搜索靠谱客的其他文章。

发表评论 取消回复