Lecture 1: introduction of deep learning

深度学习3步骤:

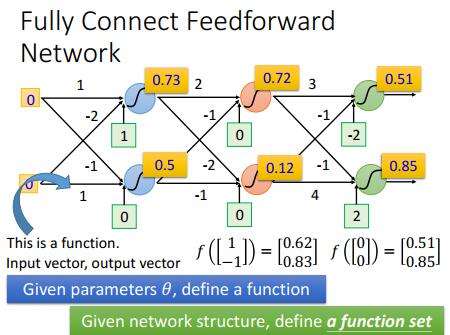

1.定义神经网络

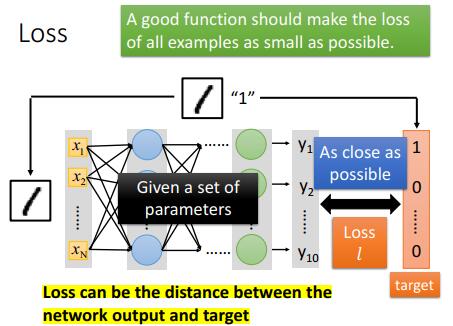

2.loss 评价

预测值和真实的测试数据的目标值进行比对,它们的差距就是Loss。一个好的神经网络应该使loss尽可能小。

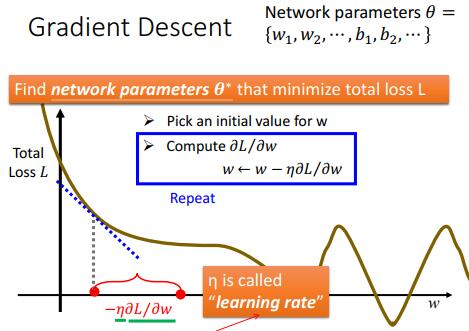

3.获取最佳的神经网络参数(学习方法)

采用梯度下降算法

Lecture II:Tips for Training DNN

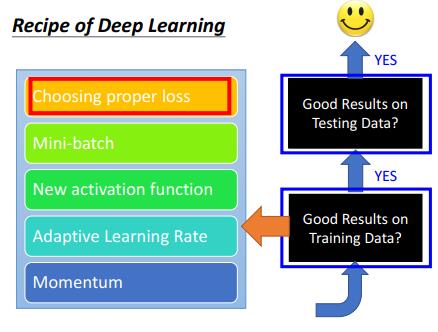

A.网络优化训练

-

选择合适的Loss function:使用Cross Entropy效果要优于Mean Square Error。(When using softmax output layer,choose cross entropy)

-

Mini-batch: 每次训练使用少量数据而不是全量数据效率更高

-

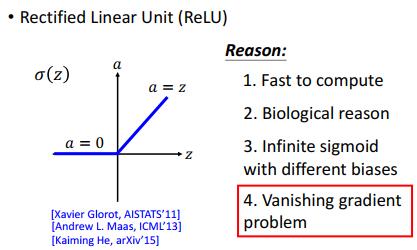

Activation Function:使用ReLU替代Sigmoid可以解决梯度消失的问题,可以训练更深的神经网络

-

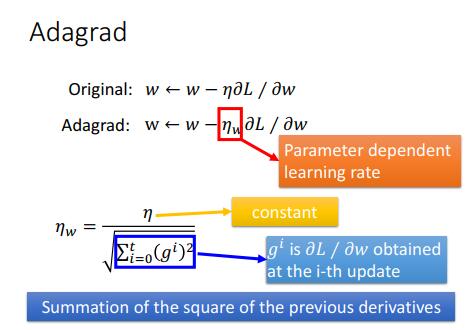

Adaptive Learning Rate:可以随着迭代不断自我调整,提高学习效率)

-

Momentum: 可以一定程度上避免陷入局部最低点的问题

B.避免过拟合

避免过度拟合(overfitting)的方法:

- Early Stopping:使用cross validation的方式,不断对validation

data进行检验,一旦发现预测精度下降则停止。 - Weight Decay:权值

- Dropout:通过随机去掉一些节点的连接达到改变网络形式,所以会产生出多种网络形态,然后汇集得到一个最佳结果

- Network Structure: 例如CNN等其他形态的网络

Lecture III:Variants of Neural Networks

A. Convolutional Neural Network (CNN)

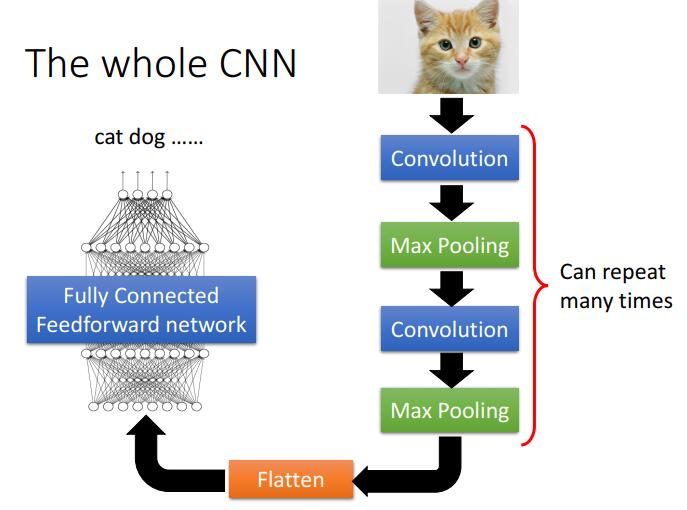

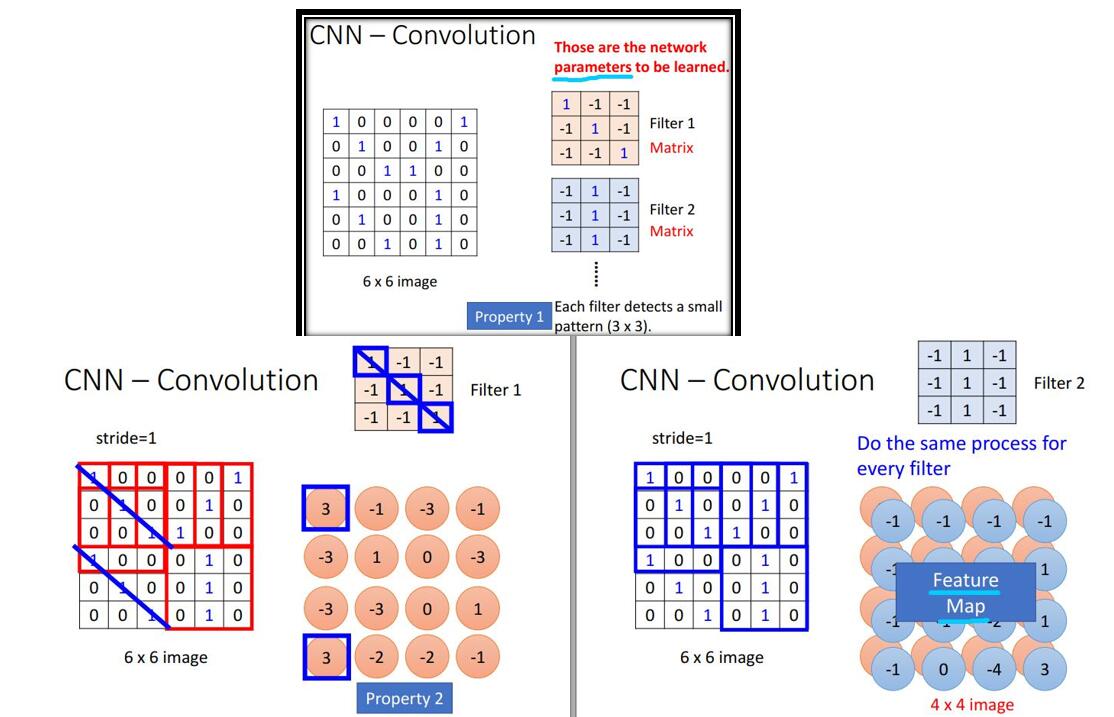

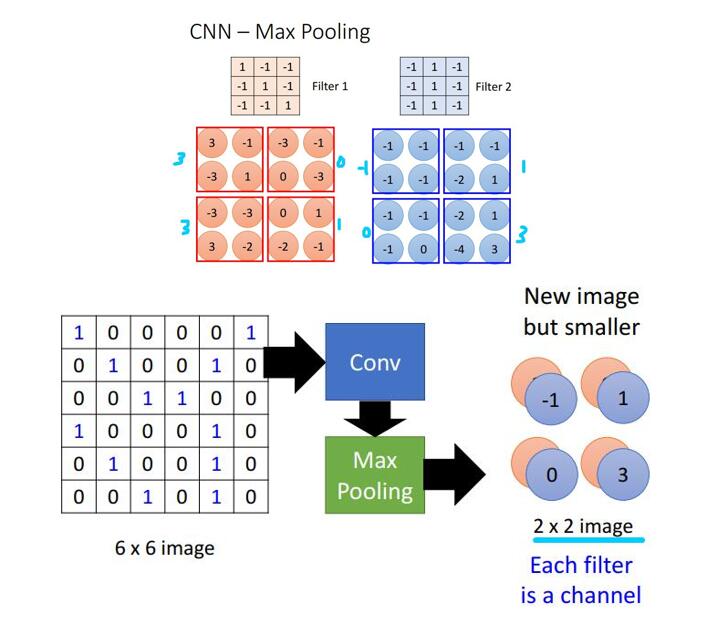

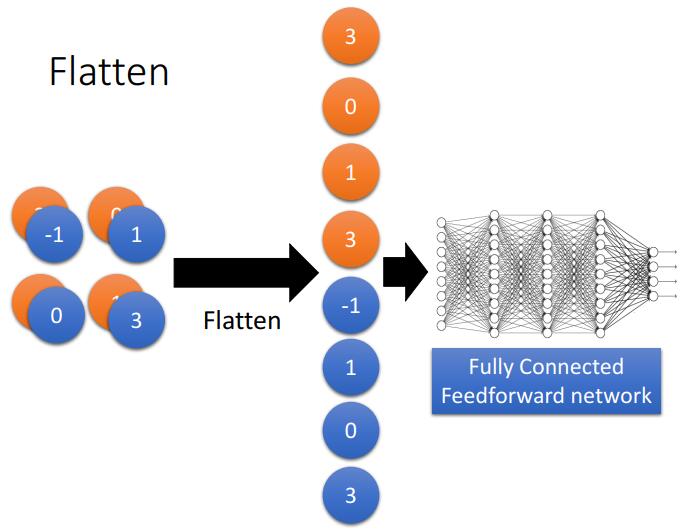

通常情况下,一个CNN包含多次的卷积、池化,然后Flatten,最终再通过一个深度神经网络进行学习预测。CNN在图像、语音识别取得非常好的成绩,核心的想法在于一些物体的特征往往可以提取出来,并且可能出现在图片的任何位置,而且通过卷积、池化可以大大减少输入数据,加快训练效率。

典型CNN包括以下步骤:

- Convolution(卷积)

- Max Pooling

- Flatten

B. Recurrent Neural Network (RNN)

(。。。)

参考:

[1]Deep Learning Tutorial .李宏毅

[2]https://mp.weixin.qq.com/s?__biz=MzI0OTQwMTA5Ng==&mid=2247484026&idx=1&sn=b7ce43461f35dc94dd314b90fbc1318b&chksm=e993581ddee4d10b345410489ce10367decb7d03a724bc16f9579dc89321036360479f387b55&mpshare=1&scene=23&srcid=#rd

最后

以上就是瘦瘦酒窝最近收集整理的关于李宏毅深度学习ppt总结Lecture 1: introduction of deep learningLecture II:Tips for Training DNNLecture III:Variants of Neural Networks的全部内容,更多相关李宏毅深度学习ppt总结Lecture内容请搜索靠谱客的其他文章。

发表评论 取消回复