Lecture 10 : Logistic Regression

【参考】https://redstonewill.com/236/

【概括】

1.

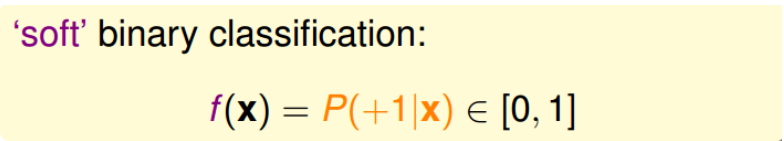

软性二分类问题:值越接近1,表示正类的可能性越大;越接近0,表示负类的可能性越大

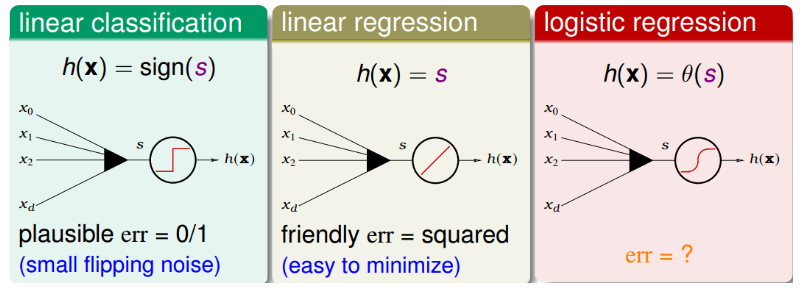

Logistic Regression与Linear Classification、Linear Regression做个比较:

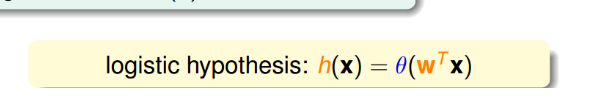

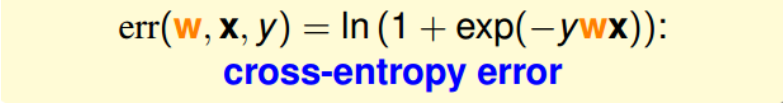

- logistic regression的err function,称之为cross-entropy error交叉熵误差:

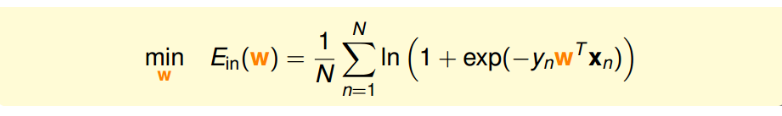

目的是使Ein最小:

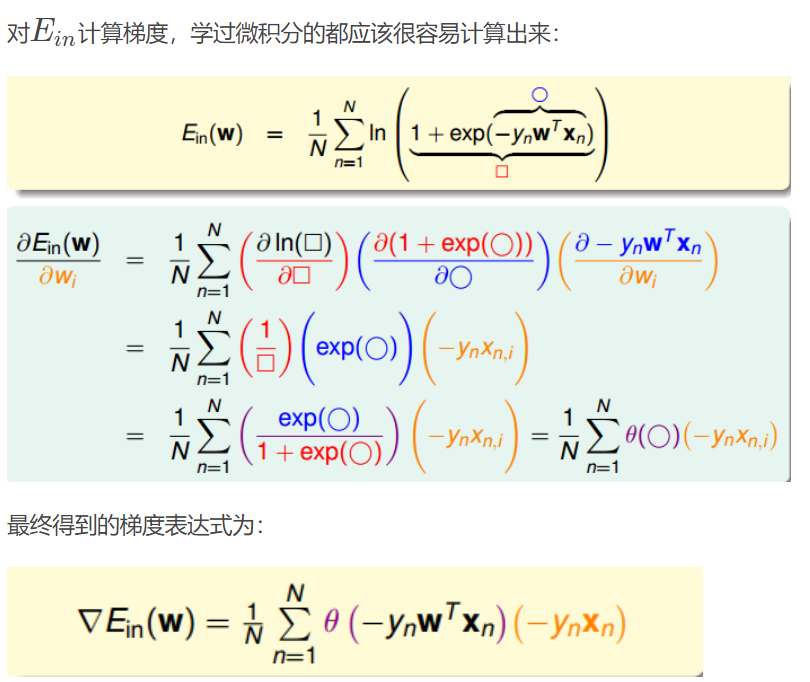

3.

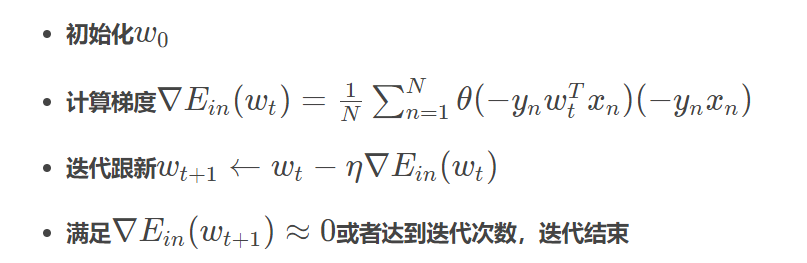

4. 基于梯度下降的Logistic Regression算法步骤如下:

最后

以上就是饱满百合最近收集整理的关于Lecture 10 : Logistic Regression的全部内容,更多相关Lecture内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复