要求分析

- 建立一个模型,用25000张标记好的猫狗图片训练模型,最后用125000张猫狗图片进行测试,

- 最终目标是能够让模型有更好的正确识别率(期望值:>=80%)

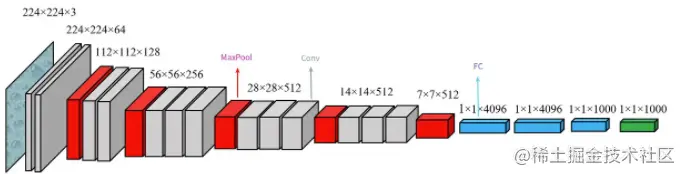

- 模型需要选用VGG模型

- 本次测试和训练的图片数量较小,如果没有GPU,依靠CPU也可以完成任务

分步构建网络

1.检测是否存在GPU设备

这一步骤的目的是查看当前环境下是否有GPU设备可以用于加速训练

import numpy as np

import matplotlib.pyplot as plt

import os

import torch

import torch.nn as nn

import torchvision

from torchvision import models,transforms,datasets

import time

import json

# 判断是否存在GPU设备

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

print('Using gpu: %s ' % torch.cuda.is_available())

复制代码

小福利:领完再看!迪迦给大家准备的250G人工智能学习资料礼包(内含:两大Pytorch、TensorFlow实战框架视频、图像识别、OpenCV、计算机视觉、深度学习与神经网络等等等视频、代码、PPT以及深度学习书籍)

只需要你点个关注,然后扫码添加助手小姐姐VX即可无套路领取!

扫码添加即可

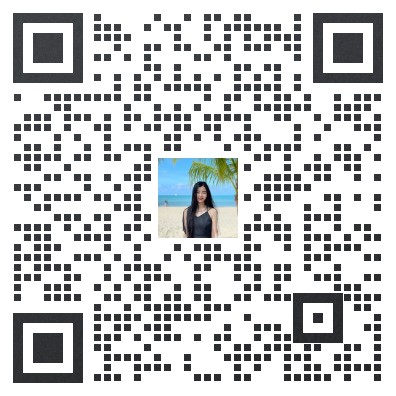

2.下载测试用的数据集

继续往下看!

此处为Jeremy Howard的数据集,链接似乎已经失效了

在Jeremy Howard提供的数据集当中,猫狗被分别放入了不同的文件夹当中

此处为我的老师提供的数据集,链接任有效

此处为Colab的安装指令

wget http://fenggao-image.stor.sinaapp.com/dogscats.zip记得解压

unzip dogscats.zip

在我的老师所提供的数据集当中分别有用于训练的Train文件夹,与用于测试的Vaild,两个文件夹当中又分别包含dogs与cats两个子文件夹,两个子文件夹分别有900张图片

如果是在colab或者算力不足的环境下对模型进行训练、测试可以优先考虑我的老师所提供的文件夹,训练时长与数据集的大小有比较紧密的练习

观察文件夹中的图片可以发现,不少的图片的主体当中并非只有单纯的猫与狗,还有一些其他的元素比如人脸等,这一类图片可以可以增强模型的训练效果,减少模型无法识别出识别主体较小或是模糊的图片

2.对数据进行预处理

VGG模型对数据有有尺寸要求:图片需要为224x224x3的格式

故此我们需要对数据进行预处理,保证我们的图片符合VGG模型的要求

在进行本步骤的时候我们采用了torchvision当中的包datasets,这样可以通过多线程读取图片加速图片的装载速度,以mini-batch的方式向训练中的网络输送图片,同时torchvison可以对数据集当中的图片进行各种预处理(ormalization, cropping, flipping, jitterin)

[此处为torchvision.transforms的官方文档](torchvision.transforms — Torchvision 0.11.0 documentation (pytorch.org))

normalize = transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

vgg_format = transforms.Compose([

transforms.CenterCrop(224),

transforms.ToTensor(),

normalize,

])

data_dir = './dogscats'

dsets = {x: datasets.ImageFolder(os.path.join(data_dir, x), vgg_format)

for x in ['train', 'valid']}

dset_sizes = {x: len(dsets[x]) for x in ['train', 'valid']}

dset_classes = dsets['train'].classes

loader_train = torch.utils.data.DataLoader(dsets['train'], batch_size=64, shuffle=True, num_workers=6)

loader_valid = torch.utils.data.DataLoader(dsets['valid'], batch_size=5, shuffle=False, num_workers=6)

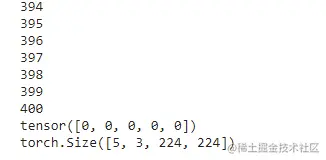

'''

valid 数据一共有2000张图,每个batch是5张,因此,下面进行遍历一共会输出到 400

同时,把第一个 batch 保存到 inputs_try, labels_try,分别查看

'''

count = 1

for data in loader_valid:

print(count, end='n')

if count == 1:

inputs_try,labels_try = data

count +=1

print(labels_try)

print(inputs_try.shape)

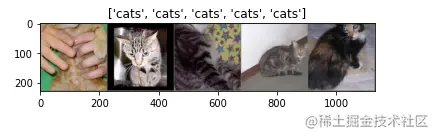

# 显示图片的小程序

def imshow(inp, title=None):

# Imshow for Tensor.

inp = inp.numpy().transpose((1, 2, 0))

mean = np.array([0.485, 0.456, 0.406])

std = np.array([0.229, 0.224, 0.225])

inp = np.clip(std * inp + mean, 0,1)

plt.imshow(inp)

if title is not None:

plt.title(title)

plt.pause(0.001) # pause a bit so that plots are updated# 显示 labels_try 的5张图片,即valid里第一个batch的5张图片

out = torchvision.utils.make_grid(inputs_try)

imshow(out, title=[dset_classes[x] for x in labels_try])

3.构建VGG模型

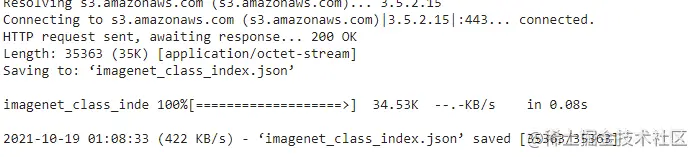

torchvision集合了imageNet上约120万张的训练数据,在本次的作业中我们可以直接使用预先训练好的的VGG模型,同时也可以额外添加imageNet1000个类的jason文件

wget https://s3.amazonaws.com/deep-learning-models/image-models/imagenet_class_index.json

复制代码

model_vgg = models.vgg16(pretrained=True)

with open('./imagenet_class_index.json') as f:

class_dict = json.load(f)

dic_imagenet = [class_dict[str(i)][1] for i in range(len(class_dict))]

inputs_try , labels_try = inputs_try.to(device), labels_try.to(device)

model_vgg = model_vgg.to(device)

outputs_try = model_vgg(inputs_try)

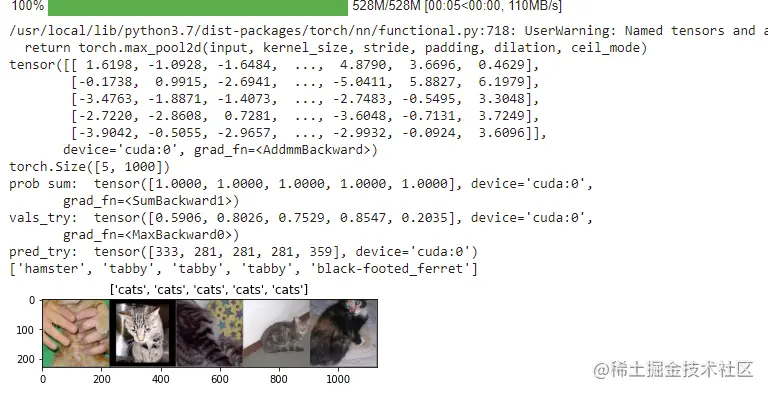

print(outputs_try)

print(outputs_try.shape)

'''

可以看到结果为5行,1000列的数据,每一列代表对每一种目标识别的结果。

但是我也可以观察到,结果非常奇葩,有负数,有正数,

为了将VGG网络输出的结果转化为对每一类的预测概率,我们把结果输入到 Softmax 函数

'''

m_softm = nn.Softmax(dim=1)

probs = m_softm(outputs_try)

vals_try,pred_try = torch.max(probs,dim=1)

print( 'prob sum: ', torch.sum(probs,1))

print( 'vals_try: ', vals_try)

print( 'pred_try: ', pred_try)

print([dic_imagenet[i] for i in pred_try.data])

imshow(torchvision.utils.make_grid(inputs_try.data.cpu()),

title=[dset_classes[x] for x in labels_try.data.cpu()])

复制代码

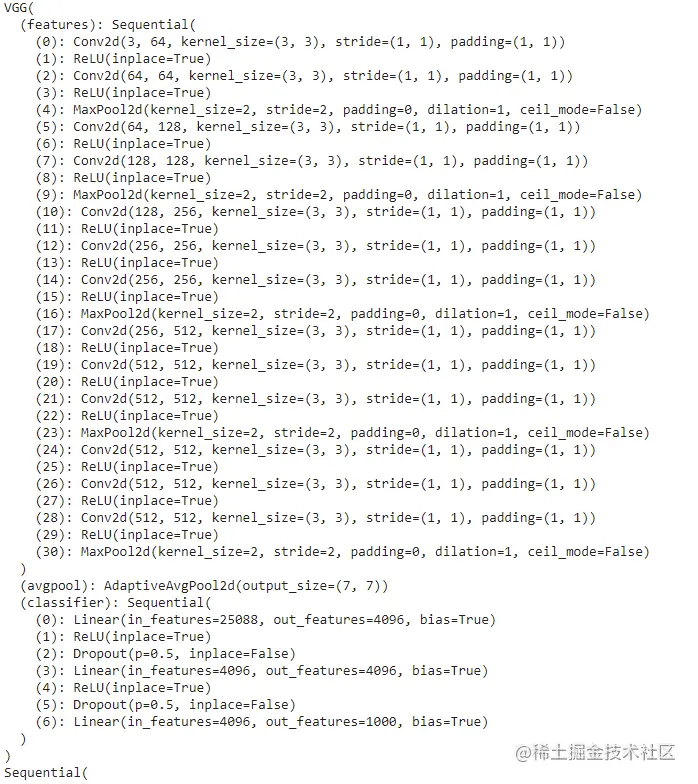

4.修改模型的最后一层

在本次训练当中我们只需要判断猫和狗,所以我们要将全连接的最后一层改写为nn.Linera(4096,2)

此处为了冻结前面层的参数,可以设置required_grad=False,这样先前权重不会自动更新

print(model_vgg)

model_vgg_new = model_vgg;

for param in model_vgg_new.parameters():

param.requires_grad = False

model_vgg_new.classifier._modules['6'] = nn.Linear(4096, 2)

model_vgg_new.classifier._modules['7'] = torch.nn.LogSoftmax(dim = 1)

model_vgg_new = model_vgg_new.to(device)

print(model_vgg_new.classifier)

复制代码

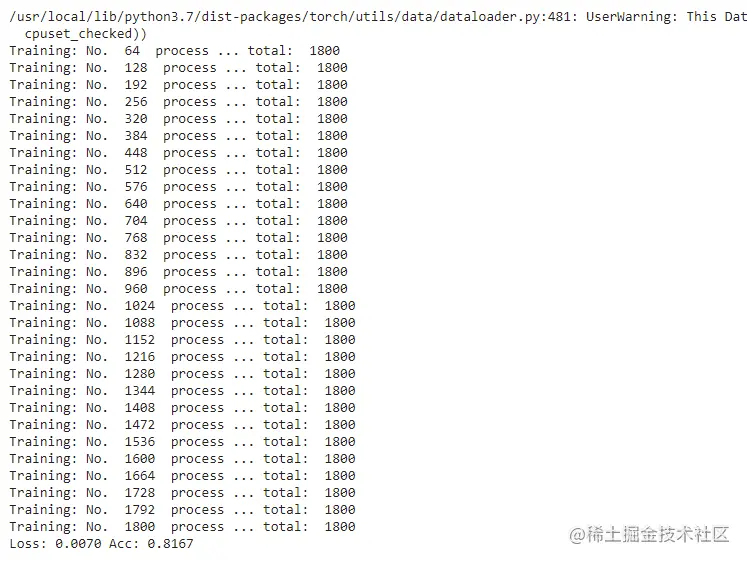

5.训练并测试全链接层

'''

第一步:创建损失函数和优化器

损失函数 NLLLoss() 的 输入 是一个对数概率向量和一个目标标签.

它不会为我们计算对数概率,适合最后一层是log_softmax()的网络.

'''

criterion = nn.NLLLoss()

# 学习率

lr = 0.001

# 随机梯度下降

optimizer_vgg = torch.optim.SGD(model_vgg_new.classifier[6].parameters(),lr = lr)

'''

第二步:训练模型

'''

def train_model(model,dataloader,size,epochs=1,optimizer=None):

model.train()

for epoch in range(epochs):

running_loss = 0.0

running_corrects = 0

count = 0

for inputs,classes in dataloader:

inputs = inputs.to(device)

classes = classes.to(device)

outputs = model(inputs)

loss = criterion(outputs,classes)

optimizer = optimizer

optimizer.zero_grad()

loss.backward()

optimizer.step()

_,preds = torch.max(outputs.data,1)

# statistics

running_loss += loss.data.item()

running_corrects += torch.sum(preds == classes.data)

count += len(inputs)

print('Training: No. ', count, ' process ... total: ', size)

epoch_loss = running_loss / size

epoch_acc = running_corrects.data.item() / size

print('Loss: {:.4f} Acc: {:.4f}'.format(

epoch_loss, epoch_acc))

# 模型训练

train_model(model_vgg_new,loader_train,size=dset_sizes['train'], epochs=1,

optimizer=optimizer_vgg)

6.可视化模型测试结果

此处我们采用主观分析,其实就是把预测的结果和相应的测试图像输出出来,主要有一下5种方法

-

随机查看一些预测正确的图片

-

随机查看一些预测错误的图片

-

预测正确,同时具有较大的probability的图片

-

预测错误,同时具有较大的probability的图片

-

最不确定的图片,比如说预测概率接近0.5的图片

# 单次可视化显示的图片个数

n_view = 8

correct = np.where(predictions==all_classes)[0]

from numpy.random import random, permutation

idx = permutation(correct)[:n_view]

print('random correct idx: ', idx)

loader_correct = torch.utils.data.DataLoader([dsets['valid'][x] for x in idx],

batch_size = n_view,shuffle=True)

for data in loader_correct:

inputs_cor,labels_cor = data

# Make a grid from batch

out = torchvision.utils.make_grid(inputs_cor)

imshow(out, title=[l.item() for l in labels_cor])

7.将模型套用到猫狗大战中

此处我们采用了AI研习社的猫狗大战

先下载数据集合

! wget https://static.leiphone.com/cat_dog.rar ! unrar x cat_dog.rar

解压一下

unrar x cat_dog.rar

进行预测

predictions, all_proba, all_classes = test_model(model_vgg_new,loader_test,size=dset_sizes['test'])输出csv,务必注意切片顺序,笔者在这里被卡住了很久

import csv

with open('./dogscats/1.csv','w',newline="")as f:

writer = csv.writer(f)

for index,cls in enumerate(predictions):

path = datasets.ImageFolder(os.path.join(data_dir,'test'),vgg_format).imgs[index][0]

l = path.split("/")

img_name = l[-1]

order = int(img_name.split(".")[0])

writer.writerow([order,int(predictions[index])])记得要排序一下,这样才能符合数据格式要求

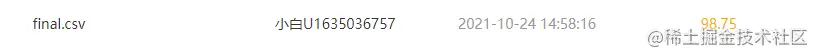

最终结果

测试后可得图片通过

作者:k11

链接:https://juejin.cn/post/7022487383039803422

来源:稀土掘金

最后

以上就是彩色飞鸟最近收集整理的关于直呼惊艳,熬夜几天完成的实战模型:猫狗大战,附资料的全部内容,更多相关直呼惊艳,熬夜几天完成内容请搜索靠谱客的其他文章。

![[Kaggle] dogs-vs-cats之制作数据集[1]](https://www.shuijiaxian.com/files_image/reation/bcimg8.png)

发表评论 取消回复