点击我爱计算机视觉标星,更快获取CVML新技术

刚刚,正在韩国首尔举行的多媒体技术领域顶级会议ACM Multimedia 2018上,公布了最佳论文和最佳学生论文,两篇论文的第一作者均为华人学者,恭喜他们!

这两篇论文均已开源!

让我们一起来看看到底是什么惊艳的新发明!

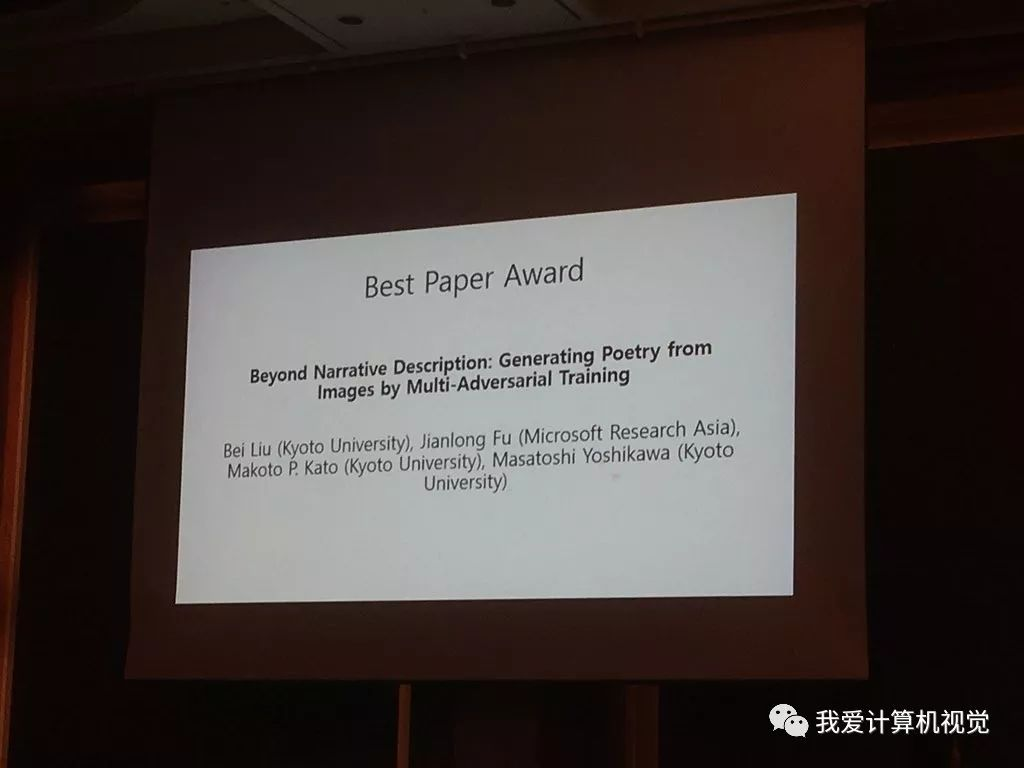

Best Paper Award

Beyond Narrative Description: Generating Poetry from Images by Multi-Adversarial Training

Bei Liu (Kyoto University), Jianlong Fu (Microsoft Research Asia),

Makoto P. Kato (Kyoto University), Masatoshi Yoshikawa (Kyoto University)

论文研究的问题是让计算机通过一幅图像来做诗(“从图像生成文字描述”已经满足不了科学家对计算机的期待了,要让计算机也充满诗意),来自京都大学和微软亚洲研究院的学者通过将“诗义”嵌入到视觉特征中,使用多对抗学习与强化学习提升了目前的state-of-the-art,在500人的图灵测试中,该方法成为最接近人类“吟诗作对”水平的算法。

注意,该文使用的诗歌语料是英文的。

论文地址:

https://arxiv.org/abs/1804.08473

代码主页:

https://github.com/bei21/img2poem

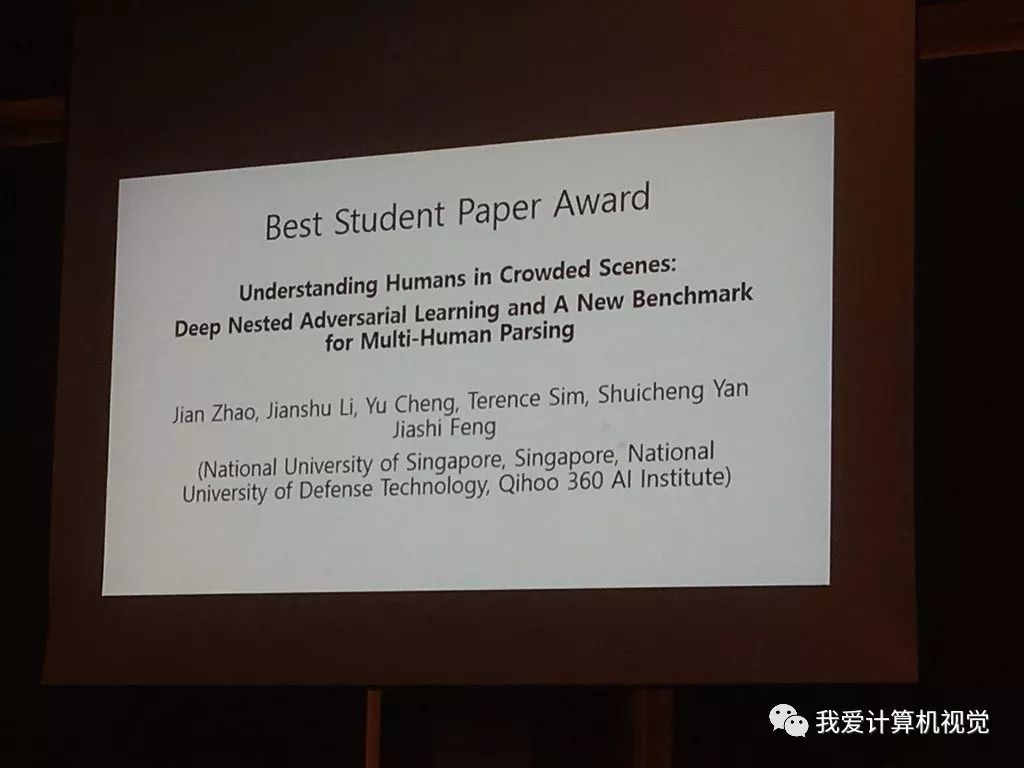

Best Student Paper Award

Understanding Humans in Crowded Scenes: Deep Nested Adversarial

Learning and A New Benchmark for Multi-Human Parsing

Jian Zhao (National University of Singapore and National University of Defense Technology), Jianshu Li (National University of Singapore), Yu Cheng (National University of Singapore), Terence Sim (National University of Singapore), Shuicheng Yan (National University of Singapore and Qihoo 360 AI Institute), Jiashi Feng (National University of Singapore)

该文研究的问题是拥挤场景下的多个体的人体部件解析,这对于视频场景群体行为分析非常重要。作者团队也很强大,主要来自颜水成老师的新加坡国立大学LV组(颜老师目前为360 AI研究院院长,第一作者Jian Zhao同时也在国防科技大学任职),该文建立了一个大型多个体人体部件解析数据库(MHP),提出了一种深层嵌套对抗网络模型(deep Nested Adversarial Network,NAN),该网络由三个类似生成对抗网络(GAN)的子网组成,分别执行语义显着性预测(semantic saliency prediction),实例不可知解析(instance-agnostic parsing)和实例感知聚类(instance-aware clustering)。这些子网形成一个嵌套结构,经过精心设计,以端到端的方式共同学习。 NAN在MHP和其他几个数据集上始终优于现有的最先进算法,作者已将代码开源,以期推动学界在多个体人体部件解析方向的更深入研究。

论文地址:

https://arxiv.org/abs/1804.03287

代码主页:

https://github.com/ZhaoJ9014/Multi-Human-Parsing_MHP

项目主页:

https://lv-mhp.github.io/

这两篇论文都与GAN相关,生成模型真的越来越重要了!

再次恭喜各位作者~

长按关注我爱计算机视觉

【点赞与转发】都是一种鼓励

最后

以上就是奋斗摩托最近收集整理的关于ACM MM2018 Best Paper 被华人包揽的全部内容,更多相关ACM内容请搜索靠谱客的其他文章。

发表评论 取消回复