出处:ECCV 2016

论文:https://kpzhang93.github.io/papers/eccv2016.pdf

代码:https://github.com/ydwen/caffe-face

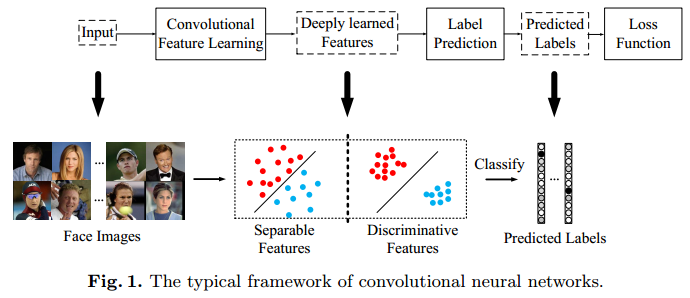

摘要: 在大多数可用的CNN中,softmax损失函数被用作训练深度模型的监督信号。为了提高深度学习特征的判别力,本文提出了一种新的监督信号,称为center loss。中心损失同时学习每个类别的深度特征的中心并且惩罚深度特征与其对应的类中心之间的距离。通过对softmax损失和中心损失的联合监督,可以训练强大的CNN,以尽可能地获得具有两个关键学习目标,类间分散和类内紧凑的深层特征。

1.简介

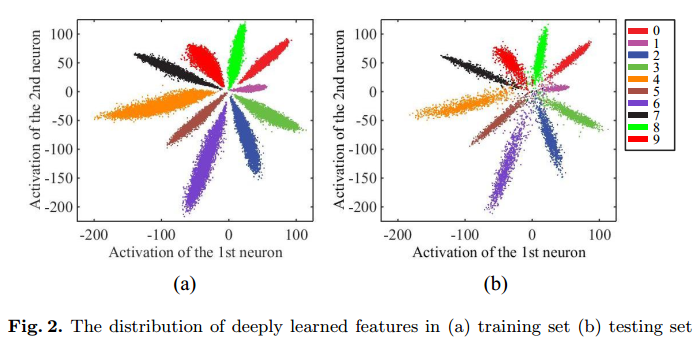

通过添加center loss 让简单的softmax 能够训练出更有内聚性的特征。作者意图,在配合softmax使用的时候,希望使学习到的特征具有更好的泛化性和辨别能力。通过惩罚每个种类的样本和该种类样本中心的偏移,使得同一种类的样本尽量聚合在一起。

2.相关工作

3.方法

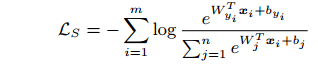

softmax loss :

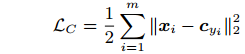

center loss :

其中,cyi表示第yi类深度特征的中心。希望在同一类所有图像特征与类中心特征的距离总和最小。

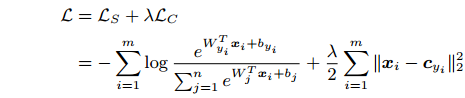

完整的loss function:

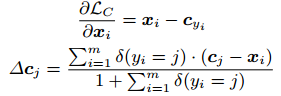

由于yi类的深度特征中心cyi难以确定,文章给了两个步骤加以修正。第一,基于每个mini-batch对中心特征进行更新。第二,使用一个a尺度去控制中心偏移(指数加权)。Lc的导数以及yi的平均偏移如下:

由于本文是caffe实现,需要自己代码实现反向传播,整个算法框架如下图

Discussion

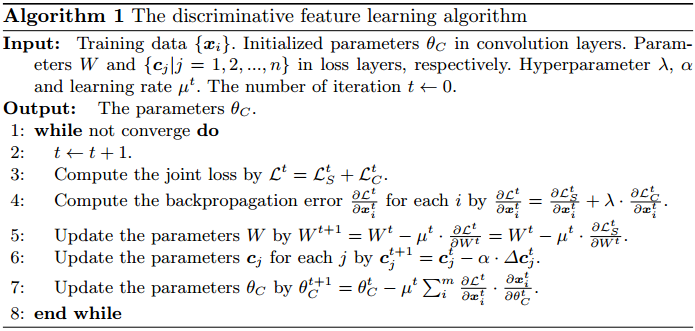

softmax loss:

joint supervision of softmax loss and center loss:

最后

以上就是直率小霸王最近收集整理的关于论文笔记 | A Discriminative Feature Learning Approach for Deep Face Recognition的全部内容,更多相关论文笔记内容请搜索靠谱客的其他文章。

发表评论 取消回复