大数据_08 【新增节点与删除节点】

- 服役新节点具体步骤

- 01 需求基础

- 02 准备新节点

- 03 服役新节点具体步骤

- 退役旧数据节点

服役新节点具体步骤

01 需求基础

需求基础 随着公司业务的增长,数据量越来越大,原有的数据节点的容量已经不能满足存储数据的需求,需要在原有集群基础上动态添加新的数据节点。

02 准备新节点

- 复制一台新的虚拟机出来 将我们纯净的虚拟机复制一台出来,作为我们新的节点

- 第二步:修改mac地址以及IP地址

- 第三步:关闭防火墙,关闭selinux

- 第四步:更改主机名

- 第五步:四台机器更改主机名与IP地址映射

- 第六步:node04服务器关机重启并生成公钥与私钥

- 第七步:node04安装jdk

- 第八步:解压Hadoop安装包

- 第九步:将node01关于Hadoop的配置文件全部拷贝到node04

03 服役新节点具体步骤

- 在node01也就是namenode所在的机器的/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop目录下创建dfs.hosts文件

[root@node01 Hadoop]# cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

[root@node01 Hadoop]# touch dfs.hosts

[root@node01 Hadoop]# vim dfs.hosts

添加如下主机名称(包含新服役的节点)

node01

node02

node03

node04

- 第二步:node01编辑hdfs-site.xml添加以下配置(在namenode的hdfs-site.xml配置文件中增加dfs.hosts属性node01执行以下命令)

cd /export/servers/Hadoop-2.6.0-cdh5.14.0/etc/Hadoop

vim hdfs-site.xml

<property>

<name>dfs.hosts</name>

<value>/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/dfs.hosts</value>

</property>

- 第三步:刷新namenode

[root@node01 Hadoop]# hdfs dfsadmin -refreshNodes

Refresh nodes successful

- 第四步:更新resourceManager节点 node01执行以下命令刷新resourceManager

[root@node01 Hadoop]# yarn rmadmin -refreshNodes

19/03/16 11:19:47 INFO client.RMProxy: Connecting to ResourceManager at node01/192.168.52.100:8033

- 第五步:namenode的slaves文件增加新服务节点主机名称

node01编辑slaves文件,并添加新增节点的主机,更改完后,slaves文件不需要分发到其他机器上面去

node01执行以下命令编辑slaves文件

cd /export/servers/Hadoop-2.6.0-cdh5.14.0/etc/Hadoop

vim slaves

node01

node02

node03

node04

- 第六步:单独启动新增节点 node04服务器执行以下命令,启动datanode和nodemanager

cd /export/servers/hadoop-2.6.0-cdh5.14.0/

sbin/hadoop-daemon.sh start datanode

sbin/yarn-daemon.sh start nodemanager

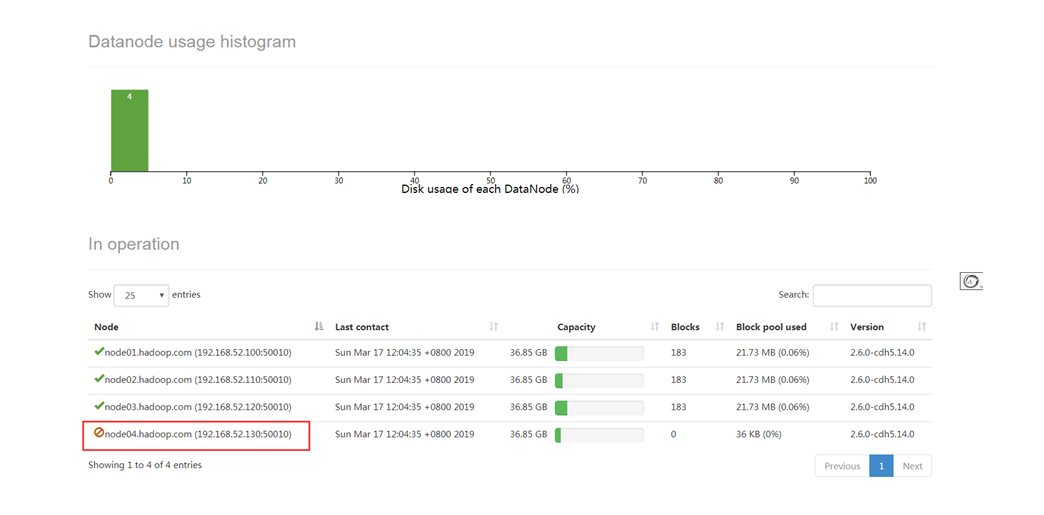

- 第七步:浏览器查看

http://node01:50070/dfshealth.html#tab-overview

http://node01:8088/cluster

- 第八步:使用负载均衡命令,让数据均匀负载所有机器

cd /export/servers/hadoop-2.6.0-cdh5.14.0/

sbin/start-balancer.sh

退役旧数据节点

- 第一步:创建dfs.hosts.exclude配置文件

在namenod的cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop目录下创建dfs.hosts.exclude文件,并添加需要退役的主机名称 node01执行以下命令

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

touch dfs.hosts.exclude

vim dfs.hosts.exclude

node04

- 第二步:编辑namenode所在机器的hdfs-site.xml

编辑namenode所在的机器的hdfs-site.xml配置文件,添加以下配置

node01执行以下命令

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

vim hdfs-site.xml

<property>

<name>dfs.hosts.exclude</name>

<value>/export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/dfs.hosts.exclude</value>

</property>

- 第三步:刷新namenode,刷新resourceManager

在namenode所在的机器执行以下命令,刷新namenode,刷新resourceManager 并重启集群

hdfs dfsadmin -refreshNodes

yarn rmadmin -refreshNodes

- 第四步:查看web浏览界面 浏览器访问 http://node01:50070/dfshealth.html#tab-datanode

- 第五步:节点退役完成,停止该节点进程

等待退役节点状态为decommissioned(所有块已经复制完成),停止该节点及节点资源管理器。注意:如果副本数是3,服役的节点小于等于3,是不能退役成功的,需要修改副本数后才能退役。·

node01执行以下命令,停止该节点进程

cd /export/servers/hadoop-2.6.0-cdh5.14.0

sbin/hadoop-daemon.sh stop datanode

sbin/yarn-daemon.sh stop nodemanager

- 第六步:从include文件中删除退役节点 namenode所在节点也就是node01执行以下命令删除退役节点

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

vim dfs.hosts

node01

node02

node03

namenode所在节点也就是node01执行以下命令刷新namenode和resourceManager

hdfs dfsadmin -refreshNodes

yarn rmadmin -refreshNodes

- 第七步:从namenode的slave文件中删除退役节点

namenode所在机器也就是node01执行以下命令从slaves文件中删除退役节点

cd /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop

vim slaves

- 第八步:如果数据负载不均衡,执行以下命令进行均衡负载 node01执行以下命令进行均衡负载

cd /export/servers/hadoop-2.6.0-cdh5.14.0/

sbin/start-balancer.sh

最后

以上就是超级绿茶最近收集整理的关于大数据_08 【新增节点与删除节点】的全部内容,更多相关大数据_08内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复