Kubernetes集群环境搭建

- 前言

- 环境规划

- 集群类型

- 安装方式

- 主机规划

- 环境搭建

- 主机初始化

- 安装docker

- 安装k8s的三个组件

- 准备集群镜像

- master初始化

- node加入集群

- 安装网络插件

- 安装kubectl命令补全工具

- 环境测试

前言

自己摸索着搭建k8s集群花了好多时间,网上的教程良莠不齐,根据本博文按照顺序搭建,100%成功,并且理解。

环境规划

集群类型

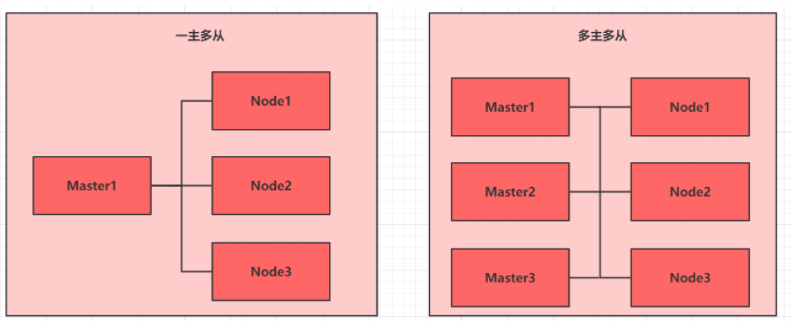

kubernetes集群大体上分为两类:一主多从和多主多从。

- 一主多从:一台Master节点和多台Node节点,搭建简单,但是有单机故障风险,适合用于测试环境

- 多主多从:多台Master节点和多台Node节点,搭建麻烦,安全性高,适合用于生产环境

本文章搭建的是一主两从类型的集群

安装方式

kubernetes有多种部署方式,目前主流的方式有kubeadm、minikube、二进制包

- minikube:一个用于快速搭建单节点kubernetes的工具

- kubeadm:一个用于快速搭建kubernetes集群的工具

- 二进制包 :从官网下载每个组件的二进制包,依次去安装,此方式对于理解kubernetes组件更加有效

本文章使用的是kubeadm部署方式,网上看了很多,貌似kubeadm是最常用的了

主机规划

| 作用 | IP地址 | 操作系统 | 配置 |

|---|---|---|---|

| Master | 192.168.109.101 | Centos7.5+ 基础设施服务器 | 2核 2G内存 50G硬盘 |

| Node1 | 192.168.109.102 | Centos7.5+ 基础设施服务器 | 2核 2G内存 50G硬盘 |

| Node2 | 192.168.109.103 | Centos7.5 + 基础设施服务器 | 2核 2G内存 50G硬盘 |

记住,操作系统必须选用7.5及7.5以上的,后续会有解释

环境搭建

镜像下载地址:CentOS/7.9.2009

本次环境搭建需要安装三台centos服务器(一主二从),然后在每台服务器中分别安装docker、kubeadm、kubelet、kubectl程序,具体步骤见下

主机初始化

主机配置IP我就不介绍了,可以参看我的这篇文章Linux配置静态ip

注意三台主机都要进行如下操作

- 检查操作系统的版本

# 此方式下安装kubernetes集群要求Centos版本要在7.5或之上

[root@master ~]# cat /etc/redhat-release

CentOS Linux release 7.5.1804 (Core)

- 主机名解析

为了方便后面集群节点间的直接调用,在这配置一下主机名解析

# 编辑三台服务器的/etc/hosts文件

vi /etc/hosts

# 添加下面内容,注意如果你的ip跟我不一样,对应的改一下即可

192.168.109.100 master

192.168.109.101 node1

192.168.109.102 node2

- 时间同步

kubernetes要求集群中的节点时间必须精确一致,这里直接使用chronyd服务从网络同步时间。

# 启动chronyd服务

[root@master ~]# systemctl start chronyd

# 设置chronyd服务开机自启

[root@master ~]# systemctl enable chronyd

# chronyd服务启动稍等几秒钟,就可以使用date命令验证时间了

[root@master ~]# date

2022年 02月 28日 星期一 15:24:30 CST

- 禁用iptables和firewalld服务

kubernetes和docker在运行中会产生大量的iptables规则,为了不让系统规则跟它们混淆,直接关闭系统的规则

# 1 关闭firewalld服务

[root@master ~]# systemctl stop firewalld

[root@master ~]# systemctl disable firewalld

# 2 关闭iptables服务

[root@master ~]# systemctl stop iptables

[root@master ~]# systemctl disable iptables

- 禁用selinux

selinux是linux系统下的一个安全服务,如果不关闭它,在安装集群中会产生各种各样的奇葩问题

# 编辑 /etc/selinux/config 文件,修改SELINUX的值为disabled

# 注意修改完毕之后需要重启linux服务,稍后重启

vi /etc/selinux/config

# 找到SELINUX=enforcing,改成SELINUX=disabled

# 测试是否关闭,显示Disabled为关闭成功,即重启之后才会成功

[root@master ~]# getenforce

Disabled

- 禁用swap分区

swap分区指的是虚拟内存分区,它的作用是在物理内存使用完之后,将磁盘空间虚拟成内存来使用。启用swap设备会对系统的性能产生非常负面的影响,因此kubernetes要求每个节点都要禁用swap设备。但是如果因为某些原因确实不能关闭swap分区,就需要在集群安装过程中通过明确的参数进行配置说明。

# 编辑分区配置文件/etc/fstab,注释掉swap分区一行

# 注意修改完毕之后需要重启linux服务

vi etc/fstab

# 将下面这一行,可以看到是swap,前面加个#,注释掉

/dev/mapper/centos-swap swap swap defaults 0 0

# 变成下面这样子,就完成了,稍后再重启

# /dev/mapper/centos-swap swap swap defaults 0 0

- 修改linux的内核参数

# 修改linux的内核参数,添加网桥过滤和地址转发功能

# 编辑/etc/sysctl.d/kubernetes.conf文件

vi etc/sysctl.d/kubernetes.conf

#添加如下配置:

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.ip_forward = 1

# 重新加载配置

[root@master ~]# sysctl -p

# 加载网桥过滤模块

[root@master ~]# modprobe br_netfilter

# 查看网桥过滤模块是否加载成功

[root@master ~]# lsmod | grep br_netfilter

br_netfilter 22256 0

bridge 146976 1 br_netfilter

- 配置ipvs功能

在kubernetes中service有两种代理模型,一种是基于iptables的,一种是基于ipvs的。两者比较的话,ipvs的性能明显要高一些,但是如果要使用它,需要手动载入ipvs模块

# 1 安装ipset和ipvsadm

[root@master ~]# yum install ipset ipvsadmin -y

# 2 添加需要加载的模块写入脚本文件

[root@master ~]# cat <<EOF > /etc/sysconfig/modules/ipvs.modules

#!/bin/bash

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack_ipv4

EOF

# 3 为脚本文件添加执行权限

[root@master ~]# chmod +x /etc/sysconfig/modules/ipvs.modules

# 4 执行脚本文件

[root@master ~]# /bin/bash /etc/sysconfig/modules/ipvs.modules

# 5 查看对应的模块是否加载成功

[root@master ~]# lsmod | grep -e ip_vs -e nf_conntrack_ipv4

nf_conntrack_ipv4 15053 9

nf_defrag_ipv4 12729 1 nf_conntrack_ipv4

ip_vs_sh 12688 0

ip_vs_wrr 12697 0

ip_vs_rr 12600 0

ip_vs 141432 6 ip_vs_rr,ip_vs_sh,ip_vs_wrr

nf_conntrack 133053 9 ip_vs,nf_nat,nf_nat_ipv4,nf_nat_ipv6,xt_conntrack,nf_nat_masquerade_ipv4,nf_nat_masquerade_ipv6,nf_conntrack_ipv4,nf_conntrack_ipv6

libcrc32c 12644 4 xfs,ip_vs,nf_nat,nf_conntrack

- 重启服务器

上面步骤完成之后,需要重新启动linux系统

[root@master ~]# reboot

安装docker

注意三台主机都要安装docker

# 1 切换镜像源,换成阿里的

[root@master ~]# wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo

# 2 安装docker,我这里直接安装最新版的,不多bb

[root@master ~]# yum install docker -y

# 3 修改配置文件,Docker在默认情况下使用的Cgroup Driver为cgroupfs

# 而kubernetes推荐使用systemd来代替cgroupfs

[root@master ~]# cd /etc/docker

[root@master ~]# cat <<EOF > /etc/docker/daemon.json

{

"exec-opts": ["native.cgroupdriver=systemd"],

"registry-mirrors": ["https://kn0t2bca.mirror.aliyuncs.com"]

}

EOF

# 注意了,这里直接启动docker会报错,因为docker.service里有一条配置

# 和刚才添加的"exec-opts"冲突了,下面是解决方案

# 4 解决报错

# vi /lib/systemd/system/docker.service

# 找到并删除下面这句话,保存退出,即可解决

# --exec-opt native.cgroupdriver=cgroupfs

# 5 启动docker

[root@master ~]# systemctl daemon-reload

[root@master ~]# systemctl restart docker

[root@master ~]# systemctl enable docker

# 6 检查docker状态和版本,能检查到就说明你安装启动好了

[root@master ~]# docker version

[root@master ~]# systemctl status docker

安装k8s的三个组件

注意三台主机都要安装k8s的三个组件

# 由于kubernetes的镜像源在国外,速度比较慢,这里切换成国内的镜像源

# 编辑/etc/yum.repos.d/kubernetes.repo

vi /etc/yum.repos.d/kubernetes.repo

#添加下面的配置

[kubernetes]

name=Kubernetes

baseurl=http://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=http://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg

http://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

# 安装kubeadm、kubelet和kubectl

[root@master ~]# yum install kubeadm kubelet kubectl -y

# 配置kubelet的cgroup

# 编辑/etc/sysconfig/kubelet

vi /etc/sysconfig/kubelet

# 添加下面的配置

KUBELET_CGROUP_ARGS="--cgroup-driver=systemd"

KUBE_PROXY_MODE="ipvs"

# 设置kubelet开机自启

[root@master ~]# systemctl enable kubelet

准备集群镜像

注意三台主机都要准备集群镜像

# 在安装kubernetes集群之前,必须要提前准备好集群需要的镜像,所需镜像可以通过下面命令查看

[root@master ~]# kubeadm config images list

k8s.gcr.io/kube-apiserver:v1.23.4

k8s.gcr.io/kube-controller-manager:v1.23.4

k8s.gcr.io/kube-scheduler:v1.23.4

k8s.gcr.io/kube-proxy:v1.23.4

k8s.gcr.io/pause:3.6

k8s.gcr.io/etcd:3.5.1-0

k8s.gcr.io/coredns/coredns:v1.8.6

# 下载镜像

# 此镜像在kubernetes的仓库中,由于网络原因,无法连接,下面提供了一种替代方案

# 下载国内的镜像然后给镜像改名,如果你看到此博文安装时

# list里面的版本与我不同,直接修改下面的image的版本即可,其他不要动

# 直接在bash里面复制粘贴下面的语句即可

images=(

kube-apiserver:v1.23.4

kube-controller-manager:v1.23.4

kube-scheduler:v1.23.4

kube-proxy:v1.23.4

pause:3.6

etcd:3.5.1-0

coredns:v1.8.6

)

for imageName in ${images[@]} ; do

docker pull registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName

docker tag registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName k8s.gcr.io/$imageName

docker rmi registry.cn-hangzhou.aliyuncs.com/google_containers/$imageName

done

# 注意coredns组件路径是k8s.gcr.io/coredns/coredns:v1.8.6,而不是k8s.gcr.io/coredns:v1.8.6

# 所以这一个手动修改一下

docker tag k8s.gcr.io/coredns:v1.8.6 k8s.gcr.io/coredns/coredns:v1.8.6

docker rmi k8s.gcr.io/coredns:v1.8.6

master初始化

注意,下面的操作只在master主机上操作

# 创建集群

# 第一个参数是k8s的版本,第二个是pod的网段,第三个是service的网段,第四个是master的地址

[root@master ~]# kubeadm init

--kubernetes-version=v1.23.4

--pod-network-cidr=10.244.0.0/16

--service-cidr=10.96.0.0/12

--apiserver-advertise-address=192.168.109.100

# 出现下面这句话就说明安装成功了

Your Kubernetes control-plane has initialized successfully !

#注意安装完成后的提示信息最后几行,有个token,node加入集群时会用到

kubeadm join 192.168.109.100:6443 --token jh2hn8.hvebbwqlp9rqd5ri

--discovery-token-ca-cert-hash sha256:d4c63e4449affefd5755ce880bfbd3ae66cc2f8ac8b9b28408f038c622d53000

# 创建必要文件

[root@master ~]# mkdir -p $HOME/.kube

[root@master ~]# sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

[root@master ~]# sudo chown $(id -u):$(id -g) $HOME/.kube/config

node加入集群

注意,下面的操作只在node主机上操作

# 将node节点加入集群

[root@master ~]# kubeadm join 192.168.109.100:6443 --token jh2hn8.hvebbwqlp9rqd5ri

--discovery-token-ca-cert-hash sha256:d4c63e4449affefd5755ce880bfbd3ae66cc2f8ac8b9b28408f038c622d53000

# 查看集群状态 此时的集群状态为NotReady,这是因为还没有配置网络插件

[root@master ~]# kubectl get nodes

NAME STATUS ROLES AGE VERSION

master NotReady master 6m43s v1.17.4

node1 NotReady <none> 22s v1.17.4

node2 NotReady <none> 19s v1.17.4

安装网络插件

注意,下面的操作只在master主机上操作

kubernetes支持多种网络插件,比如flannel、calico、canal等等,任选一种使用即可,本次选择flannel

插件使用的是DaemonSet的控制器,它会在每个节点上都运行

# 获取fannel的配置文件

[root@master ~]# wget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

# 使用配置文件启动fannel

[root@master ~]# kubectl apply -f kube-flannel.yml

# 稍等片刻,再次查看集群节点的状态

[root@master ~]# kubectl get nodes

NAME STATUS ROLES AGE VERSION

master Ready control-plane,master 4h49m v1.23.4

node1 Ready <none> 4h48m v1.23.4

node2 Ready <none> 4h47m v1.23.4

安装kubectl命令补全工具

在日常管理k8s集群的时候,时刻都会使用到Kubectl命令行工具,但是该命令还是挺复杂的,使用中也记不住那么多的api选项,所以这里介绍一下Kubectl命令补全工具(其实是Linux中bash命令自动补全工具)的安装。

[root@master ~]# yum -y install bash-completion

[root@master ~]# source /usr/share/bash-completion/bash_completion

[root@master ~]# source <(kubectl completion bash)

[root@master ~]# echo "source <(kubectl completion bash)" >> ~/.bashrc

环境测试

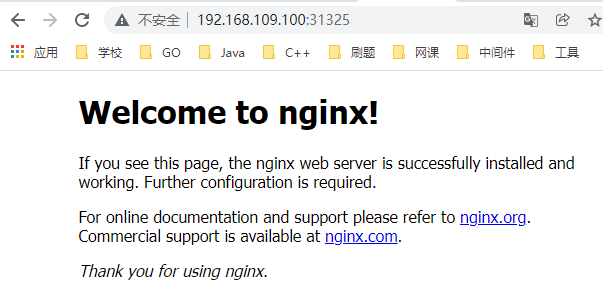

接下来在kubernetes集群中部署一个nginx程序,测试下集群是否在正常工作。

# 部署nginx

[root@master ~]# kubectl create deployment nginx --image=nginx

deployment.apps/nginx created

# 暴露端口

[root@master ~]# kubectl expose deployment nginx --port=80 --type=NodePort

service/nginx exposed

# 查看服务状态

[root@master ~]# kubectl get pods,service

NAME READY STATUS RESTARTS AGE

pod/nginx-85b98978db-sh6cs 1/1 Running 0 38s

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 4h55m

service/nginx NodePort 10.108.112.185 <none> 80:31325/TCP 10s

最后在电脑上访问下部署的nginx服务

至此,kubernetes的集群环境搭建完成

最后

以上就是含蓄寒风最近收集整理的关于Kubernetes—集群环境搭建前言环境规划环境搭建环境测试的全部内容,更多相关Kubernetes—集群环境搭建前言环境规划环境搭建环境测试内容请搜索靠谱客的其他文章。

发表评论 取消回复