我是靠谱客的博主 正直雪糕,这篇文章主要介绍kafka处理超大消息的配置 org.apache.kafka.common.errors.RecordTooLargeException,现在分享给大家,希望可以做个参考。

在使用 canal 和kafka处理数据同步时canal日志提示如下异常:

java.lang.RuntimeException: java.util.concurrent.ExecutionException: org.apache.kafka.common.errors.RecordTooLargeException: The request included a message larger than the max message size the server will accept

原因是消息过大无法处理

第一步:修改 canal/conf/canal.properties配置(我在原有基础上加了一个0,可能需要更合适的数量级)

canal.mq.maxRequestSize = 10485760

第二步:修改kafka/config/producer.properties

max.request.size=12695150

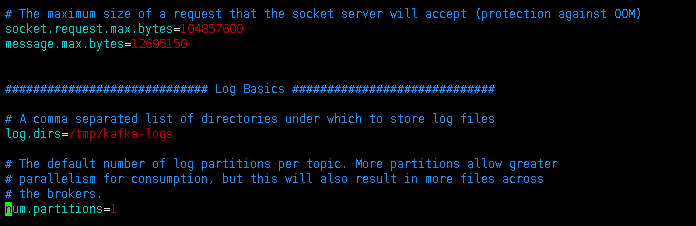

修改kafka/config/server.properties

message.max.bytes=12695150

第三步:重启服务

最后

以上就是正直雪糕最近收集整理的关于kafka处理超大消息的配置 org.apache.kafka.common.errors.RecordTooLargeException的全部内容,更多相关kafka处理超大消息的配置内容请搜索靠谱客的其他文章。

本图文内容来源于网友提供,作为学习参考使用,或来自网络收集整理,版权属于原作者所有。

发表评论 取消回复