声明:本文来自于微信公众号 亿欧网(ID:i-yiou),作者:陈卓,授权靠谱客转载发布。

利用AI技术一键生成虚假新闻,竟成某些不法分子的赚钱方式。

据央视新闻近日报道,一些MCN机构和个人账号,让AI根据关键词编造不实消息,发布到网络上吸引网友点击,赚取平台针对创作者的流量奖励。其中情节严重的,名下经营数家MCN机构,操控账号高达800多个,一天最多生成7000篇,每天的流量收入过万。

“XX爆炸”、“XX被拘”、“XX通报”、“突发!XXXX”、“最新!XXX”、“震惊!XXX”……

大部分由AI编造、用以博取眼球的虚假新闻,抓住和人们日常生活密切相关的话题,或涉及网友近期可能关注的热点事件,再加上夸张的叙述方式、猎奇的故事情节和耸人听闻的标题,只为尽可能吸引更多网友阅读和评论,从而赚取流量进而变现。

AI谣言造成的后果不容小视,这一行业乱象已经引起各方重视。

AI造谣,日进万元?

6月13日,央视新闻的报道揭露了数起利用AI软件炮制谣言的案件。

今年1月,某网络平台出现一条关于“西安爆炸”的消息,称当月10日晚,西安突然响起巨大爆炸声,还配有所谓爆炸的图片。消息一经发布,很快就在网上传播开来,也引起相关部门的重视。但经核实发现,当地并没有发生类似事件,消息为不实信息,涉嫌网络造谣。

经调查,相关账号归属于一家江西的MCN 机构,而消息的内容从文字到图片都是AI生成的。据公司实控人王某某供述,他通过具有语音交互功能的AI软件,说出几个关键词后,自动在网络上抓取相关信息,生成几百到上千字的文本,再配上貌似和事件具有相关的虚假图片,从而形成一段看起来信息量很大、实际上子虚乌有的内容。

无独有偶,重庆公安也查处了一起利用AI软件编造谣言的案件。

2023年12月25日,一则“重庆巫溪一民房发生爆炸事故”的消息在某网络平台上发布。该消息全文500余字,以新闻报道的口吻提供了不少细节,比如“现场情况十分惨烈”、“官方紧急介入调查”等,短时间内就获得了几万次点击量。

经查,这则消息是康某某通过AI软件编造的。康某某在看到一篇关于爆炸事故的新闻关注度较高后,就在AI软件中输入“重庆”、“爆炸”等关键词,让AI模仿新闻报道的风格生成文章,随后发布在自己的网络账号上。

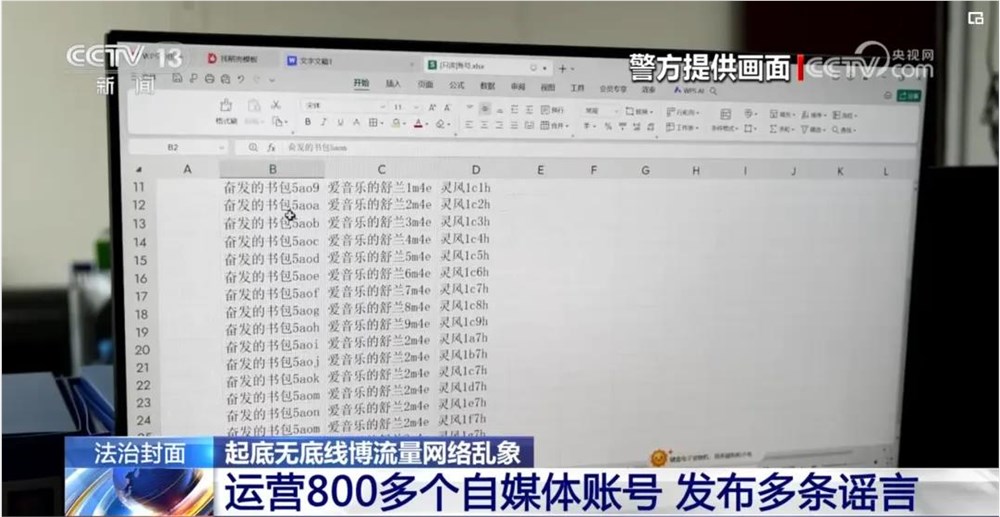

图源:央视新闻

据了解,王某某和康某某之所以利用AI制造谣言,都是为了在网络平台博取流量从而获取利益。

康某某表示,在某知名网络平台创作发布文章,可以根据阅读、评论、转发数量等获取相关流量收益,每千人有效阅读量有1-2元的奖励,但自己之前发布的20多条内容都没有收益,就萌生了模仿新闻风格编造虚假消息的想法。“发布之后看着流量蹭蹭涨,觉得这篇文章可以赚钱了,当时是这个心理。”

而经营MCN机构的王某某,已经通过这种方式获利不少。经查,他旗下共有5家MCN机构,运营的账号数量多达842个。通过AI工具,王某某每天可产出多达4000-7000条信息。截至案发前,最高的一条收入是700元,据此估算,他每天的收入可达到1万元。

图源:央视新闻

最终,利用AI编造信息并传播谣言的当事人,都因自己的违法行为得到了相应处罚。

炮制“西安爆炸”虚假消息的王某某,构成传播谣言虚构事实扰乱公共秩序。目前,南昌警方依据中华人民共和国治安管理处罚法相关规定,依法对王某某行政拘留5日,并责令涉案MCN机构停业整改。

编造“重庆民房爆炸”的康某某,也构成虚构事实扰乱公共秩序。但他一开始并没意识到自己的行为违法,认为只需删除文章就没事了。最终,康某某被行政拘留3日、收缴违法所得,网络账号也被封禁。这起案件还被公安部列为打击整治网络谣言违法犯罪典型案例。

责任在谁,如何治理?

利用AI炮制谣言的行业乱象,引发不少网友的关注和讨论,AI创作工具也一度陷入争议。

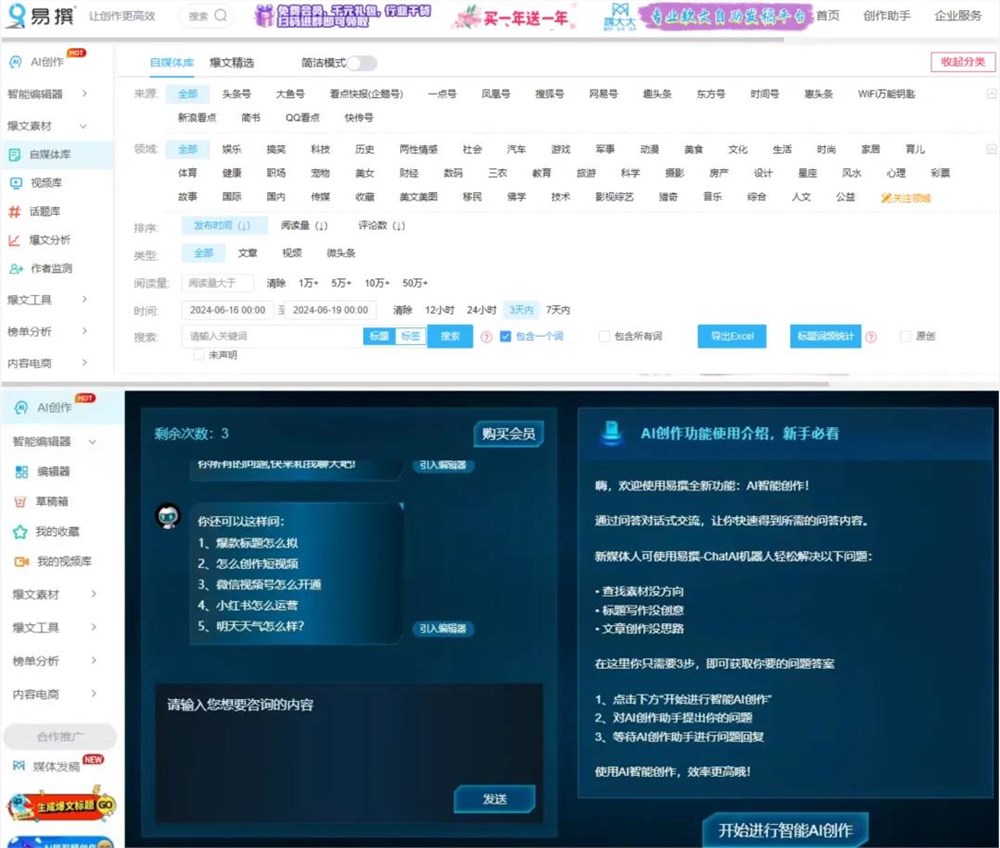

比如,上述新闻中王某某提到的,可根据关键词生成内容的AI工具,据新浪科技报道为易撰网。官网介绍,易撰网上线于2017年8月,隶属于长沙营智信息技术有限公司,为自媒体内容创客提供写作灵感、创作素材和高效的写作连接平台。工商信息显示,长沙营智信息技术有限公司,成立于2014年4月,注册资本100万人民币。

针对被央视新闻曝光一事,易撰网客服曾向新浪科技表示:“具体情况不清楚,网站只是提供创作的辅助功能,可以根据需要使用。”

图源:易撰网官网

实际上,类似易撰网的AI创作平台不在少数。这些平台一般汇集了大量免费素材,涵盖图片、音频、视频、字体等,为用户提供便捷的AI创作辅助功能。

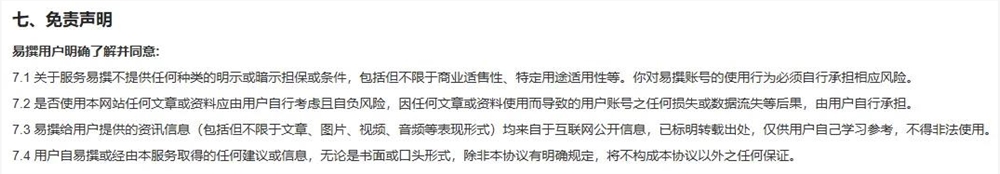

这类AI创作平台会通过免责声明,来规避生成内容可能带来的风险。比如素材都是由网友自愿提供或来自于公开渠道,平台不对其准确性、完整性和有效性负责;平台提供的信息和生成的内容仅供参考,不构成任何法律意见或建议,用户的行为为个人决策,需自行承担相应责任。

免责声明

图源:易撰网官网

但随着AIGC工具被广泛应用于各行各业,AI生成内容引发争议或纠纷的情况时有发生,倒逼一些AI智能终端和大模型平台,不断强化审核机制来保证输出内容合规。

比如,2023年10月,科大讯飞针对学习机生成内容出现有违背主流价值观的事件,对负责保障内容安全的合作伙伴作出处罚,同时将星火大模型上内容审核机制放之学习机;再比如,文心一言表示在不断优化已有技术的同时,也在探索更高效的算法、更严格的内容审核机制,确保技术造福社会。

目前来看,即便是拥有最先进AI技术的科技公司,也要先依靠人工审核来把关和过滤内容,再通过相关案例的不断积累和总结,逐步建立AI和人工结合互补的审核机制。

公开资料显示,OpenAI已招聘了人员来审核并分类处理从网上获取的以及由AI自身生成的有害文本,这些经过分类的段落被用于为ChatGPT创建AI安全过滤器,防止用户接触到类似内容;微软也利用GitHub C opilot等安全服务,来防止AIGC工具出现不良内容。

监管发力,平台带头?

就AI谣言治理来看,关键一环还是平台。

西南政法大学法学院教授陈伟在接受央视新闻采访时表示,平台应对相关信息尽到监管责任,以防范不良信息或者虚假信息上传到网络产生后续影响。尤其是在目前平台会向高流量内容支付报酬、以刺激用户创作的机制下,更应注重消除虚假信息。

“报酬支付也应起到积极的引导性作用,不应该通过发布虚假信息提升流量。这些散布者一旦出现,对他的相关惩罚机制,或者事后相关警示、封号等一些方式,都应该考虑到。”陈伟说。

归根结底,大多数普通网民没有辨别谣言的能力,AI创作工具也无法左右生成内容的使用,那么平台作为这个链条里的最后一环,自然需担起“清洁”行业的责任。平台方作为既得利益者,在享受技术红利的同时,也要主动履行相关义务,充当行业治理的先行官。

可以看到,各大平台已经在积极推动AIGC内容治理。

2023年10月,今日头条发布了《关于自媒体利用AIGC传播违规内容治理的公告》。公告称,平台在巡查中发现部分账号利用AIGC创作虚假或低俗负面的内容,并发布在平台上进行传播;平台对相关违规内容进行了下架,并对涉嫌违规行为的账号进行了封禁或禁言的处罚。

2023年12月,今日头条再次发布《关于倡导合理使用AI创作工具的公告》。公告指出,AI工具对内容的理解和创作来源于算法生成,使用时仅用于辅助创作,不应代替创作者的独立思考和判断;创作者在使用时,应对发布内容的准确性、合法性等问题负责,即使在内容中声明为AI创作或内容来源自网络,创作者仍需承担发布有害内容或侵犯他人权益带来的后果。

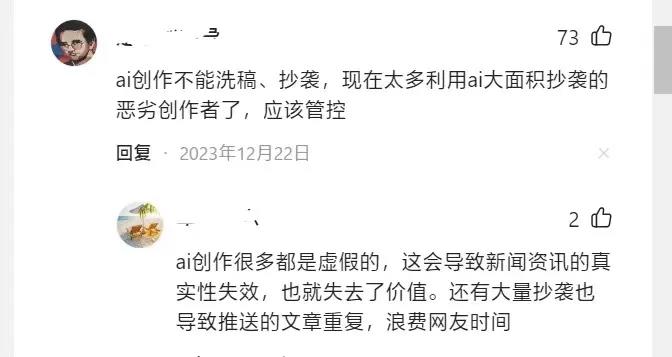

不少网友在评论区留言表示赞同,称“AI创作不能洗稿、抄袭,现在太多利用AI大面积抄袭的恶劣创作者,应该管控”、“AI创作很多都是虚假的,这导致新闻资讯的真实性失效,失去了价值”。

图源:今日头条

微信则也在2023年9月就发布了《关于规范“自媒体”创作者内容标内容标注的公告》。公告表示,自媒体账号在发布时事、政策和社会事件等相关信息时,应当准确地标注信息来源,并在显著位置进行展示。

今年6月,微信发布的《关于治理“自媒体”违规行为的公告(第四期)》称,自媒体发布涉及国内外时事、公共政策、社会事件等相关信息时,必须标注信息来源于权威媒体或专业科普;发布使用AI等技术生成的信息时,必须标注内容为AI制作;发布含有虚构、演绎内容时,必须标注内容为虚构。

规范打标案例

图源:微信珊瑚安全公众号

但AI谣言治理涉及多个主体,包括监管部门、司法机关、企业平台、技术提供者、普通网民等,短期内或许难以一蹴而就,需各方共同探索治理解法。

针对AI谣言,监管部门也在加大打击力度。比如今年4月,网信办在全国范围内开展“清朗·整治‘自媒体’无底线博流量”专项行动,要求平台中的自媒体发布涉国内外时事、公共政策、社会事件等相关信息时,必须准确标注信息来源;使用AI等技术生成信息的,必须明确标注系技术生成;发布含有虚构、演绎等内容的,必须明确加注虚构标签。

法学专家则建议,应让造谣者付出更大的代价。“不光涉及行政拘留,也涉及行政性的罚款等,还包括对账号采取封号等措施,我们都要及时性跟进,以匹配违法成本和最终承担责任之间的比例,防范其他人看到造谣成本过低,对行为人的遏制作用有限。”陈伟认为。

正如办案民警所说,网络并非法外之地。“对于在互联网发布不实言论、扰乱社会秩序的,公安机关将坚决依法坚决处理,造成恶劣影响、情节严重的,公安机关将依法追究其法律责任。”

(举报)

发表评论取消回复